대화형 아바타를 위한 발화·감정 데이터 기반 효율적 얼굴 수집법

초록

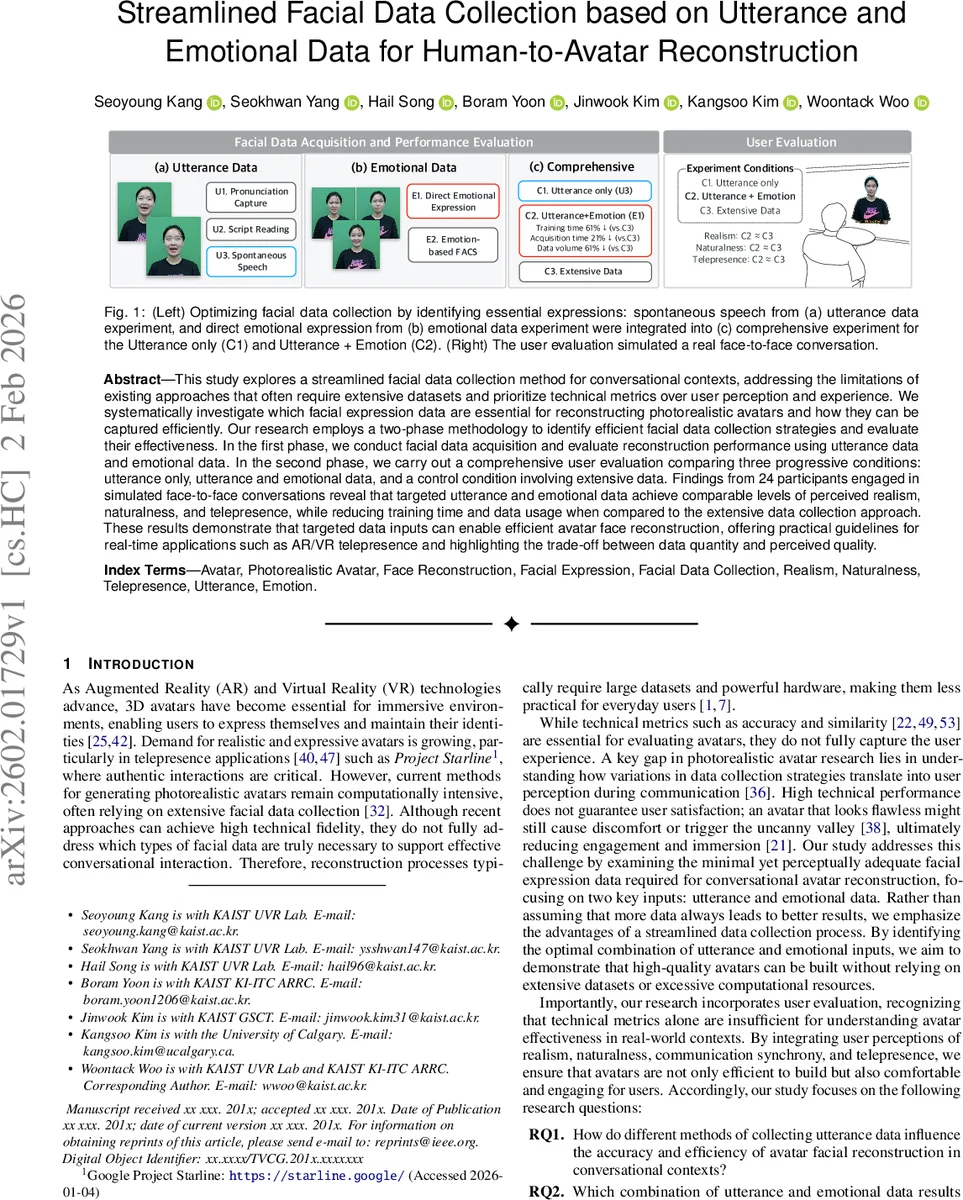

본 연구는 대화 상황에서 아바타 얼굴을 재구성하기 위해 필요한 최소한의 발화 데이터와 감정 표현 데이터를 규명한다. 24명의 참여자를 대상으로 세 가지 데이터 수집 조건(발화만, 발화+감정, 광범위 데이터)을 비교한 결과, 발화와 감정 데이터를 결합한 C2 조건이 광범위 데이터(C3)와 인지적 현실감·자연스러움·텔레프레즌스에서 동등한 성능을 보이며, 데이터 양과 학습 시간을 약 20% 이상 절감함을 확인하였다.

상세 분석

이 논문은 기존의 대규모 얼굴 데이터셋이 요구하는 높은 비용과 복잡성을 극복하고자, “얼굴 표현에 필수적인 최소 데이터”를 정의하고 실험적으로 검증한다. 연구는 두 단계로 구성된다. 첫 번째 단계에서는 발화 데이터(U1‑U3)와 감정 데이터(E1‑E2)의 조합을 체계적으로 탐색한다. 발화 데이터는 발음 캡처(U1), 스크립트 낭독(U2), 즉흥 연설(U3) 세 가지 방식으로 수집했으며, 각 방식은 얼굴 근육의 움직임 다양성을 달리한다. 감정 데이터는 직접 감정 표현(E1)과 FACS 기반 세부 근육 움직임 재현(E2)으로 구분된다. 이 6가지 조합을 통해 훈련 시간, 데이터 볼륨, 그리고 재구성 정확도를 정량적으로 평가하였다. 결과적으로, U3(즉흥 연설)와 E1(직접 감정 표현)의 결합이 가장 높은 재현성을 보이며, 데이터 양과 학습 시간 모두에서 6% 정도의 절감 효과를 나타냈다.

두 번째 단계에서는 위에서 도출된 최적 조합을 바탕으로 세 가지 실험 조건을 설정하였다. C1은 발화 데이터만 사용, C2는 발화+감정 데이터, C3는 기존 연구에서 사용되는 방대한 데이터셋을 그대로 적용한 통제군이다. 24명의 피험자를 대상으로 가상 회의 시나리오에서 아바타를 이용한 대화를 진행하게 하고, 현실감(Realism), 자연스러움(Naturalness), 텔레프레즌스(Telepresence)를 7점 리커트 척도로 평가하였다. 통계 분석 결과 C2와 C3 사이에 유의미한 차이가 없으며(C2 ≈ C3), C1에 비해 C2는 모든 지표에서 유의미하게 우수했다(p < .05). 특히, C2는 C3 대비 훈련 시간과 데이터 양을 각각 21%와 6% 감소시켰음에도 불구하고, 사용자 인지 품질에서는 동등한 수준을 유지했다.

기술적 측면에서는 Microsoft Azure Kinect를 이용해 RGB 영상을 3840×2160 해상도로 수집하고, 이후 512×512로 리사이즈해 최신 NeRF 기반 재구성 파이프라인에 입력하였다. GPU 메모리 사용률은 98%에 달했으나, 데이터 양 감소가 GPU 부하를 크게 완화시켜 실시간 혹은 근실시간 적용 가능성을 시사한다. 또한, 감정 데이터 수집 시 FACS 기반 세부 근육 움직임을 재현하는 E2 방식보다 직접 감정 표현(E1)이 데이터 효율성과 사용자 피드백 모두에서 우수함을 확인하였다.

이 연구는 “데이터 양이 많다고 품질이 무조건 높다”는 기존 가정을 재검토하고, 대화형 아바타 제작에 있어 핵심 입력을 발화와 기본 감정 표현으로 한정함으로써, 실용적인 데이터 수집 프로토콜을 제시한다. 이는 AR/VR 텔레프레즌스, 원격 협업, 디지털 휴먼 서비스 등에서 비용·시간을 크게 절감하면서도 사용자 경험을 유지할 수 있는 기반을 제공한다. 향후 연구에서는 다양한 문화권의 감정 표현 차이, 다중 언어 발화, 그리고 실시간 스트리밍 환경에서의 데이터 압축 효율성을 추가로 탐색할 여지가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기