LLM 기억 삭제의 새로운 패러다임: 적응형 직교와 적대적 게이팅 학습

초록

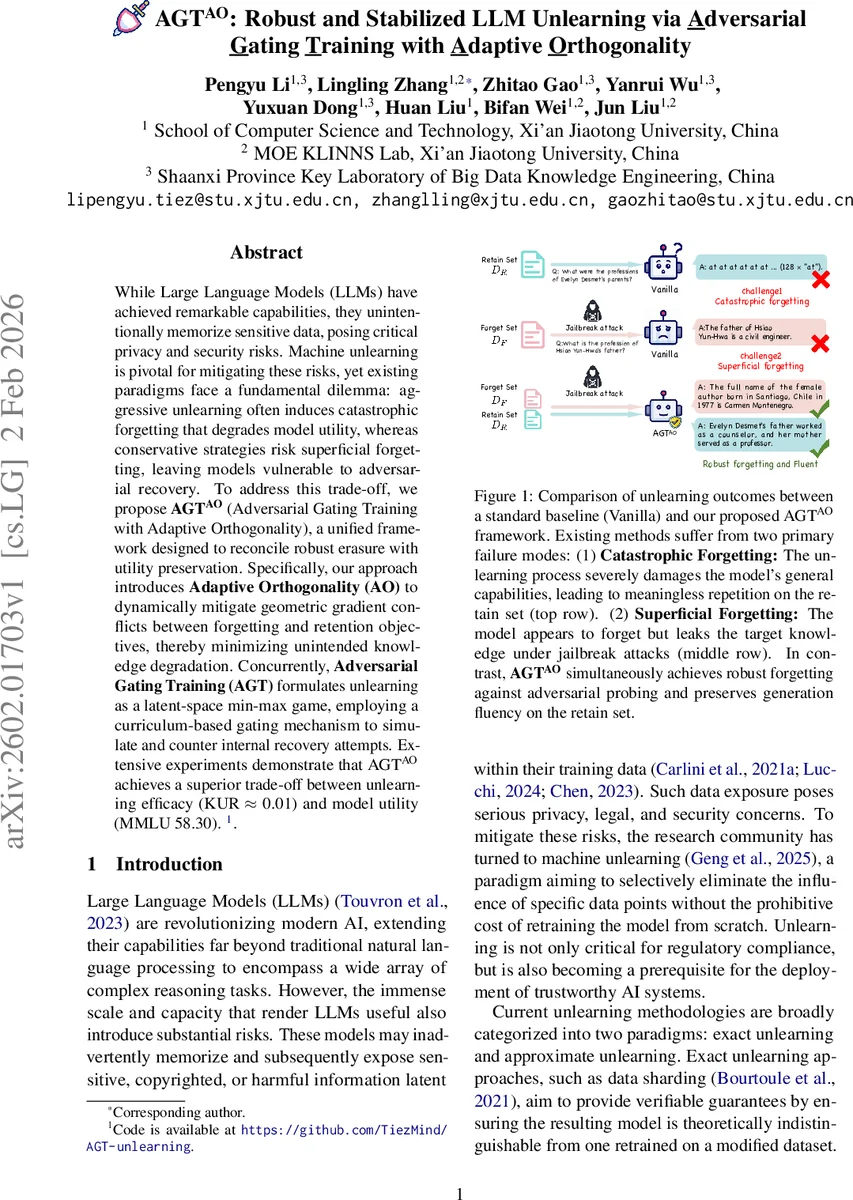

AGT⁽ᴬᴼ⁾는 대규모 언어 모델에서 민감한 데이터를 안전하게 삭제하기 위해 두 가지 핵심 메커니즘을 결합한다. Adaptive Orthogonality(AO)는 망각 목적과 유지 목적 사이의 그래디언트 충돌을 최소화해 모델 성능 저하를 방지하고, Adversarial Gating Training(AGT)은 잠재공간에서 최소-최대 게임을 수행해 내부 복구 공격에 강인한 삭제를 구현한다. 실험 결과, KUR 0.01 수준의 강력한 망각과 MMLU 58.30이라는 높은 유틸리티를 동시에 달성한다.

상세 분석

AGT⁽ᴬᴼ⁾는 기존 LLM 망각 방법이 겪는 ‘극단적 망각’과 ‘표면적 망각’ 사이의 딜레마를 근본적으로 해결하고자 설계되었다. 첫 번째 구성 요소인 Adaptive Orthogonality(AO)는 망각 손실(L_forget)과 유지 손실(L_retain)에서 도출된 그래디언트 g_f와 g_r 사이의 코사인 유사도를 측정한다. g_f·g_r < 0인 경우, 즉 두 그래디언트가 반대 방향을 가리킬 때만 정규화 항 R_AO = γ·(1−cos(g_f,g_r))²를 추가함으로써 두 업데이트를 거의 직교하도록 강제한다. 이 과정은 파라미터 공간에서 망각에만 영향을 미치는 서브스페이스를 찾아내고, 일반 지식이 포함된 파라미터는 그대로 유지한다는 점에서 기존의 단순 가중치 합성보다 훨씬 정교하다.

두 번째 핵심인 Adversarial Gating Training(AGT)은 잠재공간(Layer l)의 은닉 표현 h_f에 대해 ‖δ‖ₚ ≤ ε 제약 하에 최악의 적대적 교란 δ*를 찾는 내부 최대화 단계와, 그 교란에 강인하도록 파라미터 θ를 업데이트하는 외부 최소화 단계로 구성된 bi‑level 최적화를 도입한다. 특히, PGD 기반의 δ 탐색을 사용하면서도 ‘Gradient‑Norm‑Based Gating’이라는 커리큘럼 메커니즘을 적용한다. 초기 N 단계에서는 δ를 비활성화해 고변동 구간에서의 불안정성을 방지하고, 이후 ∥∇L_unlearn∥₂가 사전에 정의된 τ_grad 이하가 되면 적대적 교란을 활성화한다. 이는 학습 초기에 급격한 그래디언트 진동을 억제하고, 모델이 안정된 손실 평탄 영역에 도달한 뒤에만 강인성을 부여함으로써 ‘표면적 망각’에 빠지는 위험을 크게 낮춘다.

실험에서는 LLaMA‑2‑7B‑chat, Gemma‑2B‑it 등 다양한 오픈소스 LLM을 대상으로 TOFU, MUSE, WMDP 세 가지 벤치마크를 사용했다. 평가 지표는 Forget Quality, Knowledge Unlearning Ratio(KUR), Model Utility, Fluency, Privacy Leakage Ratio(PLR) 등을 포함한다. 표 1·2의 결과에서 AGT⁽ᴬᴼ⁾는 KUR을 0.01 수준으로 최소화하면서도 Model Utility(≈0.90)와 Fluency(≈0.90)를 유지한다. 기존 Gradient Ascent(GA), Negative Preference Optimization(NPO) 등과 비교했을 때, 망각 효율성에서는 압도적이며, 유틸리티와 프라이버시 측면에서도 균형 잡힌 성능을 보인다. 특히, ‘adversarial jailbreak’ 실험에서 AGT⁽ᴬᴼ⁾는 표면적 망각을 보이는 다른 방법들과 달리 기억된 정보를 복구하려는 시도를 거의 성공시키지 못한다는 점이 강조된다.

이 논문은 두 가지 혁신을 통해 LLM 망각 연구에 새로운 기준을 제시한다. AO는 그래디언트 충돌을 정량적으로 측정하고 완화함으로써 ‘catastrophic forgetting’을 방지하고, AGT는 잠재공간에서의 최악 상황을 시뮬레이션해 ‘robust forgetting’을 보장한다. 두 메커니즘을 통합한 프레임워크는 기존 방법이 직면한 트레이드오프를 실질적으로 해소하며, 대규모 모델을 재학습 없이도 안전하게 정제할 수 있는 실용적인 솔루션을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기