인간 영감 기반 음성 인식 프레임워크 HuPER

초록

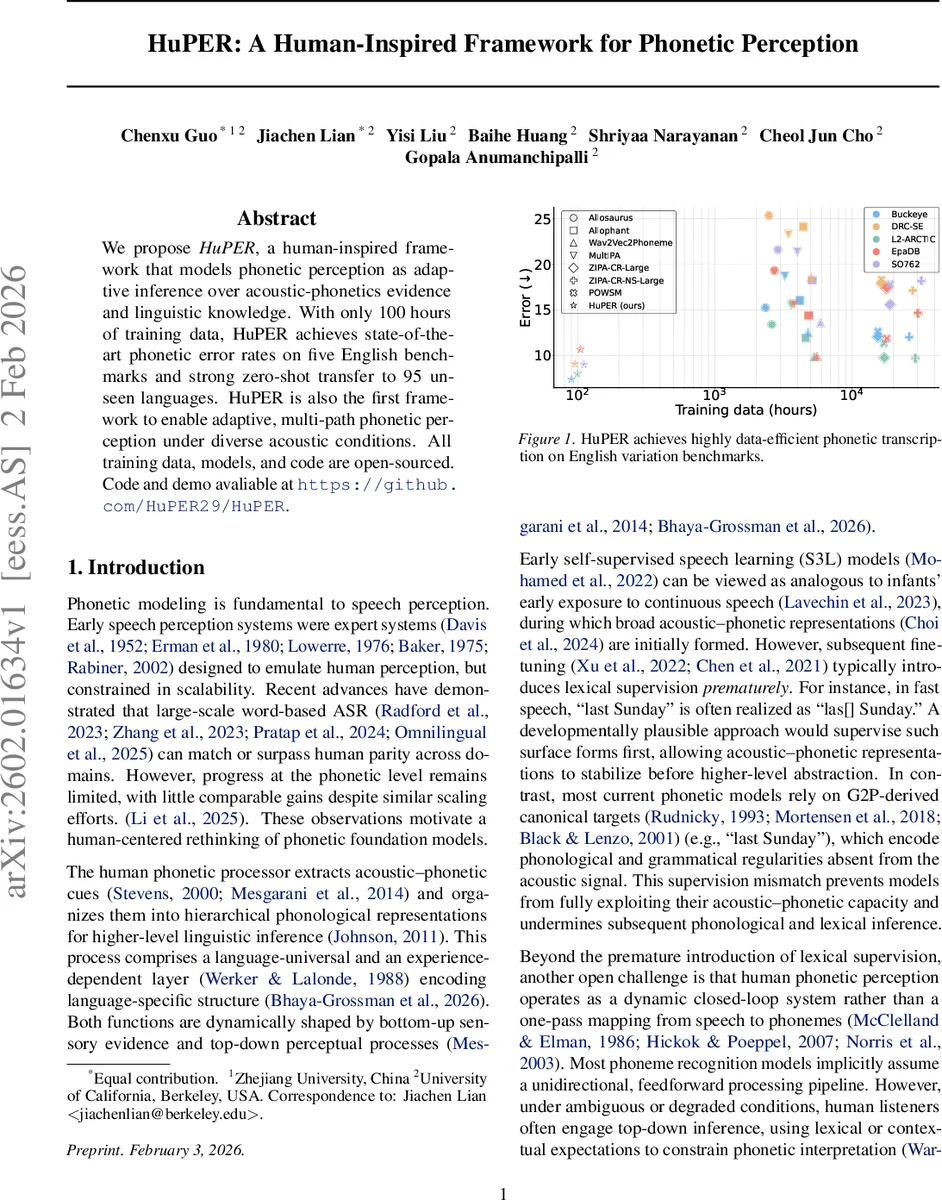

HuPER는 인간의 음성 인지 과정을 모방하여, 100시간의 학습 데이터만으로도 영어 5개 벤치마크에서 최첨단 음소 오류율을 달성하고, 95개 언어에 대한 제로샷 전이 성능을 보이는 다경로 적응형 음성 인식 시스템이다. 하위‑상향 음향‑음소 증거와 상위‑하향 언어 지식을 동적으로 결합하는 스케줄러와, 오류 보정을 위한 DRRC 기반 자기학습 파이프라인을 도입한다.

상세 분석

HuPER는 인간 청각 체계의 두 층, 즉 언어 보편적인 하위‑상향 음향‑음소 처리와 경험에 기반한 상위‑하향 언어 지식 통합을 컴퓨팅 모델로 구현한다는 점에서 혁신적이다. 핵심 모듈은 네 가지로 구성된다. 첫째, HuPER‑Recognizer는 대규모 사전학습된 WaveLM‑Large 모델을 기반으로 하며, CTC 손실로 초기 TIMIT 라벨을 학습한 뒤, 자체 교정기(Corrector)를 이용해 대규모 텍스트 전용 코퍼스(LibriSpeech)에서 생성된 의사 라벨을 정제한다. 이 과정은 ‘Doubly Robust Risk Correction(DRRC)’ 이론에 기반해, 라벨링 편향과 누락 라벨 문제를 동시에 완화한다. 논문은 DRRC의 정리와 정합성을 정리한 정리 3.1을 통해, 교정된 목표 함수가 실제 위험을 무편향하게 추정함을 증명한다.

둘째, HuPER‑Perceiver는 인식된 음소 격자를 WFST 기반의 어휘(L)와 언어 모델(G)과 결합해 단어 시퀀스를 생성한다. 여기서 음소 격자는 1‑best가 아닌 전체 확률 분포를 보존함으로써, 불확실한 상황에서도 최적의 후보를 탐색할 수 있다.

셋째, Dysfluent WFST는 발화 중 실수, 삽입, 삭제 등 비유창 현상을 명시적으로 모델링한다. 외부 레퍼런스 텍스트가 제공될 경우, 해당 텍스트를 기준으로 제한된 변형 집합을 생성해 상위‑하향 제약을 강화한다.

넷째, HuPER‑Scheduler는 프레임‑레벨 엔트로피와 마진을 결합한 왜곡 점수(s(X))를 실시간으로 계산한다. 점수가 사전 정의된 임계값 τ 이하이면 순수 하위‑상향 경로를, 초과하면 상위‑하향 제약을 포함한 경로를 선택한다. 이 동적 라우팅은 청취자가 청명한 음성에서는 순수 청각 정보를, 잡음이 심하거나 불명료한 상황에서는 언어 기대치를 활용하는 인간의 인지 전략을 그대로 모방한다.

실험 결과는 100시간 학습으로 평균 PFER 8.82를 기록하며, 기존 S3L 기반 모델들을 크게 앞선다. 또한, 95개 언어에 대한 제로샷 전이 성능이 ‘강력함’으로 보고되었으며, 다양한 잡음·실어증 조건에서도 스케줄러가 자동으로 경로를 전환해 성능 저하를 최소화한다. 코드와 데이터가 모두 오픈소스로 제공되어 재현성과 확장성이 높다.

이러한 설계는 음성 인식 시스템이 단일 피드포워드 파이프라인에 머무르는 한계를 넘어, 인간 청각의 폐쇄‑루프, 다경로 특성을 구현한다는 점에서 학계와 산업계 모두에게 중요한 시사점을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기