통합 멀티모달 다중과제 학습 프레임워크 UVM3TL

초록

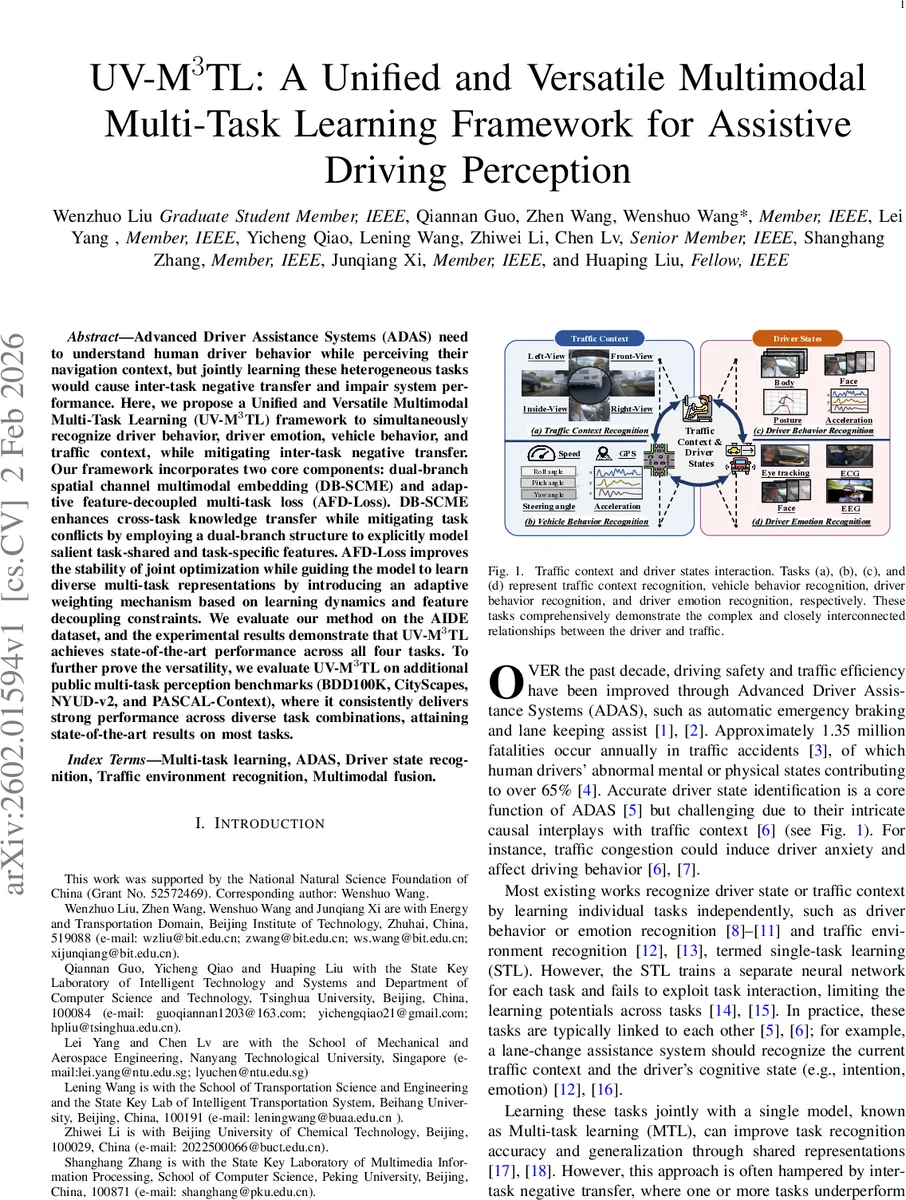

UVM3TL은 운전자 행동·감정, 차량 동작, 교통 상황 네 가지 과제를 동시에 학습하도록 설계된 멀티모달 다중과제 학습 프레임워크이다. 이 시스템은 이중‑branch 공간‑채널 임베딩(DB‑SCME)과 학습 동적 가중치를 적용한 적응형 특징‑분리 손실(AFD‑Loss)을 핵심으로 하여 과제 간 부정적 전이를 억제하고 최적화 불균형을 완화한다. AIDE 데이터셋과 BDD100K, CityScapes, NYUD‑v2, PASCAL‑Context 등 다섯 개 공개 벤치마크에서 전반적인 성능 향상을 입증하였다.

상세 분석

UVM3TL은 기존 다중과제 학습(MTL)에서 흔히 발생하는 ‘부정적 전이(negative transfer)’ 문제를 근본적으로 해결하고자 두 가지 혁신적인 모듈을 도입한다. 첫 번째인 이중‑branch 공간‑채널 멀티모달 임베딩(DB‑SCME)은 입력 데이터를 공간 차원과 채널 차원으로 각각 분리한 뒤, 공유‑특화(branch‑shared)와 전용‑특화(branch‑specific) 두 흐름으로 동시에 처리한다. 공유 흐름은 서로 다른 과제 간에 공통적인 시맨틱 정보를 추출하도록 설계돼, 예를 들어 교통 상황 인식과 차량 동작 예측에 공통으로 필요한 도로 구조와 움직임 패턴을 효과적으로 전파한다. 반면 전용 흐름은 각 과제의 고유한 특징—운전자의 얼굴 표정, 생체 신호, 차량 가속도 등—을 별도로 강화함으로써 과제 간 충돌을 최소화한다. 공간‑채널 어텐션 메커니즘을 적용해 중요한 영역에 가중치를 집중하고, 멀티‑뷰 이미지와 LiDAR 포인트 클라우드 등 이질적인 모달리티를 동시 처리한다는 점이 특히 주목할 만하다.

두 번째 핵심인 적응형 특징‑분리 손실(AFD‑Loss)은 두 단계로 구성된다. 첫 단계는 학습 진행 상황(손실 감소 속도, 그라디언트 변동성 등)을 실시간으로 모니터링하여 각 과제의 손실 가중치를 동적으로 조정한다. 이를 통해 초기 학습 단계에서 손실 규모가 큰 과제가 과도하게 지배하는 현상을 방지하고, 후반부에는 수렴이 느린 과제에 더 큰 비중을 부여한다. 두 번째 단계는 특징‑분리 제약을 도입해 공유 파라미터와 전용 파라미터 사이의 상관관계를 최소화한다. 구체적으로, 공유 특징과 전용 특징 사이의 코사인 유사도를 억제하는 정규화 항을 손실에 추가함으로써 두 흐름이 서로 독립적인 표현을 학습하도록 유도한다. 이 설계는 단순히 손실 스케일을 맞추는 기존 방법과 달리, 실제 특징 공간에서의 중복을 감소시켜 각 과제의 표현력을 크게 향상시킨다.

실험 결과는 이러한 설계가 실제 운전 보조 시스템에 얼마나 유용한지를 입증한다. AIDE 데이터셋에서는 운전자 행동, 감정, 차량 동작, 교통 상황 네 과제 모두 평균 1.4%~13.5%의 정확도 상승을 기록했으며, 특히 과제 간 상호 의존성이 높은 상황에서 단일‑과제 학습 대비 4%~5% 이상의 성능 저하를 방지했다. 또한 BDD100K, CityScapes, NYUD‑v2, PASCAL‑Context와 같은 다양한 도메인·과제 조합에서도 전반적인 mIoU, mAcc, RMSE 등 주요 지표에서 기존 최첨단 모델들을 앞섰다. Ablation study에서는 DB‑SCME 없이 AFD‑Loss만 적용했을 때와, 반대로 손실만 적용했을 때 각각 성능이 현저히 떨어지는 것을 확인함으로써 두 모듈이 상호 보완적으로 작동함을 증명했다.

요약하면, UVM3TL은 (1) 멀티모달 입력을 효율적으로 통합하는 이중‑branch 임베딩, (2) 학습 동적 가중치와 특징‑분리 정규화를 결합한 적응형 손실, (3) 다양한 실세계 데이터셋에 대한 범용성 검증이라는 세 축을 통해 기존 MTL의 한계를 극복하고, 복합적인 운전 상황 인식에 필요한 고도화된 표현 학습을 가능하게 한다.

댓글 및 학술 토론

Loading comments...

의견 남기기