텍스트 기반 인간‑객체 상호작용을 위한 대화형 아바타 생성 프레임워크

초록

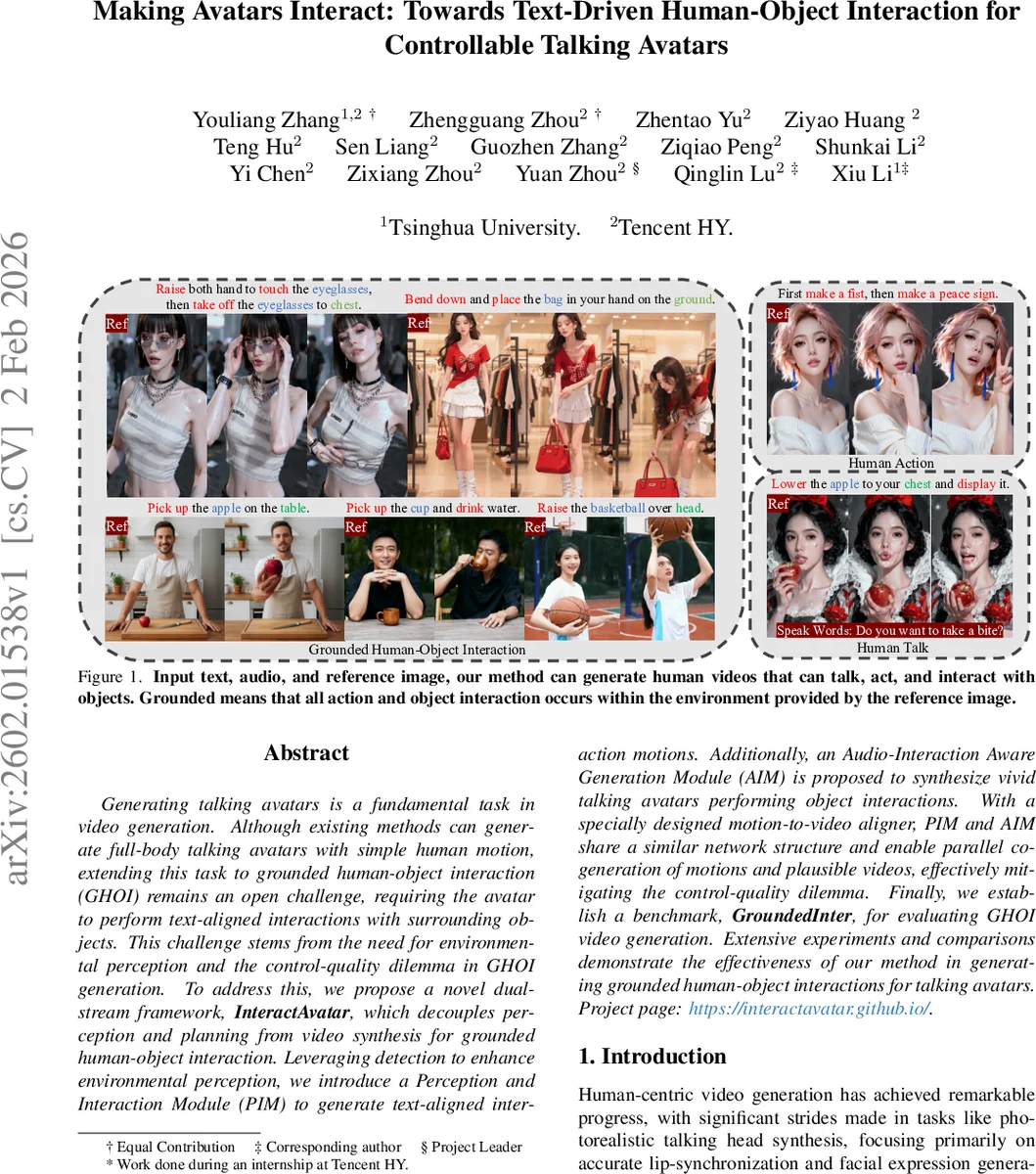

InteractAvatar는 환경 인식을 위한 탐지 모듈과 텍스트‑오디오 조건을 결합한 두 개의 디퓨전 트랜스포머(PIM, AIM)를 통해, 주어진 이미지와 음성에 맞춰 객체와 상호작용하는 고품질 대화형 아바타 영상을 생성한다. 새로운 GroundedInter 벤치마크에서 기존 방법들을 크게 앞선다.

상세 분석

본 논문은 “Grounded Human‑Object Interaction (GHOI)”이라는 새로운 과제를 정의하고, 이를 해결하기 위해 두 단계로 작업을 분리하는 Dual‑Stream Diffusion Transformer(DiT) 구조를 제안한다. 첫 번째 스트림인 Perception and Interaction Module(PIM)은 입력 텍스트와 레퍼런스 이미지에서 객체 위치와 장면 레이아웃을 탐지하고, 이를 기반으로 인간 골격 키포인트와 객체 바운딩 박스의 시공간 시퀀스(모션)를 생성한다. 여기서 핵심은 탐지와 모션 생성 작업을 하나의 네트워크에 통합한 ‘Flow Matching’ 학습 방식이다. PIM은 두 가지 학습 모드(Conditional Continuation, Perception‑as‑Generation)를 교대로 수행해, 이미지‑텍스트‑모션 간의 상호 연관성을 강화한다.

두 번째 스트림인 Audio‑Interaction aware Generation Module(AIM)은 PIM이 만든 모션 잠재벡터와 오디오 특징(Wav2Vec 기반)을 동시에 입력받아, 고해상도 비디오 프레임을 직접 디퓨전한다. 중요한 설계는 Motion‑to‑Video(M2V) Aligner로, 레이어‑와이즈 잔차 주입을 통해 PIM의 구조적 정보를 AIM에 실시간으로 전달한다. 이로써 모션과 비디오가 병렬적으로 공동 생성되면서, “제어‑품질 딜레마”(controllability vs. visual fidelity)를 효과적으로 완화한다.

또한, 레퍼런스 이미지를 가상의 타임스텝 -1에 삽입하고 RoPE를 재매핑함으로써, 이미지가 전체 시퀀스에 전역적인 컨디션을 제공하면서도 시간 인코딩과 충돌하지 않게 만든 점이 눈에 띈다.

데이터 측면에서는 600개의 텍스트‑오디오‑이미지 쌍으로 구성된 GroundedInter 벤치마크를 구축해, 장면‑행동 정합성, 객체 상호작용 정확도, 립싱크 품질 등을 다각도로 평가한다. 실험 결과, InteractAvatar는 기존 오디오‑구동 전체신체 애니메이션(OmniHuman‑1 등)과 HOI‑조건 기반 생성(AnchorCrafter, ManiVideo 등) 대비 정량·정성 지표 모두에서 우수함을 보인다.

한계점으로는 현재 2D 바운딩 박스 기반 객체 표현에 머물러 있어, 복잡한 3D 형태나 물리적 상호작용(예: 물체 잡고 흔들기)에는 확장성이 부족하다. 또한, 탐지 모듈이 사전 학습된 객체 검출기에 의존하므로, 레퍼런스 이미지에 존재하지 않는 새로운 객체에 대한 일반화가 제한적일 수 있다. 향후 연구에서는 3D 장면 재구성, 물리 엔진 연동, 그리고 멀티‑객체 동시 상호작용을 위한 보다 정교한 모션 표현이 필요하다.

댓글 및 학술 토론

Loading comments...

의견 남기기