효율적인 비전‑언어 모델을 위한 게이트형 관계 정렬 및 신뢰 기반 증류

초록

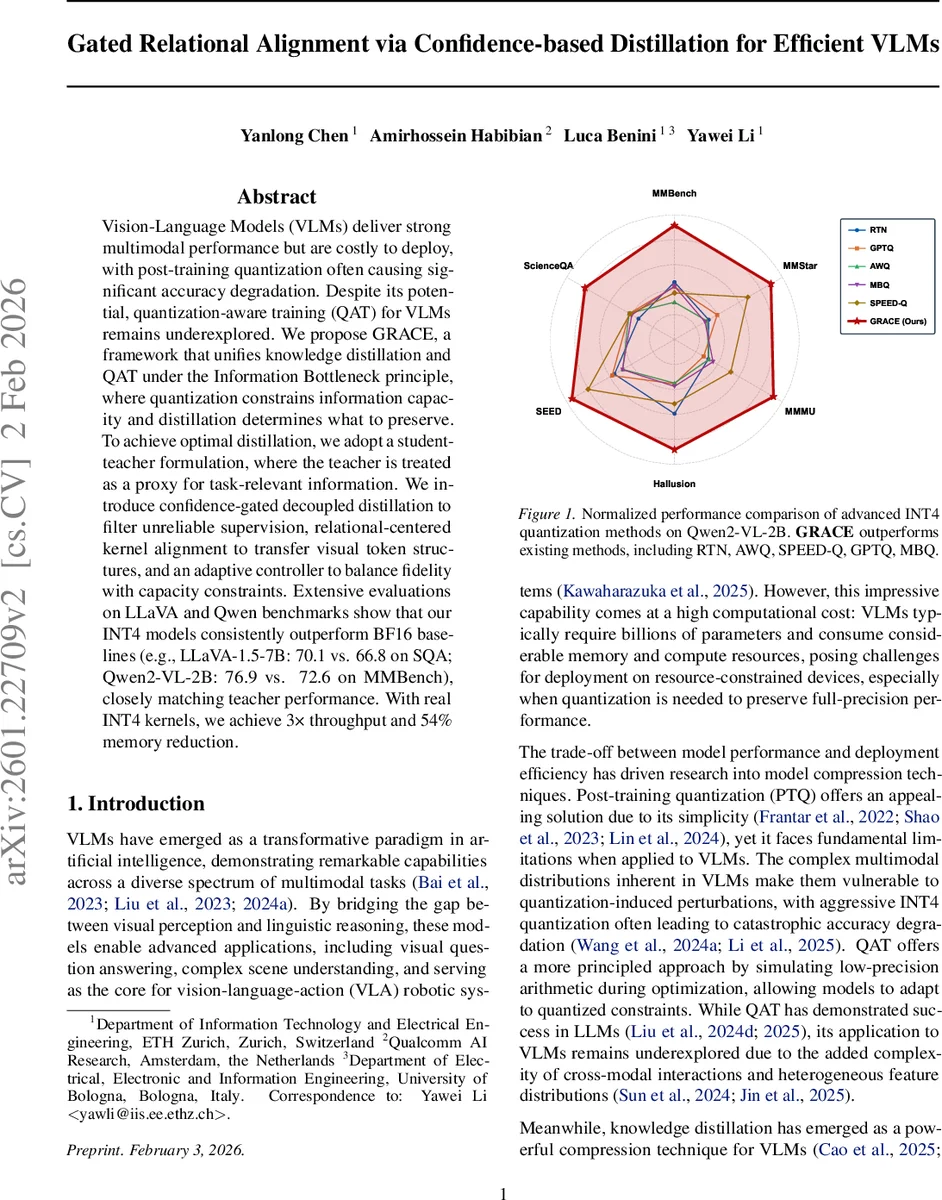

GRACE는 정보 병목 원리를 기반으로 양자화 인식 훈련(QAT)과 지식 증류를 통합한 프레임워크이다. 교사의 예측 신뢰도에 따라 증류 손실을 게이트하고, 시각 토큰 간의 관계를 중심으로 커널 정렬(CKA)을 수행한다. 적응형 컨트롤러가 정보 용량과 정확도 사이의 균형을 동적으로 조절한다. INT4 양자화된 VLM이 BF16 기준을 넘어서는 성능을 보이며, 3배 가속과 메모리 54% 절감 효과를 달성한다.

상세 분석

GRACE는 비전‑언어 모델(VLM) 압축에 있어 두 가지 핵심 문제, 즉 양자화에 따른 정보 용량 제한과 어떤 정보를 보존해야 하는가라는 질문을 정보 병목(Information Bottleneck, IB) 프레임워크로 공식화한다. 양자화는 모델이 사용할 수 있는 비트 수를 고정함으로써 ‘용량’ 제약을 만들고, 증류는 교사 모델이 제공하는 ‘과밀한’ 정보 흐름을 학생 모델에 전달한다. 이때 교사의 출력 엔트로피를 신뢰도 지표로 활용해 고엔트로피(불확실) 샘플에 대한 증류 기여도를 지수적으로 감소시키는 게이트 함수를 도입한다. 이는 “Confidence‑Gated Decoupled Knowledge Distillation”이라 불리며, 기존 KL‑기반 증류가 모든 토큰을 동등하게 취급하던 한계를 극복한다.

또한, 단순히 로짓 수준의 정답 확률을 맞추는 것이 아니라 시각 토큰 간의 구조적 관계를 보존해야 한다는 점을 강조한다. 이를 위해 교사와 학생의 시각 토큰 행렬에 대해 중심화된 커널(Centered Kernel)을 계산하고, 두 커널 간의 정규화된 상관(CKA) 값을 최대화하는 “Relational Centered Kernel Alignment(RCKA)” 손실을 설계한다. 이 손실은 토큰 간 유사도 패턴, 즉 시각적 attention 맵의 형태를 그대로 전달함으로써, 작은 학생 모델이 교사의 고차원 시각 추론 과정을 모방하도록 돕는다.

양자화‑인식 훈련 단계에서는 그룹별 학습 가능한 스텝 사이즈(LSQ)를 사용해 가중치를 직접 양자화한다. 여기서 핵심은 ‘Adaptive IB Controller’이다. 이 컨트롤러는 EMA‑smooth된 게이트된 DKD 손실을 모니터링하고, 사전 정의된 임계값 τ에 따라 증류 가중치 β를 동적으로 증가·감소시킨다. 즉, 현재 학생이 용량 제한에 어느 정도 적응했는지를 실시간으로 판단해, 과도한 증류로 인한 과적합을 방지하고, 용량이 충분히 확보되면 증류 강도를 높여 교사의 정보를 최대한 흡수한다.

이론적 분석에서는 (1) 게이트된 손실이 교사의 엔트로피와 손실 간의 음의 공분산을 갖는다는 정리를 제시해, 신뢰도가 낮은 샘플이 손실에 미치는 부정적 영향을 수학적으로 증명한다. (2) KL‑다이버전스가 교사와 학생 사이의 정보 격차를 정량화하는 변분 하한(VLB) 역할을 함을 보이며, 손실 최소화가 학생 표현 Zₛ와 교사 라벨 Yₜ 사이의 상호 정보 I(Zₛ;Yₜ)를 극대화한다는 정보를 제공한다.

실험에서는 LLaVA‑1.5와 Qwen2‑VL 계열 모델에 INT4 양자화를 적용했으며, SQA, MMBench 등 다중 멀티모달 벤치마크에서 BF16 기준을 3~5%p 상회하는 결과를 얻었다. 특히 Qwen2‑VL‑2B는 INT4에서도 79.1점(SQA)으로 FP16(73.7점)을 능가했으며, 실제 INT4 커널을 사용해 3배의 추론 속도와 54% 메모리 절감을 달성했다. 비교 대상인 RTN, AWQ, SPEED‑Q, GPTQ, MBQ 등 기존 양자화 기법보다 일관되게 우수한 성능을 보였다.

요약하면, GRACE는 (1) 교사 신뢰도 기반의 선택적 증류, (2) 시각 토큰 관계 정렬, (3) 용량‑정밀도 균형을 자동으로 조절하는 적응형 컨트롤러라는 세 가지 혁신적 요소를 결합해, 극한 INT4 양자화 환경에서도 VLM의 멀티모달 이해 능력을 거의 손실 없이 유지한다는 점에서 의미가 크다.

댓글 및 학술 토론

Loading comments...

의견 남기기