노이즈를 줄이고 목소리를 높이다 토큰 정화로 강화학습 추론 효율 향상

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

본 논문은 대형 언어 모델(LLM) 추론에서 소수의 방해 토큰이 탐색 효율을 크게 저해한다는 사실을 발견하고, 이를 제거·전이하는 두 단계 프레임워크 LENS를 제안한다. 방해 토큰를 정량화한 ‘Interference Score’를 기반으로 프롬프트를 정화하고, 정화된 프롬프트에서 얻은 성공 롤아웃을 원본(노이즈가 있는) 프롬프트에 교정 신호로 활용한다. 실험 결과 LENS는 기존 GRPO 대비 평균 3.88% 성능 향상과 1.6배 빠른 수렴을 달성한다.

상세 분석

RLVR(Reinforcement Learning with Verifiable Rewards)은 LLM의 복합 추론 능력을 강화하기 위해 롤아웃 성공률에 의존한다. 그러나 고차원 행동 공간과 이진 보상의 지연으로 인해 성공 롤아웃이 극히 드물어 학습이 불안정해지는 문제가 있다. 기존 연구는 롤아웃 수를 늘리거나 제로‑분산 프롬프트를 필터링하는 두 축으로 접근했지만, 전자는 계산 비용이 급증하고 후자는 어려운 샘플을 포기한다는 한계가 있다.

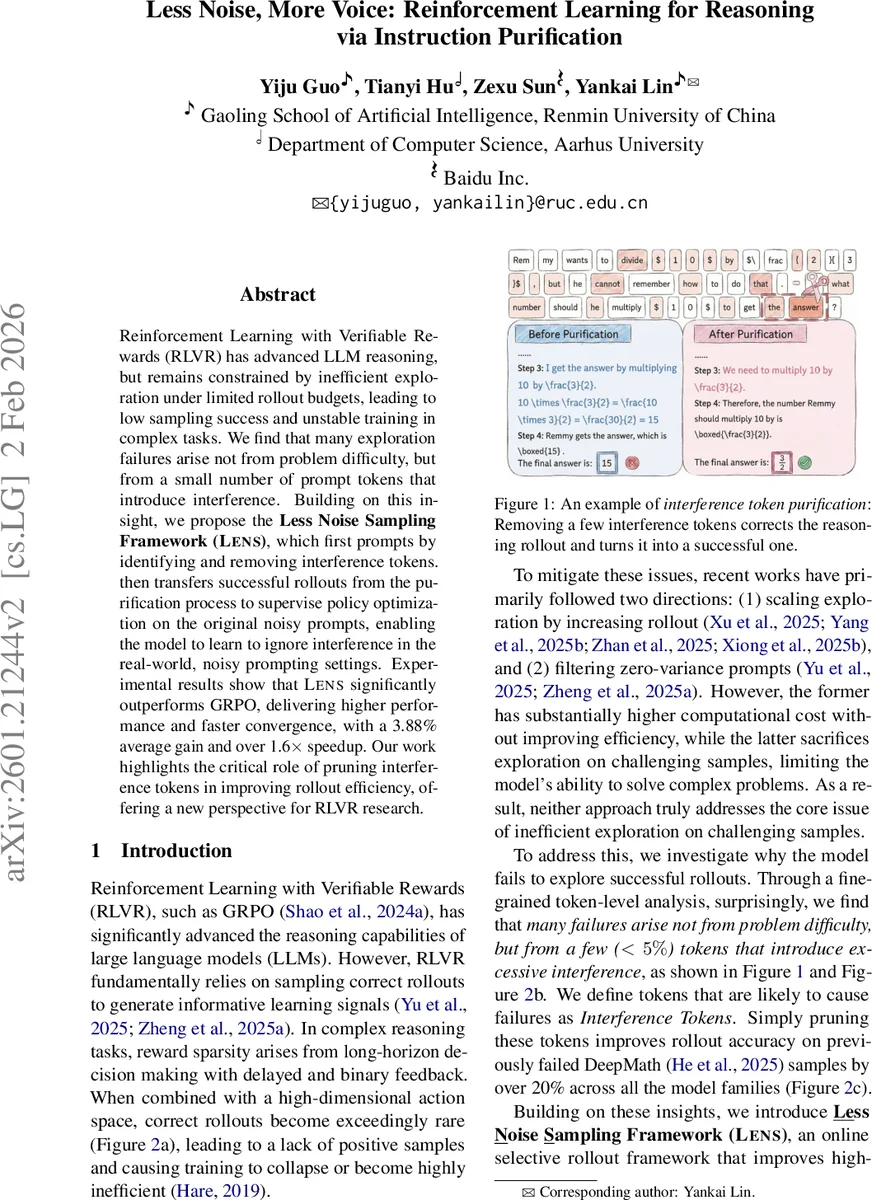

이 논문은 토큰 수준의 정밀 분석을 통해 전체 실패의 <5%를 차지하는 소수의 ‘Interference Tokens’가 주요 원인임을 밝혀냈다. 이러한 토큰은 현재 정책 πθ와 사전 학습된 레퍼런스 정책 πref 사이의 KL 발산을 크게 일으키며, 과도한 보상 오버‑옵티마이제이션이나 노이즈에 의해 생성된다. 저자들은 이를 정량화하기 위해

\

댓글 및 학술 토론

Loading comments...

의견 남기기