코드 기반 추론으로 의미 관성 극복

초록

**

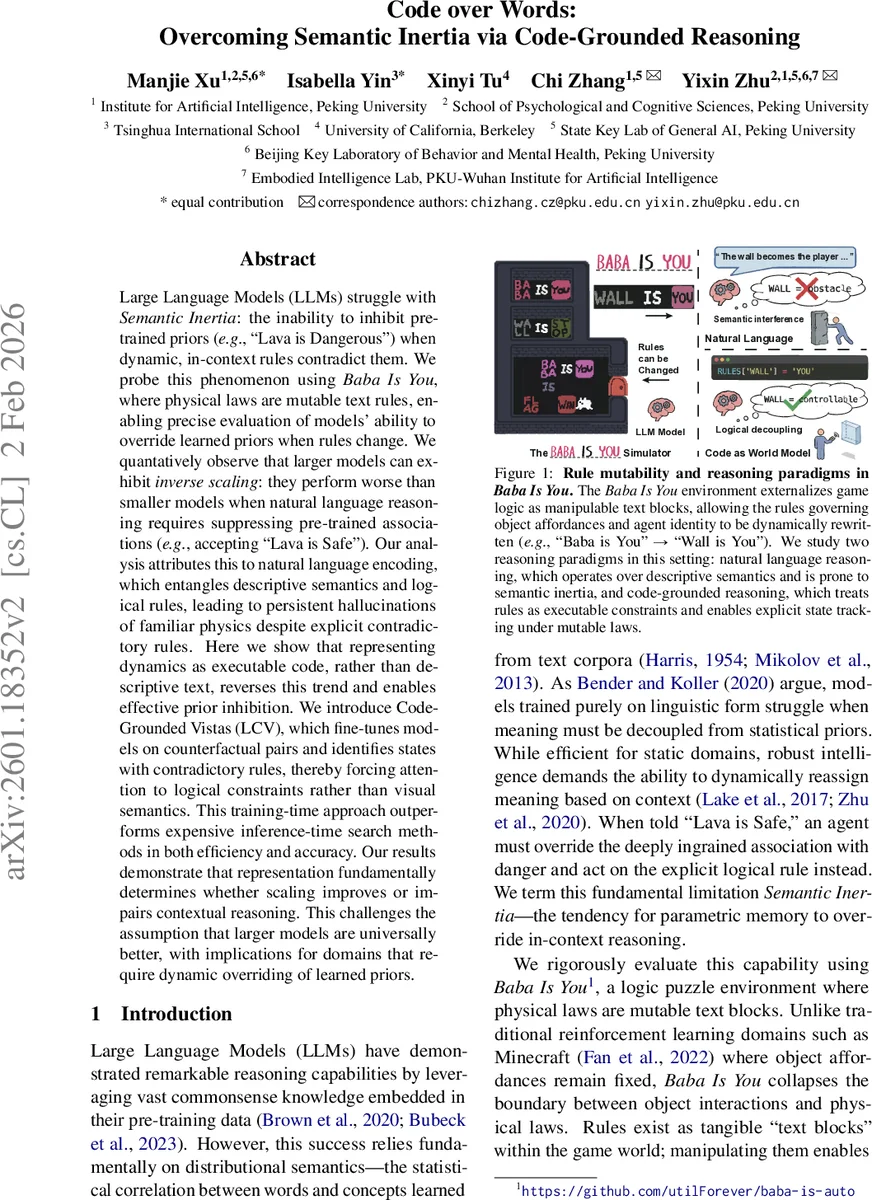

본 논문은 대형 언어 모델이 사전 학습된 의미 편향(예: “용암은 위험하다”)을 상황에 따라 억제하지 못하는 ‘의미 관성’ 문제를 지적한다. 변형 가능한 규칙을 텍스트 블록으로 제공하는 퍼즐 게임 Baba Is You 를 실험 플랫폼으로 삼아, 모델 크기가 커질수록 오히려 이러한 편향을 극복하기 어려워지는 역스케일링 현상을 발견한다. 이를 해결하기 위해 규칙을 실행 가능한 파이썬 코드로 변환하는 Code‑Grounded Vistas (LCV) 를 제안하고, 코드 기반 표현이 의미 관성을 크게 완화함을 실증한다.

**

상세 분석

**

논문은 먼저 “Semantic Inertia”라는 개념을 정의한다. 이는 사전 학습 단계에서 축적된 분포적 의미 연결이, 인‑컨텍스트에서 제시되는 논리적 규칙과 충돌할 때 모델이 기존 편향을 억제하지 못하고 잘못된 추론을 내놓는 현상을 말한다. 이를 정량화하기 위해 저자들은 텍스트 기반 규칙이 자유롭게 변형되는 퍼즐 게임 Baba Is You 를 선택했다. 게임 내에서 “벽은 당신이다”, “용암은 안전하다”와 같이 사전 지식과 모순되는 규칙을 제시하면, 모델은 해당 규칙을 무시하고 기존 의미에 기반한 행동을 예측한다.

실험에서는 Llama‑3, Pythia, Qwen2.5 등 160 M ~ 70 B 파라미터 규모의 다양한 모델을 대상으로 자연어 프롬프트와 코드 기반 프롬프트 두 가지 조건에서 다음 토큰 확률 차이 ΔP를 측정했다. ΔP = P(논리 기반 | 상태) − P(사전 기반 | 상태) 로 정의했으며, 음수 값이 의미 관성을 나타낸다. 결과는 자연어 조건에서 모델이 클수록 ΔP가 더 크게 음수로 변해 역스케일링이 발생함을 보여준다. 이는 대형 모델이 더 풍부한 인간‑중심 지식을 내재하고 있어, 충돌 상황에서 기존 편향을 더욱 강하게 고수한다는 해석이 가능하다.

반면 동일한 상황을 코드 형태(예: if WALL_IS_YOU: move() 등)로 표현하면, 모델은 토큰 예측이 아니라 실행 가능한 프로그램을 생성하도록 유도된다. 코드에서는 심볼 자체가 의미를 갖지 않고, 오직 변수 할당과 조건문이 논리적 제약을 담당한다. 이때는 규모가 큰 모델일수록 ΔP가 양수에 가깝게 상승해, 코드 기반 표현이 의미 관성을 억제하고 스케일링 이점을 회복시킴을 확인했다.

이러한 관찰을 바탕으로 저자들은 LCV (Code‑Grounded Vistas) 라는 프레임워크를 설계했다. LCV는 (1) 규칙‑상태 쌍을 포함한 카운터팩추얼 대비 데이터셋을 구축하고, (2) 모델이 입력된 텍스트와 현재 규칙을 파이썬 함수 형태의 전이 함수 T(s, R) 로 변환하도록 fine‑tuning한다. 이렇게 학습된 모델은 테스트 시 별도의 탐색‑디버깅 루프 없이 단일 패스에서 올바른 전이 함수를 출력한다. 실험 결과, LCV는 기존의 추론‑시간 generate‑test‑debug 방식보다 4배 이상 빠른 추론 속도를 보이며, 의미 관성 점수(ΔP)와 성공률 모두 크게 향상된다.

핵심 인사이트는 표현 방식이 모델의 추론 능력을 근본적으로 좌우한다는 점이다. 자연어는 의미와 논리를 얽히게 만들어 사전 편향을 피하기 어렵지만, 코드와 같은 형식적 언어는 의미를 명시적으로 분리해 논리 연산에만 집중하게 만든다. 따라서 대형 모델이 반드시 더 나은 추론을 제공한다는 일반적 가정은, 특히 동적 온톨로지를 필요로 하는 상황에서는 깨진다.

**

댓글 및 학술 토론

Loading comments...

의견 남기기