인구통계 정렬 LLM의 대표성 평가: 한계와 새로운 프레임워크

초록

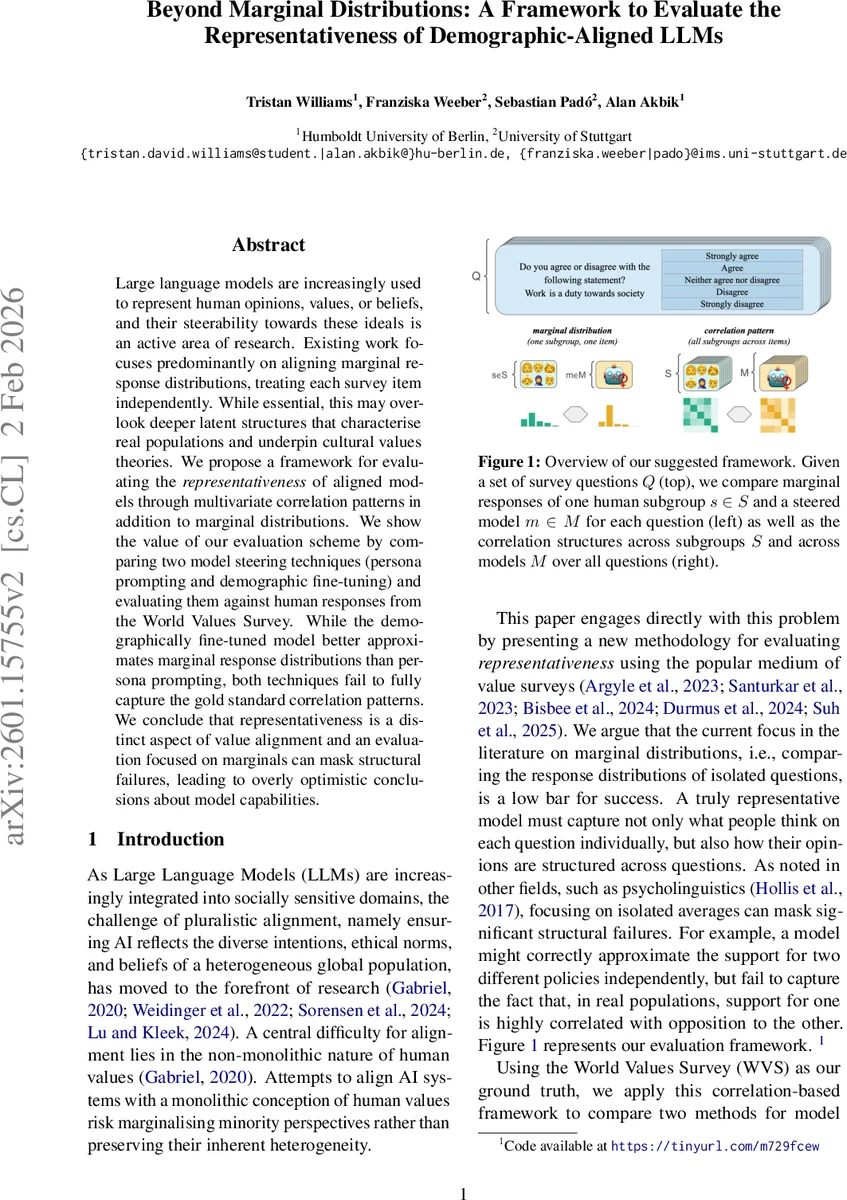

본 논문은 대규모 언어 모델(LLM)의 대표성을 평가하기 위해 설문 응답의 주변 분포뿐 아니라 질문 간 상관 구조까지 고려하는 프레임워크를 제시한다. 세계가치조사(WVS) 데이터를 기준으로 인격 프롬프트(persona prompting)와 인구통계 기반 파인튜닝(OpinionGPT)을 비교한 결과, 파인튜닝이 주변 분포에서는 우수하지만 두 방법 모두 인간 응답이 보이는 다변량 상관 패턴을 충분히 재현하지 못한다는 점을 밝힌다.

상세 분석

이 연구는 LLM 정렬에서 “대표성”을 기존의 주변 분포 일치만으로는 충분히 측정할 수 없다는 근본적인 가정을 검증한다. 저자는 설문 항목 Q와 인구통계 하위집단 S를 정의하고, 각 하위집단에 대응하는 모델 M을 통해 생성된 응답을 실제 인간 응답과 비교한다. 주변 분포 일치는 질문별 확률분포 거리 d(·,·)의 평균 D(P_m, P_s)로 정량화하고, 응답 다양성은 정규화된 분산 V_s(P)로 측정한다. 핵심은 다변량 상관 구조를 평가하는 단계이다. 인간과 모델 각각에 대해 질문‑질문 상관 행렬 C_true, C_sim을 구축하고, Pearson 상관계수 ρ와 RMSE를 이용해 구조적 일치도를 평가한다. 이때 ρ는 상관 패턴의 상대적 순서를, RMSE는 절대적인 상관 강도를 반영한다.

실험에서는 phi‑3 기반의 비정렬 베이스라인, 인격 프롬프트 적용 모델, 그리고 OpinionGPT 파인튜닝 모델을 10개의 인구통계 하위집단(성별, 연령, 지역, 정치 성향)으로 구성하였다. 평가 데이터는 최신 세계가치조사(193문항)이며, 설문 가중치를 적용해 실제 응답 분포를 재현한다. 결과는 파인튜닝 모델이 D 점수에서 비정렬 모델보다 현저히 낮아 주변 분포를 더 잘 모사하지만, ρ와 RMSE 측면에서는 두 모델 모두 인간 응답의 상관 구조를 충분히 재현하지 못함을 보여준다. 특히, 인격 프롬프트는 특정 질문에 대해 편향된 응답을 생성해 다양성(V)에서도 손실이 크다.

이러한 발견은 대표성이 단순히 평균 응답을 맞추는 것이 아니라, 질문 간 내재된 문화·가치 차원을 보존해야 함을 시사한다. 따라서 향후 LLM 정렬 연구는 다변량 구조를 목표로 하는 새로운 스티어링 기법(예: 구조적 파인튜닝, 다중 태스크 학습)과 평가 메트릭을 개발해야 한다.

댓글 및 학술 토론

Loading comments...

의견 남기기