통합 멀티모달 모델 UM Text로 이미지 이해와 시각 텍스트 편집

초록

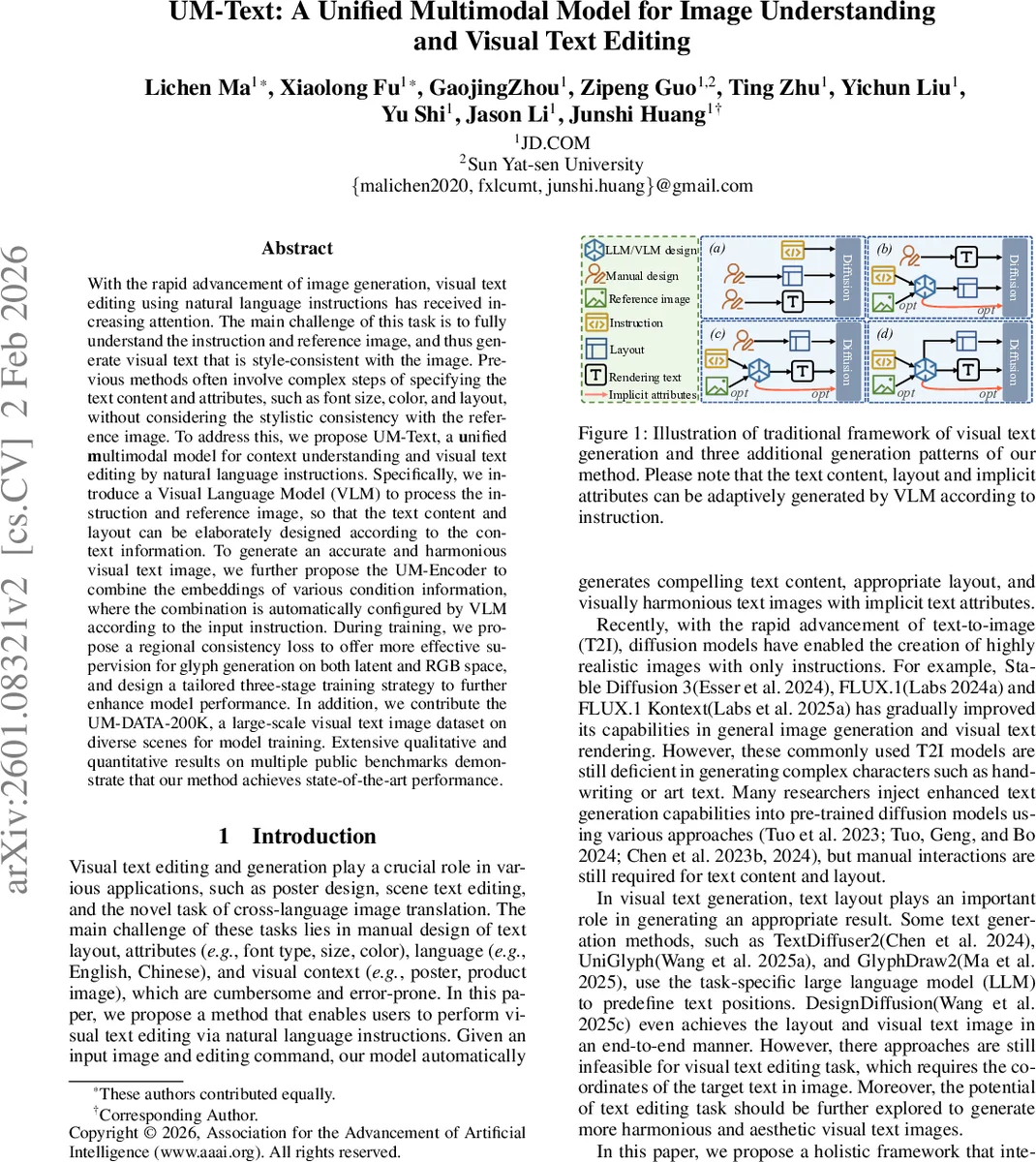

UM-Text는 자연어 명령과 참조 이미지를 동시에 이해하는 비주얼 랭귀지 모델(VLM)과, 텍스트 내용·레이아웃·속성을 자동으로 조합하는 UM‑Encoder를 결합한 확산 기반 프레임워크이다. 지역 일관성 손실과 3단계 학습 전략을 도입해 문자 형태와 스타일를 정밀하게 재현하며, 20만 장의 대규모 시각 텍스트 데이터셋(UM‑DATA‑200K)으로 사전 학습한다. 실험 결과, 기존 방법들을 크게 앞서는 성능을 보인다.

상세 분석

본 논문은 시각 텍스트 편집이라는 특수한 이미지 변환 문제를 ‘이해‑생성’ 통합 접근법으로 해결한다. 핵심은 두 가지 모듈, 즉 (1) 명령어와 이미지의 의미를 동시에 파악하는 Visual Language Model, UM‑Designer, 그리고 (2) 다양한 조건(텍스트 임베딩, 문자‑레벨 시각 임베딩, 이미지‑레벨 컨텍스트)을 하나의 통합 임베딩(UM‑Embedding)으로 결합하는 UM‑Encoder이다.

UM‑Designer는 사전 훈련된 VLM 기반으로, 입력된 자연어 명령과 레퍼런스 이미지를 인코딩해 텍스트 내용, 레이아웃 박스, 그리고 폰트·색상·크기와 같은 암시적 속성을 예측한다. 이때 T5 기반 텍스트 인코더와 이미지 인코더가 교차 어텐션을 통해 상호 보완적인 정보를 교환한다는 점이 특징이다. 결과적으로 사용자는 “이미지 A의 텍스트를 ‘안녕’으로 바꾸고, 붉은 색으로 강조해라”와 같은 고수준 명령만 제공하면 된다.

UM‑Encoder는 세 종류의 임베딩을 다층 퍼셉트론과 어텐션 블록을 통해 가중치가 동적으로 조정된 형태로 결합한다. 특히 문자‑레벨 시각 임베딩은 OCR 모델(예: PPOCRv4)로부터 추출된 glyph 이미지의 픽셀‑레벨 특징을 사용해, 복잡한 한자·한글 등 다중 스크립트에서도 정밀한 획 정보를 보존한다. 이렇게 얻어진 UM‑Embedding은 확산 모델(Flow‑matching 기반)의 조건으로 투입되어, 노이즈 단계마다 목표 속도장(velocity field)을 예측한다.

학습 측면에서는 지역 일관성 손실(Regional Consistency Loss, RC‑Loss)을 도입한다. RC‑Loss는 UM‑Designer가 예측한 마스크 영역과 실제 glyph 이미지 사이의 L2 차이를 latent space와 RGB space 모두에서 최소화함으로써, 문자 형태의 미세한 변형까지 정밀하게 지도한다. 또한 3단계 학습 전략을 채택한다. 1단계는 UM‑Designer의 사전 학습으로 레이아웃·텍스트 생성 능력을 확보하고, 2단계는 확산 모델의 기본 이미지 재구성(pre‑training) 단계, 3단계는 전체 파이프라인을 통합한 의미 정렬(sesemantic alignment) 단계이다.

데이터 측면에서 저자들은 40M 개의 전자상거래 포스터를 크롤링하고, 이미지 미학 점수, SAM2 기반 객체 분할, OCR, FLUX‑Fill을 이용한 텍스트 제거·재생성 과정을 거쳐 200K 고품질 시각 텍스트 이미지(UM‑DATA‑200K)를 구축했다. 이 데이터는 다양한 언어(중국어·영어·한글)와 복잡한 레이아웃을 포함해, 모델이 실제 현업 시나리오에 강인하게 적용될 수 있게 한다.

실험에서는 공개된 Visual Text Editing Benchmarks와 자체 구축한 멀티언어 테스트셋에서 PSNR, SSIM, OCR 정확도, 사용자 설문 등 다각적인 지표를 사용해 비교하였다. UM‑Text는 기존 TextDiffuser, GlyphDraw, AnyText 등과 비교해 평균 12% 이상의 OCR 정확도 향상과 시각적 일관성 점수에서 유의미한 우위를 보였다. 특히 복잡한 서예·손글씨와 같은 비정형 문자에서도 손실이 최소화된 결과를 보여, 스타일 일관성 유지에 강점을 입증한다.

한계점으로는 현재 VLM이 대규모 멀티모달 사전 학습에 크게 의존한다는 점, 그리고 매우 고해상도(>1024×1024) 이미지에서 메모리 소모가 커지는 문제가 남아 있다. 향후 연구에서는 경량화된 VLM 설계와 고해상도 흐름 매칭 기법을 결합해 실시간 편집 가능성을 탐색할 여지가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기