실시간 양방향 토킹헤드 생성 DyStream

초록

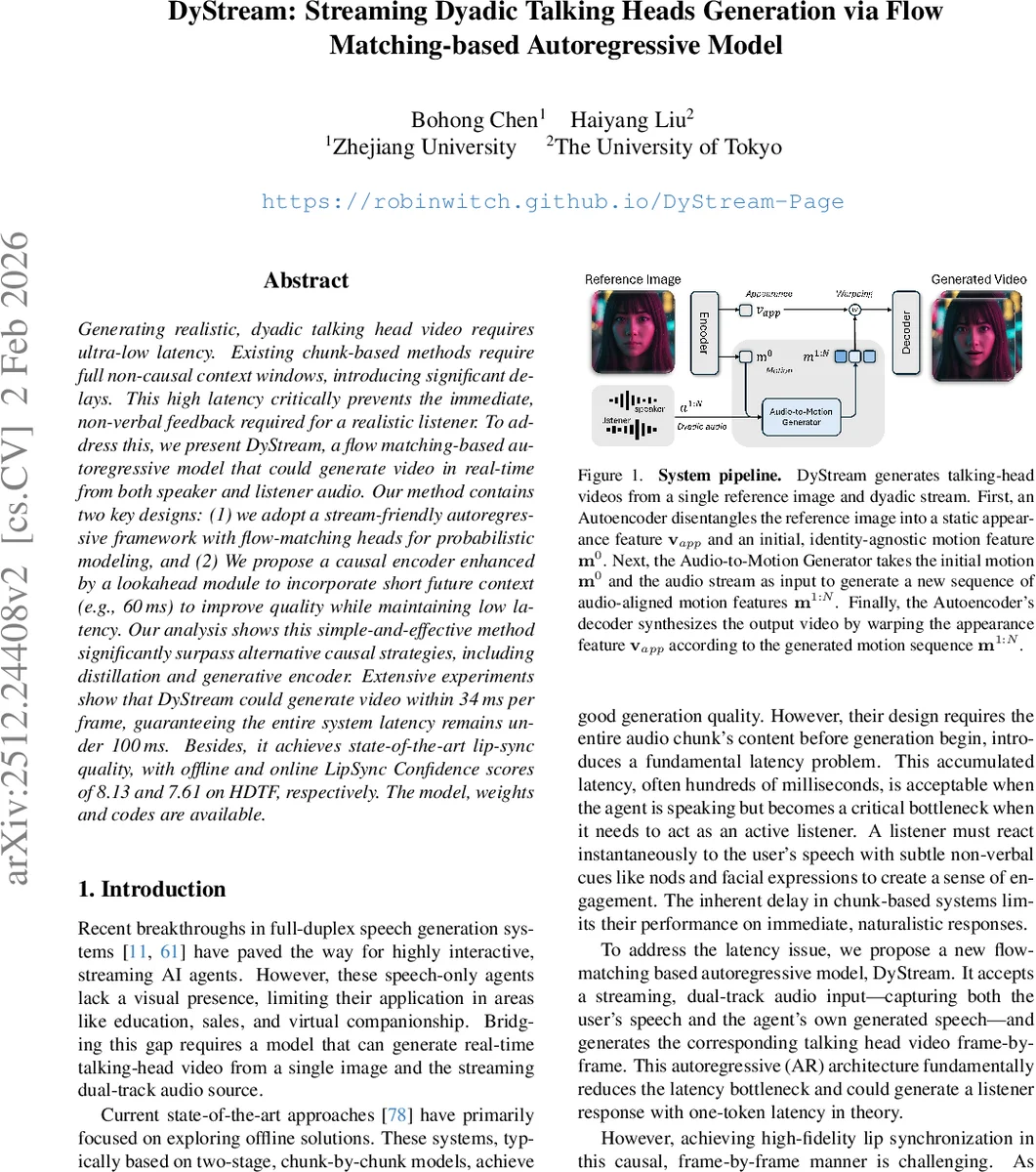

DyStream는 화자와 청자의 오디오 스트림을 동시에 입력받아 프레임 단위로 실시간 토킹헤드 영상을 생성하는 모델이다. 흐름 매칭 기반의 자동회귀 구조와 60 ms 정도의 짧은 미래 오디오를 활용하는 인코더 설계로 34 ms·프레임의 생성 속도와 100 ms 이하의 시스템 레이턴시를 달성한다.

상세 분석

DyStream는 기존의 청크 기반 비인과적(비인과적) 접근법이 갖는 수백 밀리초 수준의 지연을 근본적으로 해소하기 위해 두 가지 핵심 설계를 도입한다. 첫 번째는 흐름 매칭(flow‑matching) 기법을 활용한 자동회귀(AR) 모델이다. AR 네트워크는 인코더‑디코더 구조가 아니라 1‑차원 트랜스포머 블록으로 구성돼, 현재 프레임의 모션 잠재변수 mₙ을 이전 프레임의 모션과 오디오 특징에 조건화한다. 여기서 흐름 매칭 헤드는 확률적 생성 과정을 담당하며, 노이즈‑조건화된 입력 mₜ와 시간 스텝 t, AR 네트워크가 출력한 조건 c를 받아 깨끗한 모션 잠재변수 m₀를 복원한다. 이 방식은 기존 디퓨전 기반 모델이 요구하는 다단계 역전파와 비교해 연산량을 크게 줄이며, 프레임당 34 ms라는 실시간 수준의 속도를 가능하게 한다.

두 번째 설계는 ‘미니멀 룩어헤드’ 모듈을 갖춘 인과적(causal) 오디오 인코더다. 인간의 발음은 전음성(co‑articulation) 현상으로, 현재 음소가 발음되기 전에도 입술 움직임이 미리 준비된다. 순수 인과적 모델은 이러한 미래 정보를 전혀 활용하지 못해 입술 동기화가 부자연스러워지는 문제가 있다. DyStream는 60 ms 이하의 짧은 미래 오디오를 허용하는 룩어헤드 방식을 도입해, 오디오 인코더가 현재 프레임을 예측할 때 제한된 양의 미래 정보를 참조하도록 설계했다. 구현상으로는 Wave2Vec2 기반 인코더의 그룹 정규화와 대규모 컨볼루션 포지셔널 인코딩을 각각 레이어 정규화와 RoPE(회전 위치 임베딩)로 교체하고, 어텐션 마스크를 통해 정확히 n개의 미래 프레임만을 볼 수 있게 제어한다. 이렇게 하면 오디오‑리프싱 정확도가 크게 향상되면서도 전체 시스템 레이턴시는 100 ms 이하로 유지된다.

또한, 프레임‑단위 자동회귀 과정에서 발생할 수 있는 ‘포즈 드리프트’를 방지하기 위해 앵커 조건화 전략을 적용한다. 학습 시 최근 10프레임 중 하나를 무작위로 선택해 앵커로 사용하고, 추론 시에는 최초 레퍼런스 이미지만을 고정 앵커로 삼아, 장시간 시퀀스에서도 머리 위치가 점차 이동하는 현상을 억제한다.

손실 함수는 흐름 매칭 목표인 m₀ 예측 L₂ 손실을 기본으로, 다중 조건 가이던스(CFG) 방식을 도입해 화자(S), 청자(L), 앵커(R) 각각의 조건을 가중치 wₛ, wₗ, wᵣ, wₐₗₗ 로 조절한다. 이를 통해 화자와 청자의 입술 움직임을 독립적으로 제어하면서도 전체 모션의 일관성을 유지한다.

실험 결과, DyStream는 HDTF 데이터셋에서 오프라인 LipSync Confidence 8.13, 온라인 7.61을 기록해 기존 최첨단 모델들을 앞선다. 또한 25 fps 기준 34 ms·프레임의 생성 속도와 전체 파이프라인 레이턴시 100 ms 이하를 달성해 실시간 인터랙티브 에이전트에 적합함을 입증한다.

요약하면, DyStream는 흐름 매칭 기반 자동회귀와 제한된 미래 오디오를 활용한 인과적 인코더, 그리고 앵커 기반 드리프트 억제 메커니즘을 결합해, 초저지연·고품질 양방향 토킹헤드 생성을 가능하게 한 혁신적인 프레임워크라 할 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기