비전·언어를 위한 임베딩 예측 아키텍처 VL‑JEPA: 토큰 생성 없이 실시간 멀티모달 이해

초록

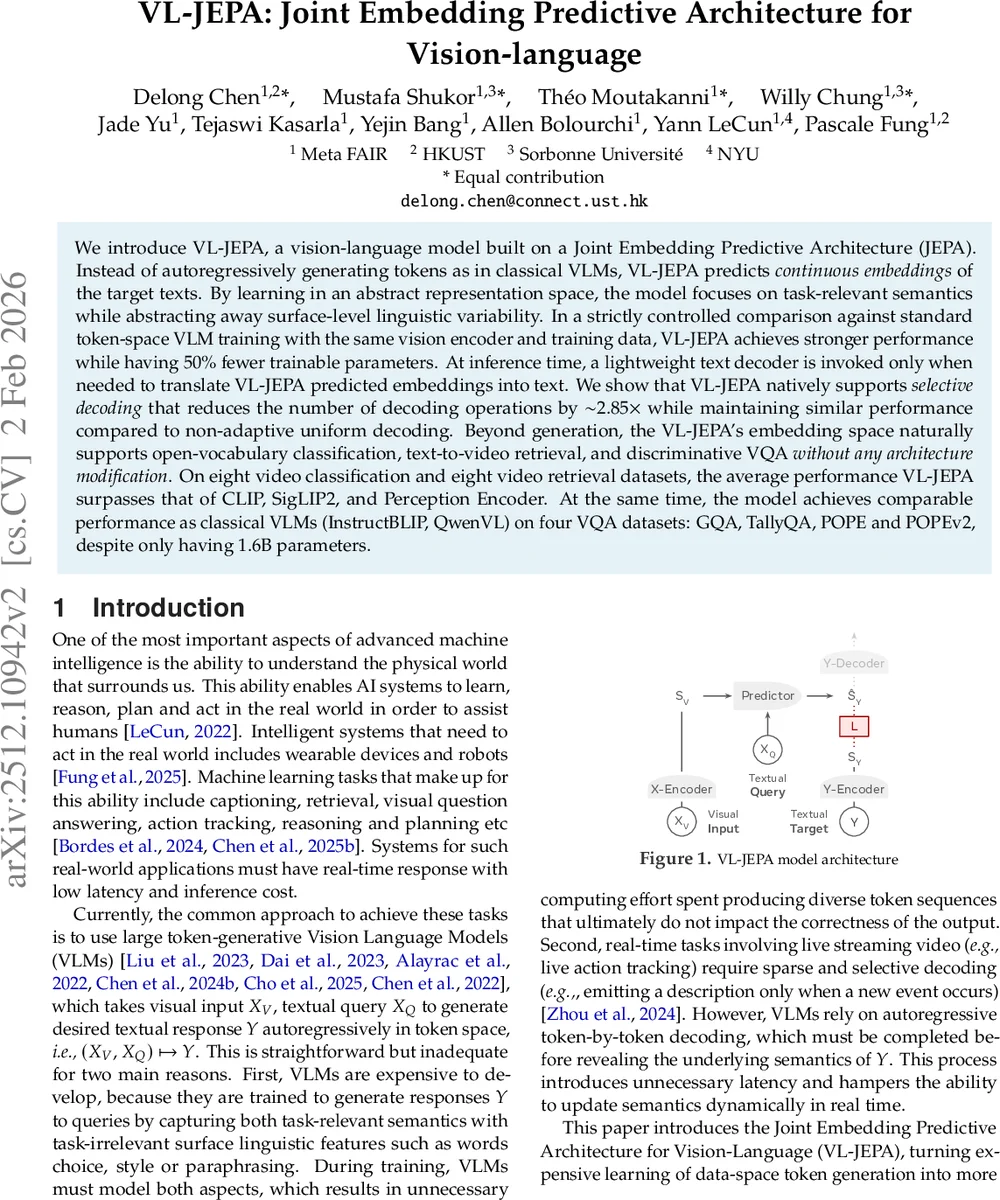

VL‑JEPA는 전통적인 토큰 기반 비전‑언어 모델(VLM) 대신 연속 임베딩을 예측하는 Joint Embedding Predictive Architecture를 제안한다. 시각 입력을 임베딩으로 압축하고, 질의와 결합해 목표 텍스트 임베딩을 직접 예측함으로써 파라미터 50 % 절감과 학습·추론 효율성을 동시에 달성한다. 선택적 디코딩 메커니즘을 통해 필요할 때만 가벼운 텍스트 디코더를 호출해 실시간 스트리밍 환경에 적합하며, 8개 영상 분류·8개 영상 검색 벤치마크에서 CLIP·SigLIP2·Perception Encoder를 능가하고, VQA 4개 데이터셋에서 InstructBLIP·QwenVL에 필적한다.

상세 분석

VL‑JEPA는 기존 VLM이 토큰 시퀀스를 자동회귀적으로 생성해야 하는 비효율성을 근본적으로 재구성한다. 핵심 아이디어는 시각 입력 X_V를 고차원 비전 트랜스포머(V‑JEPA2)로 압축해 시각 임베딩 S_V를 얻고, 텍스트 질의 X_Q를 토크나이즈·임베딩한 뒤, 이 두 임베딩을 Llama‑3.2 기반 Predictor에 동시에 입력한다. Predictor는 S_V와 X_Q를 결합해 목표 텍스트 임베딩 S_Y를 직접 예측한다. 여기서 손실은 InfoNCE 기반의 임베딩 정렬·균일성 항으로 정의되며, 토큰‑레벨 손실보다 목표 분포가 단일 모드에 가깝게 압축돼 학습이 용이해진다.

Y‑Encoder는 사전학습된 EmbeddingGemma‑300M을 사용해 텍스트 Y를 1 536‑차원 임베딩 S_Y로 매핑한다. 학습 단계에서는 Y‑Decoder를 사용하지 않으며, 추론 시에만 경량 디코더가 필요해 파라미터와 연산량을 크게 절감한다. 특히, 임베딩 예측은 비자동회귀적이므로 프레임이 들어올 때마다 한 번의 포워드 패스만 수행하면 연속적인 의미 스트림을 얻을 수 있다. 이 스트림에 대한 변동성을 모니터링해 사전 정의된 임계값을 초과할 때만 디코딩을 트리거하는 ‘선택적 디코딩’은 평균 2.85배 적은 디코딩 연산을 달성하면서 CIDEr 점수 손실을 최소화한다.

두 단계 학습 전략도 주목할 만하다. 1) 대규모 이미지·비디오 캡션 데이터(Datacomp, YFCC‑100M, Action100M)를 활용한 무질의 사전학습으로 시각‑언어 정렬을 확보하고, 2) PLM 혼합 데이터에서 질의‑조건화된 감독 파인튜닝(SFT)으로 VQA 능력을 부여한다. 사전학습 단계에서 2 B 샘플을 본 후 ImageNet 제로‑샷 정확도 61.6 %를 기록했으며, 이후 비디오 프레임 수를 늘려 4주간 24노드·8 × H200 GPU 클러스터에서 학습한다.

실험 결과, VL‑JEPA BASE는 8개 영상 분류와 8개 영상 검색 데이터셋에서 평균 정확도·Recall@1이 CLIP, SigLIP2, Perception Encoder를 모두 앞선다. SFT 모델은 GQA, TallyQA, POPE, POPEv2 네 VQA 벤치마크에서 InstructBLIP·QwenVL과 비슷한 성능을 보이며, 파라미터는 1.6 B에 불과해 효율성이 뛰어나다. 또한, 동일한 아키텍처가 오픈‑보카블리 분류, 텍스트‑투‑비디오 검색, 판별형 VQA 등 다양한 다운스트림 작업에 별도 구조 변경 없이 적용 가능함을 입증한다.

한계점으로는 Y‑Encoder와 Predictor가 동시에 학습되면서 임베딩 공간이 과도하게 압축될 위험이 있으며, 현재는 InfoNCE와 단순 정규화만 사용해 표현 붕괴 방지를 시도한다. 향후 비샘플 대비 정규화(VICReg, SIGReg)나 EMA 기반 Y‑Encoder 고정 등 보다 강력한 안정화 기법을 탐색할 필요가 있다. 또한, 선택적 디코딩 임계값 설정이 도메인에 따라 민감하게 작동할 수 있어 자동 튜닝 메커니즘이 요구된다.

전반적으로 VL‑JEPA는 “임베딩 예측 → 선택적 디코딩”이라는 새로운 패러다임을 제시함으로써, 대규모 멀티모달 모델의 학습·추론 비용을 크게 낮추고 실시간 영상 기반 응용에 적합한 효율성을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기