시각 패턴과 생성 모델을 연결하는 대규모 멀티도메인 데이터셋 SciTextures

초록

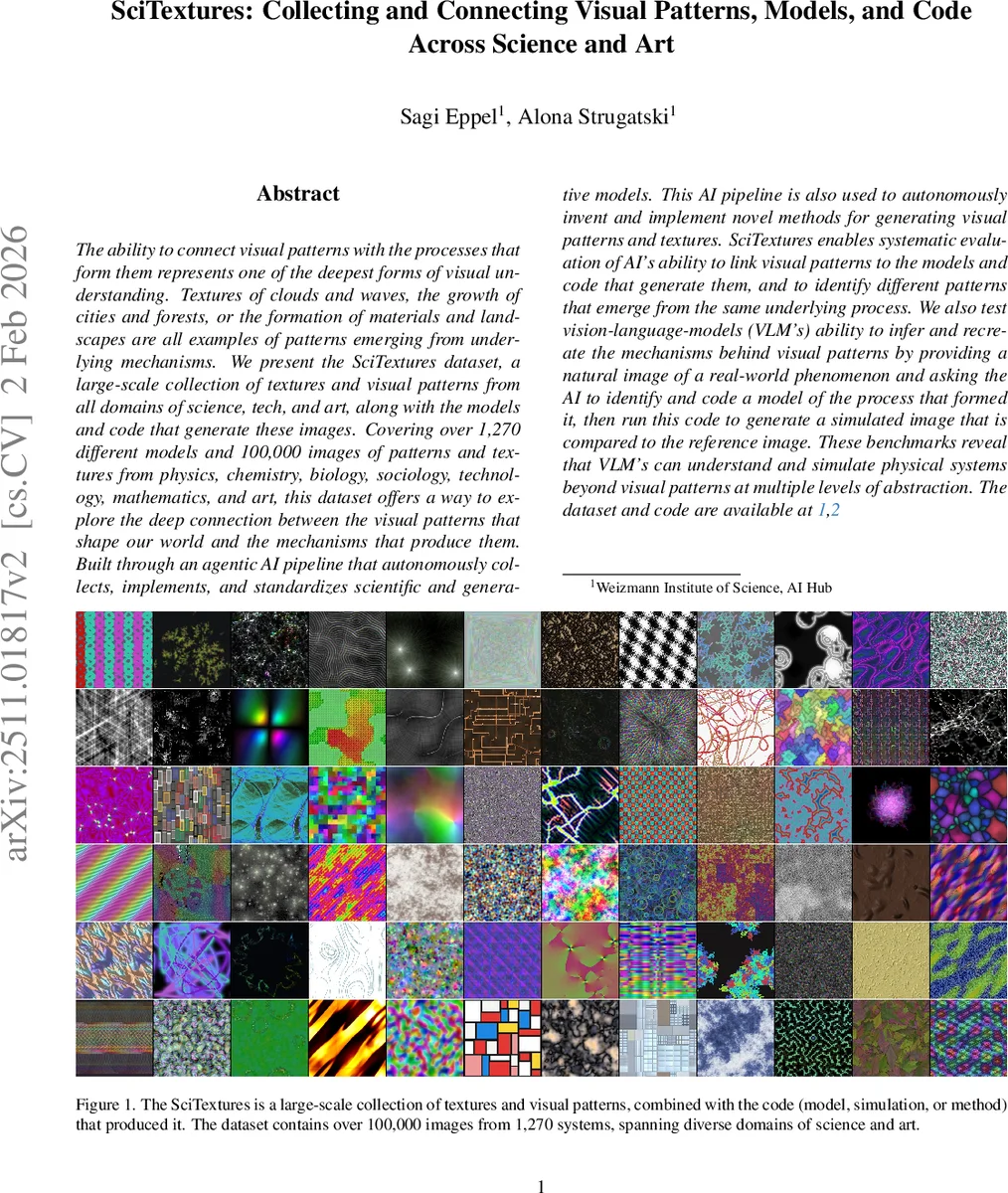

SciTextures는 물리·화학·생물·사회·예술 등 1,270개 이상의 과학·예술 모델과 100,000개 이상의 텍스처 이미지를 한데 모은 데이터셋이다. 자동화된 에이전트 AI 파이프라인을 통해 모델을 제안·코드 구현·디버깅·품질 검증까지 전 과정을 자율적으로 수행한다. 논문은 Im2Code, Im2Im, Im2Sim2Im이라는 세 가지 벤치마크를 제시해 비전‑언어 모델(VLM)이 이미지와 생성 코드·프로세스를 연결하고, 실제 현상에 대한 시뮬레이션을 재구성할 수 있는지를 평가한다. 실험 결과는 최신 VLM이 텍스처 수준을 넘어 물리·생물 과정까지 일정 수준 이해하고 재현할 수 있음을 보여준다.

상세 분석

SciTextures는 “시각 패턴 ↔ 생성 메커니즘”이라는 근본적인 연결 고리를 데이터 수준에서 구현한 최초의 대규모 멀티도메인 리소스이다. 1,270개의 모델은 이징 모델, 게임 오브 라이프, 도시 성장 시뮬레이션, 화학 반응, 결정 성장 등 다양한 과학·공학 현상을 포함하며, 각각 파이썬/쉐이더 형태의 표준화된 코드와 80장의 시드 이미지(색상·타일링 가능)를 제공한다. 데이터 수집은 GPT‑5 기반 에이전트가 “모델 제안 → 코드 구현 → 자동 디버깅 → 이미지 생성 → 품질 검증”의 6단계를 순환하도록 설계돼 인간 개입을 최소화한다. 특히 모델 제안 단계에서 기존 논문·오픈소스·자연 이미지에서 영감을 얻은 새로운 생성 아이디어까지 자동으로 도출한다는 점이 혁신적이다.

데이터셋 품질 평가는 Claude 4.5와 DeepSeek R1이 5단계의 충실도(Accurate 4 %, Good Approx 42 %, Toy 40 %, Weak 1 %, Inspired 13 %)로 라벨링한 결과, 대부분이 정량적 정확성보다는 질적 현상 재현에 초점을 맞춘 ‘Toy’ 수준임을 확인한다. 이는 텍스처 생성이 시각적 매력과 다양성을 우선시하면서도, 물리적 정확성을 완전 재현하기엔 제한이 있음을 의미한다.

벤치마크는 세 가지 핵심 과업으로 구성된다. Im2Code는 주어진 코드와 이미지 집합 사이의 매칭 정확도를 측정해 VLM이 코드‑이미지 연관성을 얼마나 파악하는지 평가한다. Im2Im은 동일 모델이 생성한 이미지와 다른 모델이 만든 이미지 사이를 구분하도록 요구해, 모델‑레벨 패턴 인식 능력을 테스트한다. 가장 도전적인 Im2Sim2Im은 실제 현상 사진을 입력으로 받아, 해당 현상의 물리·생물 메커니즘을 추론·코드화하고 시뮬레이션 이미지를 생성한 뒤, 생성 이미지와 원본을 매칭한다. 이 과정에서 GPT‑5는 44 %의 매칭 정확도를 보였으며, 인간 평가자는 82 %에 달했다. 다른 VLM(Gemini‑2.5‑flash, Qwen2.5‑VL‑72B 등)은 30 % 이하로 크게 뒤처졌다.

실험 결과는 현재 최고 성능 VLM조차도 복잡한 물리·생물 현상을 완전 재현하기엔 한계가 있음을 시사한다. 특히 코드 주석이 없는 ‘Clean’ 버전에서 성능이 급격히 떨어지는 점은 모델이 텍스트 설명보다 실제 코드 구조를 이해하는 데 어려움을 겪는다는 점을 보여준다. 또한 색상·그레이스케일 구분, 인간·AI 매칭 방식 차이 등 다양한 변수에 따라 성능 편차가 크다.

이 논문은 데이터셋 자체와 자동화 파이프라인, 그리고 새로운 평가 프레임워크를 동시에 제시함으로써, 시각 인식 연구가 “패턴 인식”을 넘어 “메커니즘 추론·시뮬레이션” 단계로 확장될 수 있는 기반을 마련한다. 향후 연구는 모델 충실도 향상, 더 정교한 물리·수학 시뮬레이션 통합, 그리고 멀티모달 추론 능력 강화에 초점을 맞출 필요가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기