블랙박스 LLM을 조종하는 새로운 방법 어드바이저 모델

초록

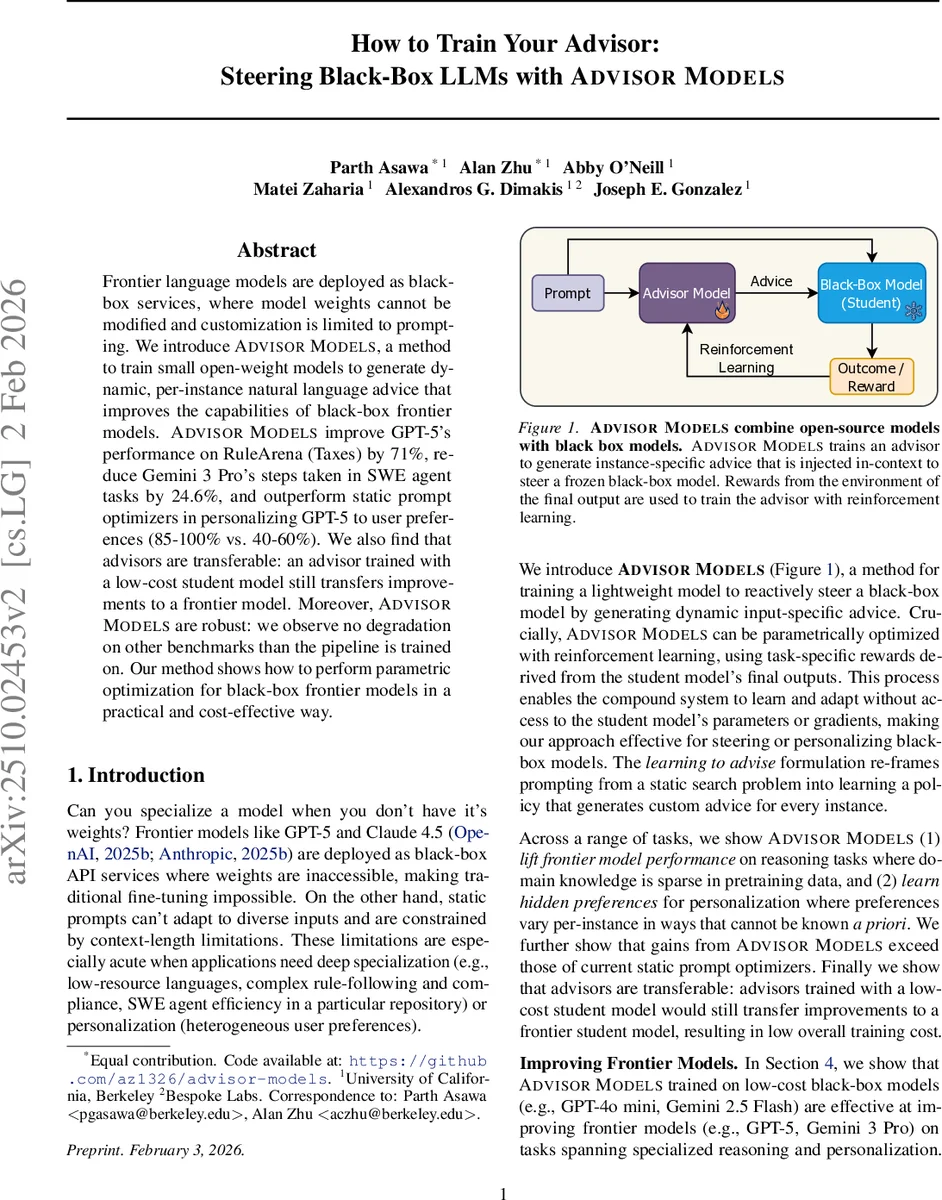

본 논문은 가벼운 오픈‑weight 어드바이저 모델을 훈련시켜, 정적 프롬프트가 아닌 인스턴스별 자연어 조언을 생성함으로써 GPT‑5·Gemini 3 Pro와 같은 블랙박스 대형 언어 모델을 동적으로 스티어링한다. 강화학습 기반 보상으로 어드바이저를 최적화하고, 저비용 학생 모델에서 학습한 어드바이저를 고성능 모델에 전이함으로써 비용 효율성과 전이 가능성을 입증한다. 실험 결과는 세 가지 도메인(세금 규칙, SWE 에이전트 효율성, 저자원 번역)에서 기존 정적 프롬프트 최적화보다 크게 향상된 성능을 보여준다.

상세 분석

이 연구는 “어드바이저 모델(Advisor Models)”이라는 새로운 패러다임을 제시한다. 핵심 아이디어는 작은 오픈‑weight 모델을 정책 네트워크처럼 활용해, 사용자 입력과 블랙박스 LLM 사이에 인스턴스‑특정 자연어 조언을 삽입하는 것이다. 기존의 정적 프롬프트 최적화는 전체 데이터셋에 대해 하나의 고정된 프롬프트를 찾는 데 그쳤지만, 어드바이저는 매 입력마다 다른 조언을 생성함으로써 컨텍스트 길이 제한을 극복하고, 복잡한 멀티턴 작업에서도 동적으로 행동을 조정한다.

학습 과정은 강화학습(RL) 기반이다. 어드바이저는 현재 입력과(선택적으로) 학생 모델의 초기 출력(3‑step 변형) 등을 관찰하고 조언을 생성한다. 생성된 조언은 블랙박스 모델에 전달되고, 최종 출력에 대해 도메인‑특화 보상(정답 여부, 효율성, chrF 등)이 계산된다. 보상은 Group Relative Policy Optimization(GRPO)으로 어드바이저의 파라미터를 업데이트한다. 중요한 점은 블랙박스 모델의 가중치나 그래디언트에 접근할 필요가 없으며, API 호출만으로 학습이 가능하다는 점이다.

전이 가능성은 두 단계에서 검증된다. 첫째, 저비용 학생 모델(GPT‑4o mini, Gemini 2.5 Flash)로 어드바이저를 학습한 뒤, 동일한 어드바이저를 고성능 모델(GPT‑5, Gemini 3 Pro)에 그대로 적용한다. 실험 결과, 전이 후에도 20‑30% 수준의 성능 향상이 유지된다. 둘째, 모델 패밀리 간 전이도 가능함을 보여준다(예: GPT‑계열에서 Claude‑계열로). 이는 어드바이저가 “자연어 조언”이라는 형식 자체에 의존하기 때문에 가능한 것으로 해석된다.

안정성 측면에서는, 어드바이저가 블랙박스 모델을 직접 수정하지 않으므로 기존 모델이 학습되지 않은 다른 벤치마크에 대한 성능 저하가 관찰되지 않았다. 또한 3‑step 변형을 도입해 어드바이저가 초기 학생 출력에 기반해 검증자 역할을 수행하도록 함으로써 위험한 조언(예: 허위 정보, 편향) 발생 가능성을 감소시켰다.

실험은 세 가지 도메인에서 수행되었다. RuleArena Taxes에서는 GPT‑5의 정확도가 31.2%→53.6%(+71%)로 상승했고, SWE Agent Efficiency에서는 평균 스텝 수가 31.7→26.3(‑24.6%)로 감소하면서 해결율은 유지되었다. 저자원 언어인 Kalamang 번역에서는 chrF 점수가 0.32→0.48으로 개선되었다. 모든 경우에서 최신 정적 프롬프트 최적화기(GEP‑A, Profile‑Augmented Generation)보다 월등히 높은 성능을 기록했다.

한계점으로는 어드바이저 자체의 파라미터 규모가 여전히 수억 수준이므로, 초저비용 환경에서는 추가적인 경량화가 필요할 수 있다. 또한 보상 설계가 도메인에 따라 크게 달라지므로, 일반화 가능한 보상 함수 개발이 향후 과제로 남는다. 그럼에도 불구하고, 어드바이저 모델은 블랙박스 LLM을 “프롬프트 수준”이 아닌 “정책 수준”에서 최적화할 수 있는 실용적인 수단을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기