게임 타임: 음성 모델의 시간 역학 평가

초록

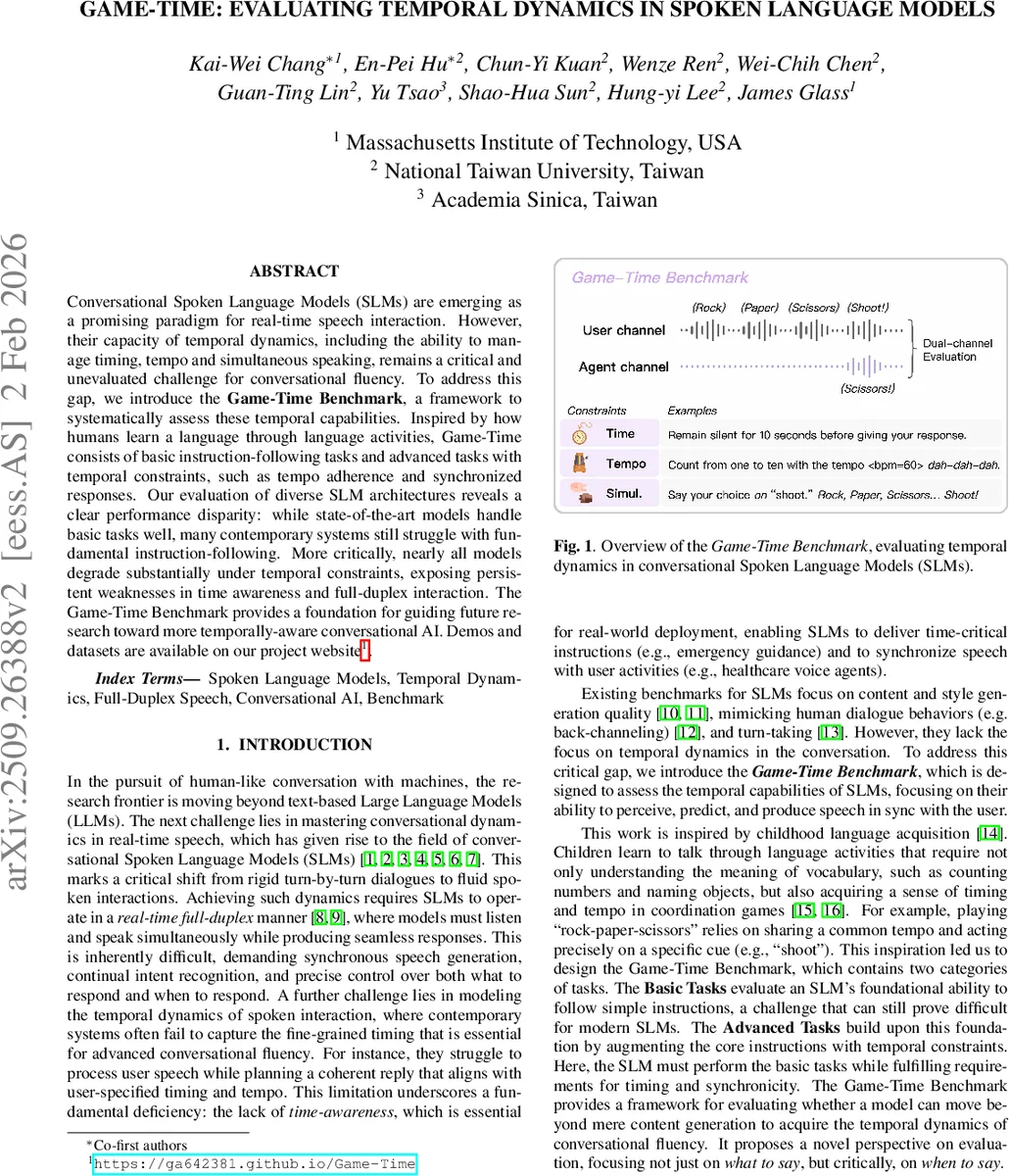

본 논문은 실시간 대화 음성 모델(SLM)의 시간 인식·템포·동시 발화 능력을 체계적으로 측정하기 위해 Game‑Time 벤치마크를 제안한다. 기본 지시 수행 과제와 시간·템포 제약이 추가된 고급 과제로 구성된 12개 서브태스크를 통해 최신 SLM들의 성능 격차를 드러내며, 특히 전이‑멀티플렉싱 방식보다 듀얼‑채널 방식이 전반적으로 우수함을 확인한다.

상세 분석

Game‑Time 벤치마크는 인간의 언어 습득 과정을 모방해 “기본 Tasks”(Sequence, Repeat, Compose, Recall, Open‑Ended, Role‑Play)와 이들에 시간·템포 제약을 결합한 “고급 Tasks”(Time‑Fast, Time‑Slow, Time‑Silence, Tempo‑Interval, Tempo‑Adhere, Simul‑Shadow, Simul‑Cue)로 구분한다. 각 과제는 Instruction‑Following(If) 프레임워크에 기반해 베이스 태스크 t와 제약 집합 C를 명시적으로 정의한다. 데이터셋 구축 파이프라인은 (1) 전문가가 만든 시드 명령, (2) LLM을 활용한 문장 다양화, (3) 다중 음성 TTS 합성, (4) ASR 기반 품질 검증의 4단계로 이루어져 1,475개의 테스트 인스턴스를 생성한다.

평가 방법은 듀얼‑채널 녹음(사용자·모델)에서 Whisper‑medium으로 얻은 시간 정렬 텍스트를 LLM‑as‑judge(Gemini 2.5 Pro)에게 제공해 지시 수행 정확도와 시간 제약 충족 여부를 채점한다. 인간 평가와의 상관관계를 사전 실험으로 검증했으며, 규칙 기반 메트릭보다 해석적 유연성을 확보한다는 장점이 있다.

실험에서는 Freeze‑Omni, Unmute(시간‑멀티플렉싱), Moshi(듀얼‑채널), Gemini‑Live, GPT‑realtime 등 5개 모델과 비공식 “SSML‑LLM” 오라클을 비교했다. 기본 과제에서는 GPT‑realtime가 전반적으로 높은 점수를 얻었고, Freeze‑Omni·Unmute가 Moshi보다 우수했다. 이는 사전 훈련된 LLM을 스트리밍 인코더·디코더와 결합한 구조가 음성 신호를 직접 fine‑tuning한 듀얼‑채널보다 안정적임을 시사한다. 고급 과제에서는 모든 모델이 성능 급락을 보였으며, 특히 Time‑Silence와 Simul‑Cue(동시 발화)에서 거의 0점에 가까운 결과를 기록했다. 이는 현재 SLM이 “언제 말할지”보다 “무엇을 말할지”에 집중하고 있음을 명확히 드러낸다.

한계점으로는 (1) 평가용 LLM‑judge 자체가 시간 정밀도에 한계가 있을 수 있음, (2) 실제 실시간 인터랙션을 완전 재현하지 못한 오프라인 시뮬레이션, (3) TTS·ASR 품질에 의존하는 데이터 생성 과정이 오류 전파 위험을 내포한다는 점을 언급한다. 향후 연구는 (i) 실시간 스트리밍 평가 프로토콜, (ii) 멀티모달(시각·촉각) 신호와의 통합, (iii) 전이‑멀티플렉싱과 듀얼‑채널의 하이브리드 아키텍처 개발을 제안한다.

댓글 및 학술 토론

Loading comments...

의견 남기기