공정한 GPTQ: 대형 언어 모델을 위한 편향 인식 양자화

초록

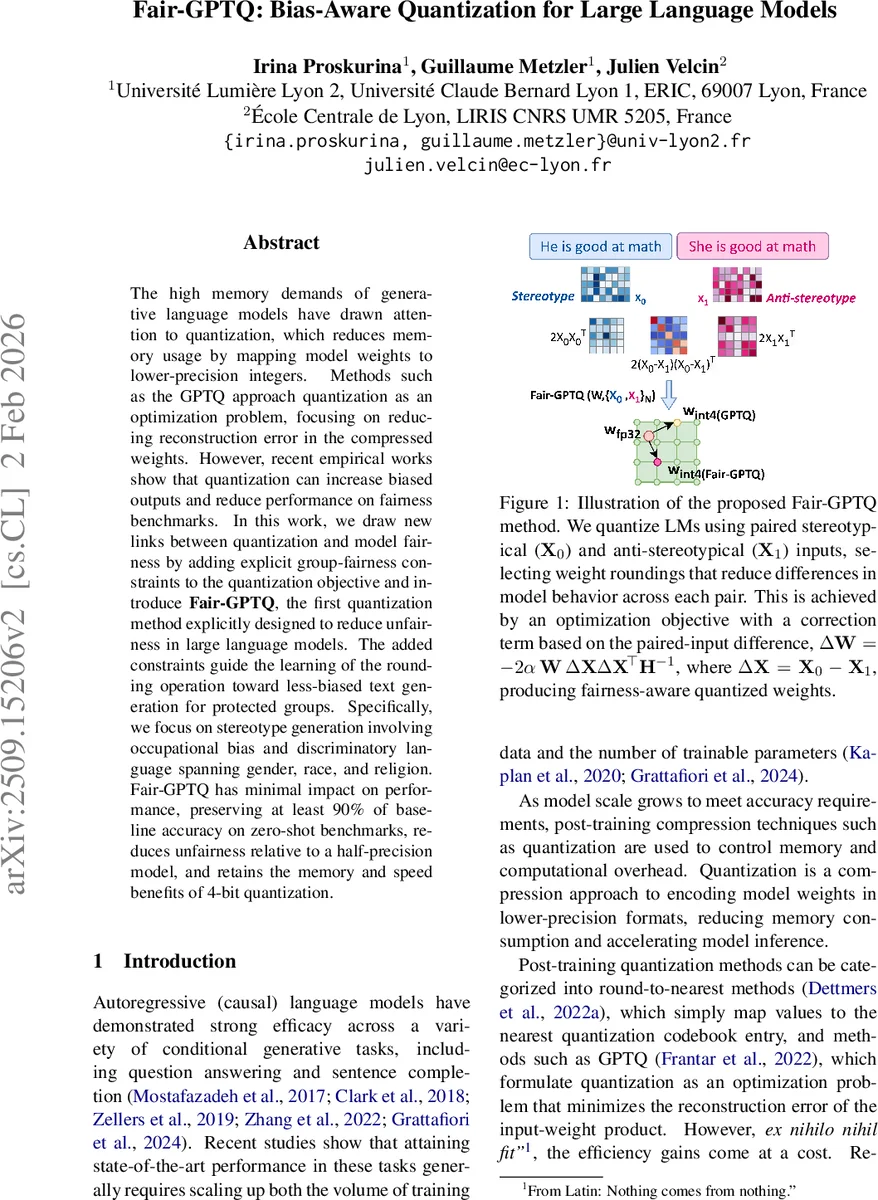

본 논문은 기존 GPTQ 양자화가 모델의 편향을 악화시킬 수 있다는 문제를 인식하고, 그룹‑공정성 제약을 정량화 목표에 추가한 Fair‑GPTQ를 제안한다. 4‑bit 양자화에서도 정확도 90 % 이상을 유지하면서 성별·인종·종교에 대한 고정관념 생성을 크게 감소시킨다. 또한, 양자화 단계에서 편향 원인을 분석할 수 있는 도구도 제공한다.

상세 분석

Fair‑GPTQ는 기존 GPTQ가 최소화하던 입력‑가중치 재구성 오차에, 보호 속성(성별, 인종, 종교 등)별로 쌍을 이룬 입력 X₀(편향된 문장)과 X₁(반편향 문장) 사이의 출력 차이를 최소화하는 정규화 항을 추가한다. 수식적으로는

�nbsp;

댓글 및 학술 토론

Loading comments...

의견 남기기