마이버트: 마이틸리 저자원 언어를 위한 사전학습 코퍼스와 언어 모델

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

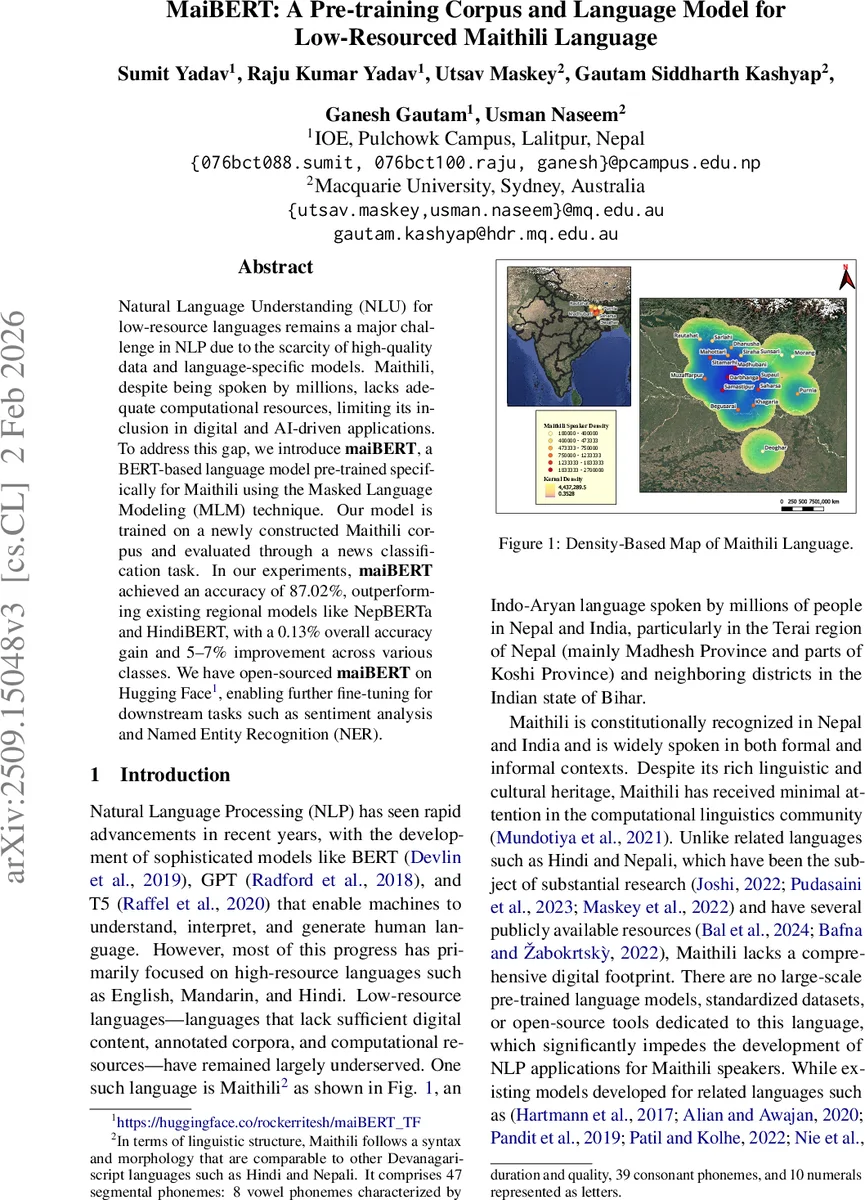

마이버트는 마이틸리어 전용으로 구축한 18백만 단어 규모의 코퍼스를 기반으로 BERT 아키텍처를 MLM 방식으로 사전학습한 모델이다. 뉴스 분류 실험에서 87.02%의 정확도를 달성했으며, 기존 NepBERTa·HindiBERT 대비 전체 정확도 0.13%·클래스별 5~7% 향상을 보였다. 모델과 코퍼스는 Hugging Face에 공개돼 감성 분석·NER 등 다양한 다운스트림 작업에 활용 가능하다.

상세 분석

본 논문은 저자원 언어인 마이틸리어에 대한 실질적인 NLP 인프라 구축을 목표로 두고 있다. 첫 번째 기여는 위키피디아, OCR 처리된 전자책, 현지 신문 등 세 가지 출처를 통합해 1,028,017개의 문장, 약 18백만 단어, 450 MB 규모의 고품질 코퍼스를 만든 점이다. 특히 Devanagari 스크립트에 특화된 토크나이저와 30,000개의 서브워드 vocab을 사용해 형태소 변형과 희귀 어휘를 효과적으로 커버한다.

모델 설계는 기존 BERT(Devlin et al., 2019)를 그대로 채택했으며, 입력 시퀀스 길이는 512 토큰, 마스크 비율은 15%(80%

댓글 및 학술 토론

Loading comments...

의견 남기기