지역 지식 기반 오픈형 질문응답 데이터셋 CUSQA

초록

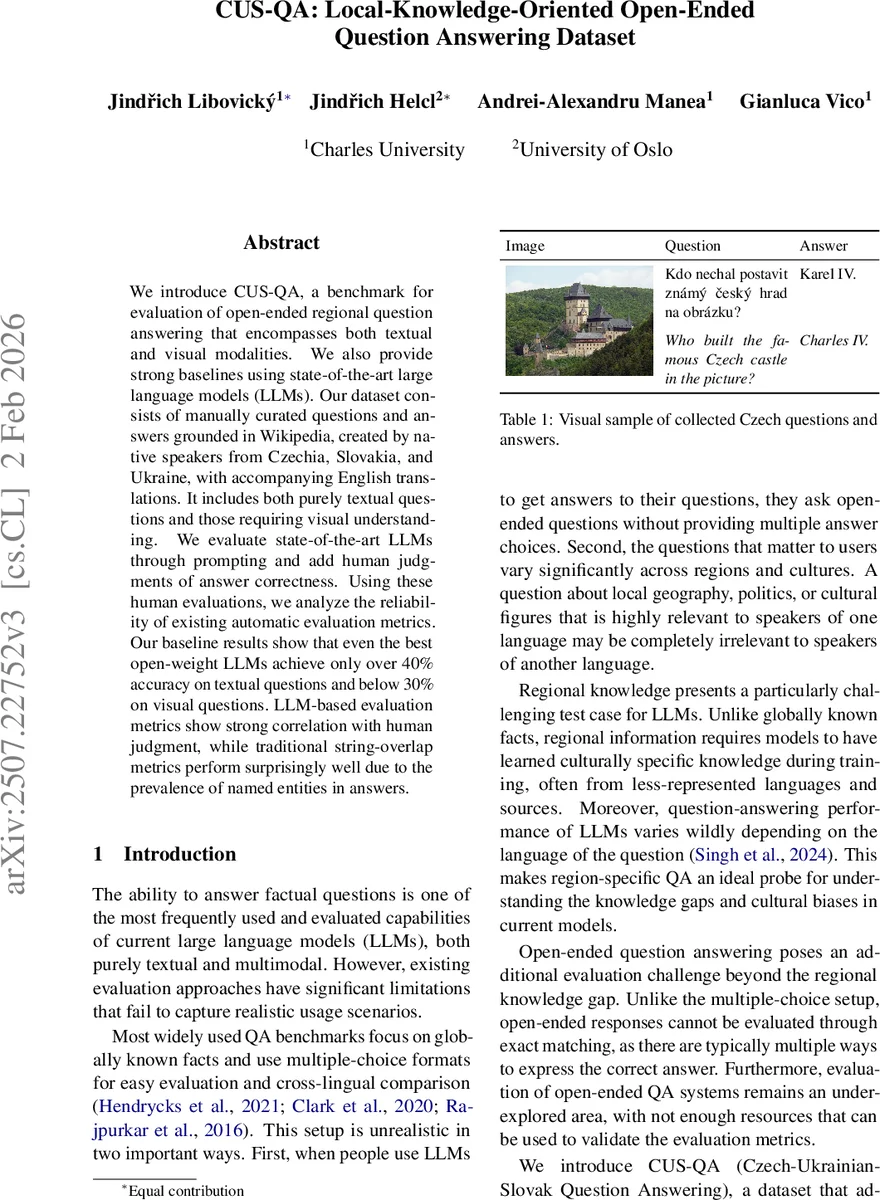

CUS‑QA는 체코, 슬로바키아, 우크라이나의 지역 지식을 다루는 텍스트·이미지 혼합 오픈형 QA 벤치마크이다. 원어 질문·답변과 영문 번역을 포함하고, 인간 평가와 자동 메트릭 상관관계를 분석한다. 최신 오픈‑weight LLM은 텍스트 질문에서 40 % 이하, 이미지 질문에서는 30 % 이하의 정확도만 보이며, 문자열 일치 메트릭이 명명 엔터티 중심 답변에서 의외로 높은 상관성을 보인다.

상세 분석

본 논문은 지역 특화 지식이 현재 대형 언어 모델(LLM)의 약점임을 실증적으로 보여준다. 데이터 수집 단계에서는 체코어, 슬로바키아어, 우크라이나어 원어 화자를 모집해 위키피디아 페이지를 무작위로 제시하고, “지역 주민이 1만 명 이상 알 정도의 사실”이라는 기준으로 질문·답변을 작성하도록 했다. 이 과정에서 22 %의 질문이 품질 기준에 미달해 제외됐으며, 남은 1 536·1 210·1 158개의 텍스트·이미지 샘플이 각각 체코, 슬로바키아, 우크라이나에 대해 균형 있게 배치되었다.

텍스트와 이미지 질문 모두 평균 질문 길이는 약 60 자, 답변은 평균 20~30 자로 짧은 명사구가 주를 이룬다. 명명 엔터티 분석 결과, 위치(도시·마을)와 인물(특히 정치인) 비중이 높으며, 이미지 샘플은 인물 초상, 건축물, 자연 풍경 등 7가지 카테고리로 분류돼 시각적 이해 능력도 평가한다.

평가에서는 LLaMA 3.3 70B, Mistral v0.3, EuroLLM 등 최신 오픈‑weight 모델을 제로샷 프롬프트(영문 시스템 프롬프트 + 현지 언어 답변 지시)로 테스트했다. 텍스트 질문에서 최고 모델조차 40 % 미만의 정확도를 기록했으며, 이미지 질문에서는 30 % 이하에 머물렀다. 특히 영어로 질문했을 때보다 현지 언어로 질문했을 때 성능이 떨어지는 현상이 관찰돼, 다국어 학습 데이터의 불균형과 문화적 편향을 시사한다.

자동 평가 메트릭으로는 BLEU, ROUGE, BERTScore 등 문자열·시맨틱 기반 지표와 LLM 기반 평가(예: GPT‑4o, Claude 3.5) 두 축을 비교했다. 인간 평가는 정답·진실성·관련성·일관성 네 가지 이진 기준으로 이루어졌으며, 두 명 평가자의 완전 일치가 기준이 되었다. 결과적으로 LLM 기반 메트릭은 인간 판단과 높은 피어슨 상관(r > 0.8)을 보였고, 전통적인 문자열 겹침 지표도 명명 엔터티 중심 답변에서 예상외로 높은 상관성을 나타냈다. 이는 답변이 짧고 고유명사가 주를 이루는 특성 때문이며, 향후 평가 설계 시 답변 다양성을 반영한 새로운 메트릭이 필요함을 암시한다.

또한 교차언어 실험에서 동일 질문을 다른 두 현지 언어로 번역해 모델에 입력했을 때 일관성이 크게 떨어지는 것을 확인했다. 이는 현재 다국어 LLM이 언어 간 지식 전이에서 한계가 있음을 보여준다.

전체적으로 CUS‑QA는 지역 지식과 시각 정보를 동시에 요구하는 실제 사용 시나리오를 재현함으로써, 기존 다중선택형·전역 지식 중심 QA 벤치마크의 한계를 보완한다. 데이터셋 자체는 학습용이 아니라 평가용으로 설계돼 모델의 지역 문화 이해도와 멀티모달 추론 능력을 정밀히 측정할 수 있다. 향후 연구는 (1) 더 다양한 슬라브·비슬라브 언어 확장, (2) 이미지·텍스트 복합 프롬프트 설계, (3) 인간 평가 기반 메트릭 개발을 통해 지역 특화 QA 성능을 체계적으로 향상시키는 방향으로 진행될 전망이다.

댓글 및 학술 토론

Loading comments...

의견 남기기