RePPL 의미 전파와 생성 불확실성을 재보정한 설명 가능한 QA 환각 탐지

초록

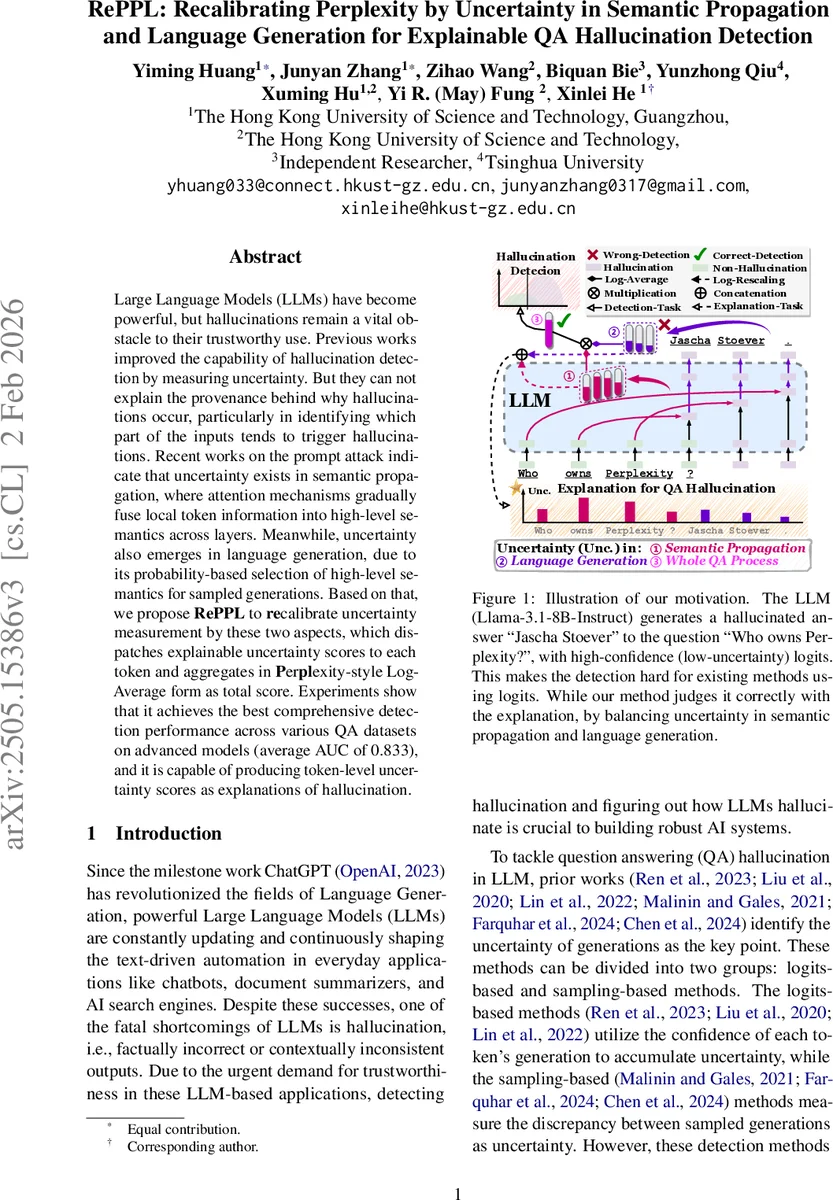

본 논문은 대형 언어 모델(LLM)의 답변에서 발생하는 환각을 탐지하기 위해, 의미 전파 단계와 언어 생성 단계에서 발생하는 두 종류의 불확실성을 정량화하고 이를 Perplexity 형태로 재조합한 RePPL 점수를 제안한다. 토큰 수준의 불확실성 점수를 제공함으로써 환각 원인을 설명 가능하게 만든다. 실험 결과, 다양한 QA 데이터셋과 최신 모델에서 평균 AUC 0.833이라는 최고 성능을 달성하였다.

상세 분석

RePPL은 기존의 로그우도 기반 Perplexity와 샘플링 기반 불확실성 측정 방식을 넘어, 의미 전파(semantic propagation)와 언어 생성(language generation) 두 단계에서 발생하는 불확실성을 별도로 추정하고 이를 곱셈 형태로 결합한다는 점에서 혁신적이다. 의미 전파 불확실성은 모델의 어텐션 흐름을 이용해 입력 토큰이 출력 토큰에 어떻게 기여하는지를 추적한다. 구체적으로, 각 샘플링된 생성에 대해 레이어‑별 어텐션 행렬을 풀링(MaxPool, AvgPool, Rollout)하여 토큰‑토큰 기여 행렬 R을 얻고, 입력 토큰에 해당하는 열을 추출한 뒤 평균을 구한다. 이 평균 벡터에 대해 채널(샘플) 간 변동계수(CV)를 계산하고, 역함수 1/(1+r^α) 로 변환해 의사‑확률 p̂ 를 만든다. 이후 p̂ 에 로그를 취하고 토큰 수로 평균해 InnerPPL을 산출한다.

언어 생성 불확실성은 기존 Perplexity와 유사하게 토큰별 로그 확률을 사용하지만, 분모를 샘플링된 평균 길이 ¯S 로 정규화한다. 이는 모델이 확신이 있을 때 greedy 디코딩 길이가 짧아지는 현상을 보정해, 불확실한 경우에만 높은 OuterPPL 값을 부여한다.

두 점수를 곱하고 작은 편향 ε 를 더해 최종 RePPL = −(InnerPPL+ε)×OuterPPL 로 정의한다. 곱셈 구조는 하나의 단계에서 높은 불확실성이 다른 단계에서 낮은 불확실성으로 상쇄되는 상황을 방지하고, 각각의 불확실성이 독립적으로 기여하도록 만든다.

실험에서는 Llama‑3.1‑8B‑Instruct, Qwen2.5‑7B‑Instruct, Qwen2.5‑14B‑Instruct 세 모델을 대상으로 TriviaQA, Natural Questions, CoQA, SQuAD‑v2.0 네 개의 QA 데이터셋에서 평가하였다. 샘플링 횟수 N=10, 온도 1.0, top‑k 50, top‑p 0.99 등 기존 연구와 동일한 설정을 사용했으며, 비교 대상으로는 로그우도 기반 Perplexity, Verbalize, Semantic Entropy, EigenScore 등 최신 로그‑기반·샘플링‑기반 방법을 포함한다. RePPL은 평균 AUC 0.833으로 모든 베이스라인을 앞섰으며, 특히 입력 프롬프트가 환각을 유발하는 경우 토큰‑레벨 불확실성 맵을 통해 어느 입력 토큰이 문제를 일으켰는지 시각적으로 설명한다.

또한, 하이퍼파라미터 α와 ε 에 대한 민감도 분석에서 RePPL은 비교적 안정적인 성능을 보였고, 어텐션 풀링 방식(MaxPool, AvgPool, Rollout) 선택에 따라 약간의 차이는 있지만 전반적인 추세는 유지되었다. 이와 같이 RePPL은 LLM의 내부 어텐션 흐름과 출력 확률을 동시에 활용함으로써, 기존 방법이 놓치기 쉬운 “왜”와 “어디서” 환각이 발생했는지를 정량화하고 시각화한다는 점에서 설명 가능 AI 분야에 중요한 기여를 한다.

댓글 및 학술 토론

Loading comments...

의견 남기기