스피커 검증을 위한 합성 클래스 증강·대립적 믹스업 정규화

초록

CAARMA는 임베딩 공간에서 믹스업을 수행해 가상의 스피커 클래스를 생성하고, 대립적 디스크리미네이터로 합성 임베딩을 실제와 구분되지 않게 정제한다. 이를 통해 훈련 시 클래스 수를 인위적으로 확대해 제로샷 스피커 검증 성능을 평균 8 % 향상시킨다.

상세 분석

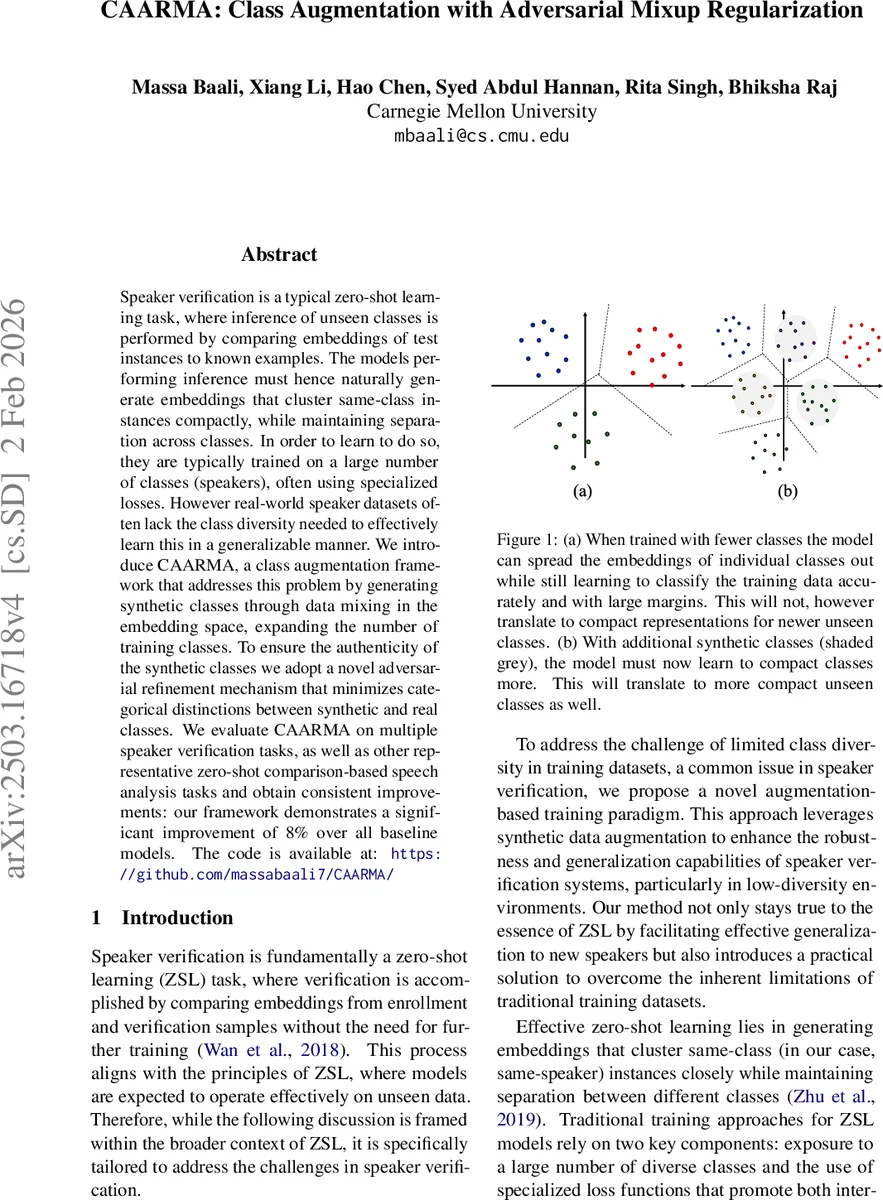

본 논문은 제로샷 학습(zero‑shot learning)에서 핵심적인 두 가지 요구사항, 즉 같은 클래스(스피커) 내부의 임베딩을 촘촘히 군집시키고 서로 다른 클래스 간에는 충분히 분리시키는 문제를 다룬다. 기존 방법들은 대규모 클래스 수와 특수 손실(예: AM‑Softmax, Triplet 등)에 의존해 이러한 특성을 학습했지만, 실제 스피커 데이터는 클래스 다양성이 부족해 일반화에 한계가 있었다. CAARMA는 이러한 한계를 극복하기 위해 ‘Synthetic Label Mixup(SL‑Mixup)’이라는 새로운 클래스 증강 기법을 제안한다. 핵심 아이디어는 원본 음성의 멜‑스펙트로그램을 인코더(E)로 변환한 뒤, 얻어진 임베딩 공간에서 두 임베딩을 0.5:0.5 비율로 선형 혼합한다는 점이다. 입력 신호를 직접 믹스업하면 두 스피커의 목소리가 겹쳐 의미 없는 신호가 되지만, 임베딩 공간에서는 클러스터 형태가 유지되므로 새로운 가상의 클래스 라벨을 부여할 수 있다.

하지만 임베딩을 무작위로 섞는 것만으로는 실제 스피커와 구별 가능한 ‘가짜’ 클러스터가 생성될 위험이 있다. 이를 방지하기 위해 논문은 사전 학습된 SSL 모델을 디스크리미네이터(D)로 활용한다. D는 실제 임베딩(R)과 합성 임베딩(S)을 구분하도록 학습하고, 인코더는 역으로 D를 속이는 ‘생성자 손실(L_gen)’을 최소화한다. 즉, 대립적 학습을 통해 합성 임베딩이 통계적으로 실제와 동일한 분포를 갖도록 정제한다.

훈련 과정에서는 기존 AM‑Softmax 손실(L_real)과 합성 임베딩에 대한 동일 손실(L_syn)을 동시에 최적화한다. L_syn은 L_real에 λ(클래스 수)로 정규화된 형태로 가중치가 부여되어, 합성 클래스가 전체 손실에 과도하게 영향을 주지 않도록 설계되었다. 학습이 끝나면 디스크리미네이터는 폐기되고, 인코더만 남아 테스트 단계에서 임베딩을 추출한다.

실험에서는 VoxCeleb1/2 등 공개 스피커 데이터와 다양한 제로샷 기반 음성 분석 태스크에 CAARMA를 적용했으며, 모든 베이스라인 대비 평균 8 % 이상의 EER 감소를 기록했다. 특히 클래스 수가 제한된 소규모 데이터셋에서 증강 효과가 두드러졌으며, 다른 제로샷 음성 작업(예: 화자 감정 인식)에서도 성능 향상이 확인되었다.

이 논문의 주요 공헌은 (1) 임베딩 공간에서의 믹스업을 통한 새로운 클래스 생성 메커니즘, (2) 대립적 정규화를 통한 합성 임베딩의 진위 보장, (3) 제로샷 스피커 검증 및 기타 음성 비교 기반 태스크에서 실질적인 성능 향상을 입증한 점이다. 향후 연구에서는 더 복잡한 혼합 전략(예: 비선형 혼합, 다중 샘플 믹스)이나 디스크리미네이터를 다중 스케일 특징에 적용하는 방안이 제시될 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기