일본 금융 언어 이해를 위한 Ebisu 벤치마크: 암시적 약속 인식과 용어 추출 평가

초록

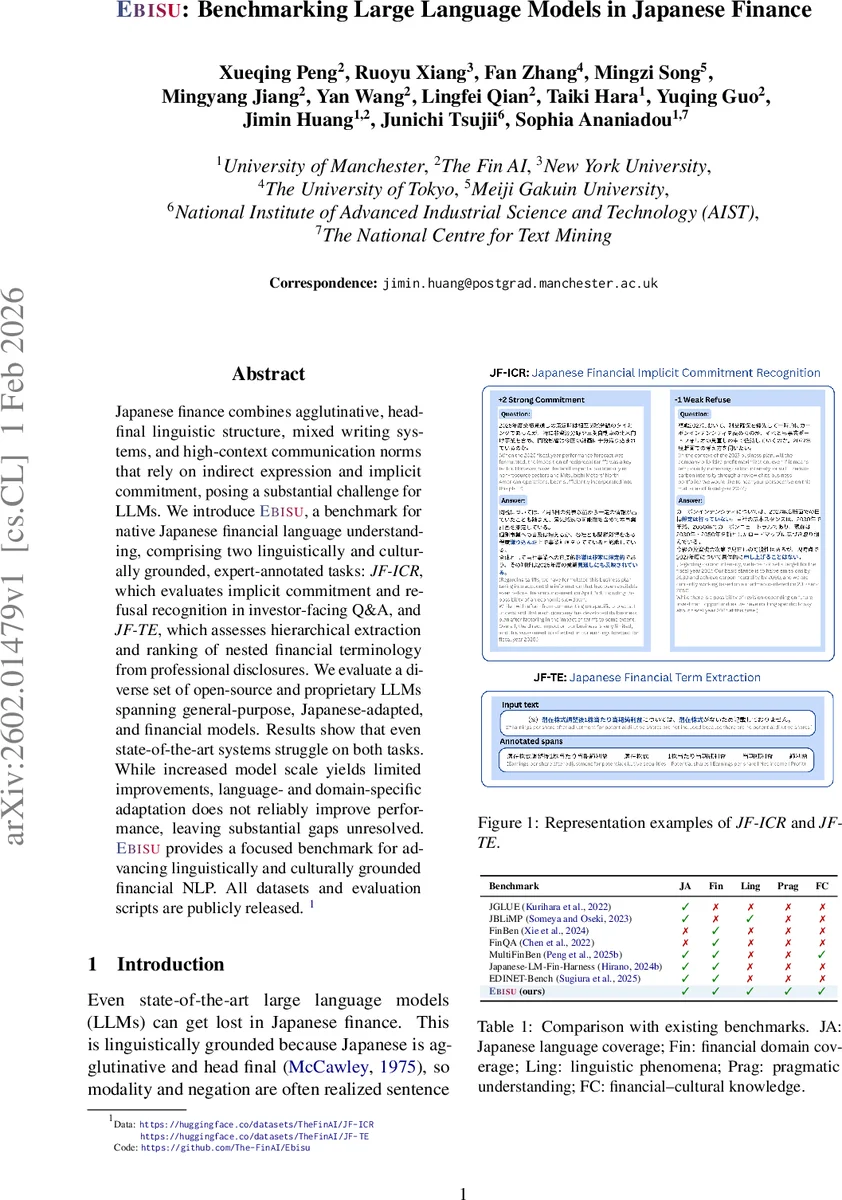

Ebisu는 일본 금융 분야의 고유 언어·문화적 특성을 반영한 두 과제(JF‑ICR, JF‑TE)를 제공한다. JF‑ICR은 투자자 Q&A에서 암시적 약속·거절을 5단계로 분류하고, JF‑TE는 공시 문서에서 중첩된 금융 용어를 계층적으로 추출·순위 매긴다. 22개의 오픈·프로프라이어터리 LLM을 평가했지만, 규모 확대와 일본어·도메인 특화 사전학습에도 불구하고 전반적인 성능은 낮았다. 오류는 주로 문법·프라그마틱 현상에 기인하며, 현재 모델이 일본 금융 커뮤니케이션의 미묘한 뉘앙스를 포착하지 못함을 보여준다.

상세 분석

Ebisu 벤치마크는 일본어 고유의 교착어·후위어 구조, 혼합 문자 체계(한자·히라가나·카타카나), 그리고 고맥락·간접 표현이라는 세 가지 언어·문화적 난점을 동시에 다룬다. 첫 번째 과제인 JF‑ICR은 94개의 투자자‑기업 Q&A를 5가지 암시적 스탠스(강한·약한 약속, 중립·헷징, 약한·강한 거절)로 라벨링했으며, 라벨링 일관성을 Macro‑F1 0.92, κ 0.88, α 0.88로 높은 수준으로 확보했다. 두 번째 과제 JF‑TE는 202개의 공시 문서에서 2,412개의 용어를 추출·정규화했으며, 중첩 명사구와 스크립트 변형(예: 가타카나 차용어)의 경계 인식이 핵심 난제다. 평가 지표는 정확도와 F1, HitRate@1/5/10을 사용해 용어 탐색 순위 품질을 측정한다.

22개의 LLM(일반형, 일본어 특화, 금융 특화 모델 포함)을 실험한 결과, 모델 규모가 커질수록 JF‑ICR 정확도가 평균 +0.33, JF‑TE F1이 +0.38 상승했지만 절대 성능은 30% 이하에 머물렀다. 특히 일본어 사전학습 모델이 동일 규모의 영어 기반 모델보다 일관되게 우수하지 않았으며, 금융 도메인 추가 사전학습은 JF‑TE에서 F1이 -0.12 감소하는 역효과를 보였다. 오류 분석은 문장 말미의 조동사·부정 표현, 복합 부정·헷징, 그리고 깊은 명사구·스크립트 변형 처리에서 집중되었으며, 단순 금융 지식 부족보다는 형태론·프라그마틱 파악 능력의 한계가 원인임을 시사한다.

이러한 결과는 현재 LLM이 일본 금융 텍스트의 미묘한 의도와 용어 경계를 정확히 파악하기 위해서는 규모 확대만으로는 부족하고, 언어·도메인 특화 학습 전략도 재설계가 필요함을 강조한다. Ebisu는 이러한 연구 공백을 메우기 위한 고품질 데이터와 평가 파이프라인을 제공함으로써, 일본어 금융 NLP의 다음 단계 연구를 촉진한다.

댓글 및 학술 토론

Loading comments...

의견 남기기