다항식 디코더로 확장된 희소 오토인코더: PolySAE

초록

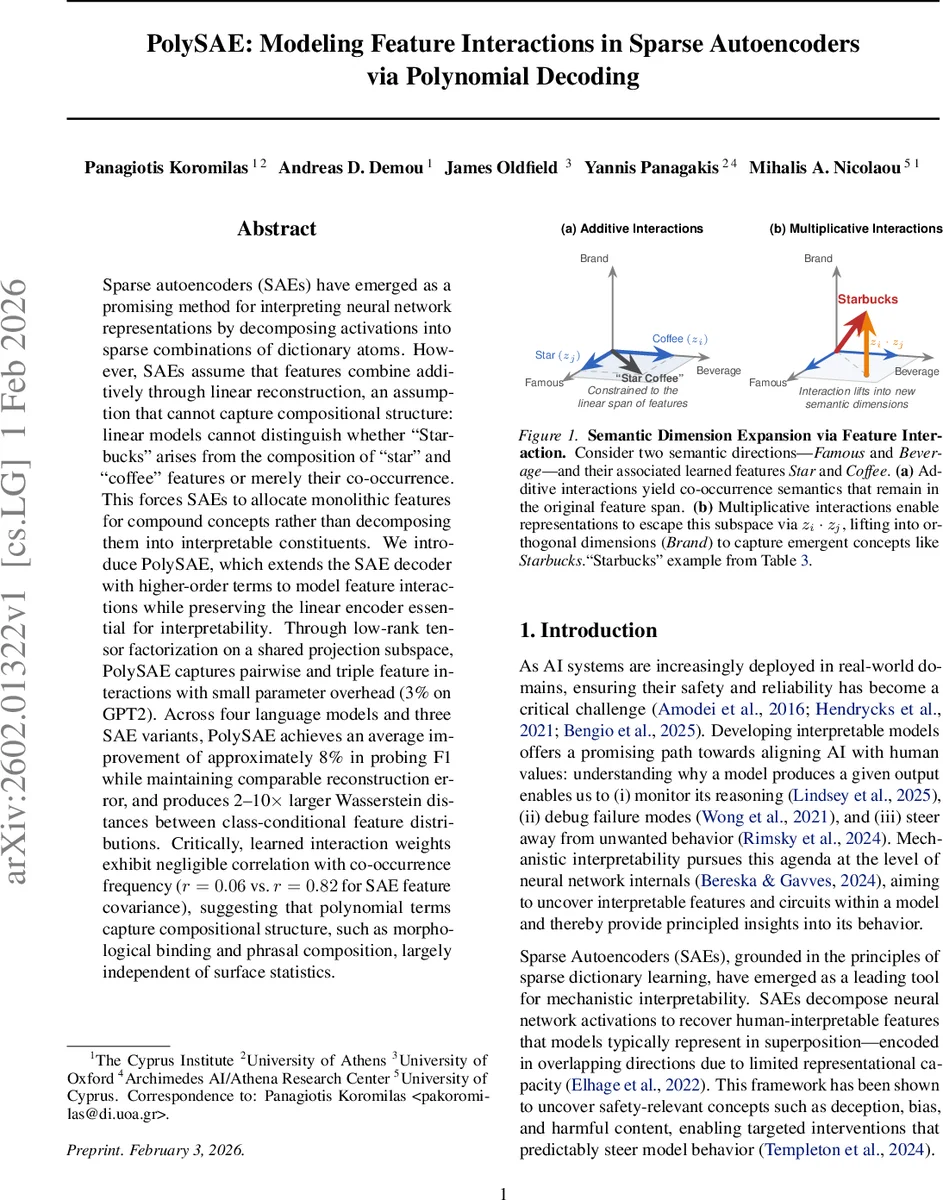

PolySAE는 기존 희소 오토인코더(SAE)의 선형 디코더에 2차·3차 다항식 항을 추가해 특성 간 상호작용을 모델링한다. 저랭크 텐서 분해를 이용해 파라미터 증가를 3% 수준으로 억제하면서, 네 개 언어 모델과 세 가지 SAE 변형에 대해 평균 8%의 프로빙 F1 향상과 클래스 조건부 특성 분포의 워셔스테인 거리 2~10배 확대를 달성한다. 학습된 상호작용 가중치는 단어 공출현 빈도와 거의 무관(r=0.06)해, 형태소 결합·구문 구성 등 의미론적 조합을 포착한다는 점이 핵심이다.

상세 분석

PolySAE는 “선형 인코딩·비선형 디코딩”이라는 설계 원칙을 명확히 구분한다. 인코더는 기존 SAE와 동일하게 입력 활성화를 선형 변환 후 ReLU와 희소화 연산을 적용해 해석 가능한 잠재 변수 z를 얻는다. 이는 기계적 해석에서 각 z_i가 입력 공간의 특정 방향과 직접 대응한다는 가정을 유지한다. 디코더는 z에 대한 1차(선형), 2차(쌍곱), 3차(삼중곱) 항을 포함하는 다항식 형태로 확장된다. 2차 항 y₂ = B (z ⊗ z), 3차 항 y₃ = Γ (z ⊗ z ⊗ z)에서 B와 Γ는 각각 저랭크 텐서 분해를 통해 파라미터 수를 O(d_sae·r) 수준으로 압축한다. 여기서 r은 공유 투영 행렬 U의 차원으로, 실험에서는 전체 파라미터 대비 3% 정도만 추가된다. 이러한 저랭크 구조는 (P3) “상호작용은 선형 특성 공간과 정렬된 저차원 서브스페이스에서 발생한다”는 가정을 구현한다. 또한 (P4) “낮은 차수 항이 높은 차수 항보다 더 큰 표현 용량을 갖는다”는 제약을 λ₂, λ₃ 스칼라 가중치와 정규화로 구현해 과적합을 방지한다.

학습 목표는 재구성 손실과 L1 기반 희소성 손실을 동시에 최소화하는 것이며, λ₂·λ₃를 조정해 2차·3차 항의 기여도를 조절한다. λ₂=λ₃=0이면 기존 SAE와 동일한 동작을 보이므로, PolySAE는 기존 파이프라인에 무리 없이 적용 가능하다.

실험에서는 GPT‑2 Small, Pythia‑410M/1.4B, Gemma‑2‑2B 등 네 가지 모델과 TopK, BatchTopK, Matryoshka 등 세 가지 희소화 전략을 조합해 12가지 설정을 평가했다. 결과는 다음과 같다.

- 프로빙 F1 점수가 평균 8% 상승했으며, 특히 복합 의미(예: “Starbucks”, “administrators”)를 다루는 태스크에서 큰 개선을 보였다.

- 재구성 오류는 선형 SAE와 거의 동일하게 유지돼, 다항식 항이 과도한 재구성 부담을 주지 않음을 확인했다.

- 클래스별 특성 분포의 워셔스테인 거리가 2~10배 확대돼, 특성 공간이 의미론적으로 더 명확히 구분됨을 의미한다.

- 학습된 상호작용 가중치와 단어 공출현 빈도 간 상관계수는 r=0.06으로 거의 무관했으며, 이는 SAE의 특성 공분산(r=0.82)과 크게 대비된다. 즉, 다항식 항이 표면 통계가 아닌 의미론적 결합을 포착한다는 강력한 증거다.

정성적 분석에서는 형태소 결합(“admin‑istr‑ator”), 파생어 접미사(“-ing”, “-tion”)와 같은 내부 구조, 그리고 구문적 조합(“kick the bucket”)이 상호작용 텐서에서 높은 가중치를 갖는 사례를 제시한다. 또한, 동일한 원형 단어가 다른 문맥에서 다른 상호작용 패턴을 보이며, 이를 통해 PolySAE가 문맥 의존적 의미 구분에도 유용함을 보여준다.

한계점으로는 현재 3차 항까지 제한했으며, 더 높은 차수 항을 도입하면 파라미터와 계산 비용이 급증한다는 점이다. 또한, 저랭크 차원 r을 어떻게 최적화할지에 대한 자동화된 기준이 부족하다. 향후 연구에서는 동적 차수 선택, 메모리 효율적인 텐서 압축, 그리고 비언어 모델(예: 비전, 강화학습)에서의 적용 가능성을 탐색할 여지가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기