퍼시안 추론 QA 벤치마크 PARSE 발표

초록

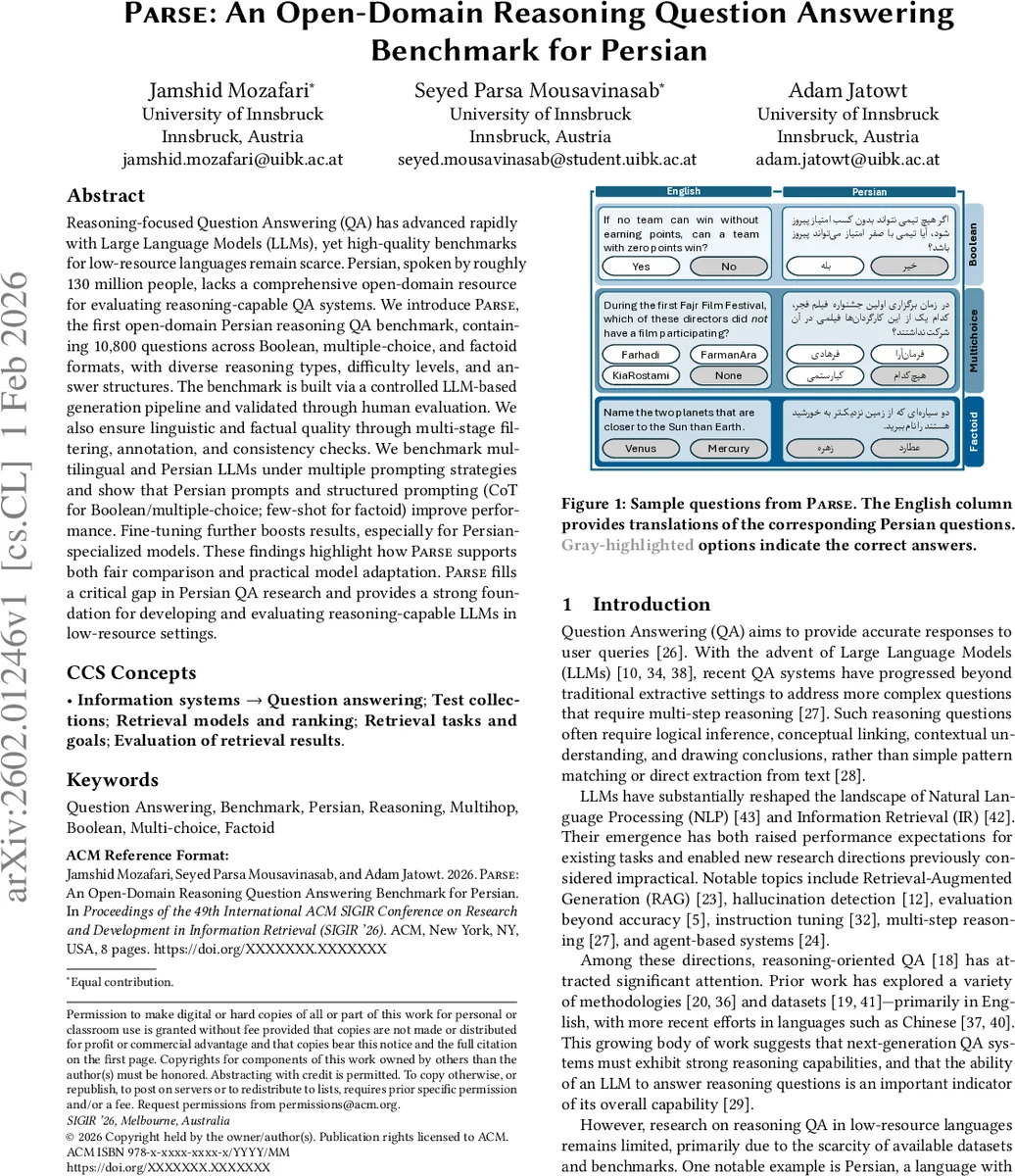

PARSE는 10,800개의 불리언·다중선택·팩트형 질문을 포함한 퍼시안 오픈‑도메인 추론 QA 데이터셋으로, LLM 기반 자동 생성·다단계 인간 검증 과정을 거쳐 난이도·추론 유형을 체계화하였다. 다국어·퍼시안 LLM을 다양한 프롬프트(Zero‑shot, Few‑shot, CoT)와 파인튜닝으로 평가해 퍼시안 특화 모델의 성능 향상을 입증한다.

상세 분석

본 논문은 저자들이 퍼시안(페르시아어) 사용자를 위한 최초의 오픈‑도메인 추론 질문응답(Question Answering, QA) 벤치마크인 PARSE를 설계·구축한 과정을 상세히 기술한다. 먼저 기존 영문 QA 데이터셋(예: SQuAD, HotpotQA, MultiRC 등)과 비교해 퍼시안 분야는 질문 유형, 다중 홉, 추론, 다답, 비답변 등 다양한 차원을 포괄하는 데이터가 부족함을 지적한다. 이를 메우기 위해 저자들은 ‘불리언(Boolean)’, ‘다중선택(Multiple‑choice)’, ‘팩트형(Factoid)’ 세 가지 기본 형식을 채택하고, 각 형식에 ‘다중 홉(Multihop)’, ‘복합 추론(Reasoning)’, ‘부정(Negation)’, ‘비교(Comparative)’ 등 6가지 서브타입을 교차시켜 총 18개의 구성(각 600개 질문)으로 설계하였다. 난이도는 ‘쉬움·보통·어려움’ 세 단계로 라벨링해 모델의 추론 깊이를 정량화한다.

데이터 생성 파이프라인은 GPT‑4o를 활용한 프롬프트 기반 자동 생성과 인간 검증을 결합한다. 프롬프트는 (1) 역할 설명, (2) 목표 QA 타입·서브타입, (3) 구체적 제약조건(예: 답변 형식, 옵션 수, 페르시아어 사용, 현실성, 주제 다양성), (4) CSV 형태 출력 지시 등 네 부분으로 구성돼 재현성을 높였다. 각 서브타입당 30문항씩 배치 생성하고, 품질 저하를 방지하기 위해 배치 크기를 제한했다. 생성된 문항은 CSV → JSON 스키마 변환 후 구조적 검증, 중복 제거, 옵션 일관성, 난이도‑추론 깊이 검증 등 다중 단계 필터링을 거친다. 특히 ‘다중 홉’ 질문은 단일 문서 회상에 머무르지 않도록 증거 체인을 명시하도록 프롬프트를 설계했다.

인간 평가 단계에서는 12명의 원어민 평가자가 ‘모호성’, ‘가독성’, ‘정확성’ 3가지 항목을 1‑5점 척도로 평가했으며, 난이도 라벨링의 타당성을 검증하기 위해 별도 난이도 평가를 수행했다. 결과는 평균 4.4점 이상(5점 만점)으로 전반적인 품질이 높음을 보여준다. 또한 난이도별 정확도는 ‘쉬움’ > ‘보통’ > ‘어려움’ 순으로 인간 정답률이 감소했으며, 이는 모델 평가 시 난이도 구분이 의미 있음을 시사한다.

벤치마크 평가에서는 다국어 LLM(Qwen, LLaMA, Mistral, Gemma 등)과 퍼시안 특화 모델을 Zero‑shot, Few‑shot, Chain‑of‑Thought(CoT) 프롬프트로 테스트했다. 실험 결과, (1) 퍼시안어 프롬프트가 영어 프롬프트보다 전반적으로 높은 정확도를 보였으며, (2) CoT 방식이 Boolean·Multiple‑choice 질문에서 특히 효과적이었다. Factoid 질문은 Few‑shot이 가장 좋은 성능을 냈다. 모델 규모가 클수록(예: LLaMA‑70B, Qwen‑72B) 성능이 향상됐지만, 파인튜닝을 통해 퍼시안 전용 모델이 동일 규모의 다국어 모델을 능가했다. 파인튜닝 전후 차이는 특히 ‘다중 홉’·‘복합 추론’ 서브타입에서 두드러졌다.

논문의 주요 기여는 (① 퍼시안 최초 오픈‑도메인 추론 QA 데이터셋 제공, (② LLM 기반 자동 생성·다단계 인간 검증 파이프라인 공개, (③ 다양한 프롬프트와 파인튜닝이 퍼시안 모델 성능에 미치는 영향을 실증)이다. 한계점으로는 현재 질문이 주로 일반 상식·문화 영역에 국한돼 있어 전문 도메인(예: 의료, 법률) 확장이 필요하고, LLM 생성 단계에서 아직도 미세한 사실 오류가 존재한다는 점을 언급한다. 향후 연구는 도메인‑특화 질문 추가, 자동 사실 검증 모듈 도입, 그리고 인간‑LLM 협업 생성 방식을 탐색할 예정이다.

댓글 및 학술 토론

Loading comments...

의견 남기기