코드 생성의 흐름을 뒤바꾸는 자체 수정 디코딩

초록

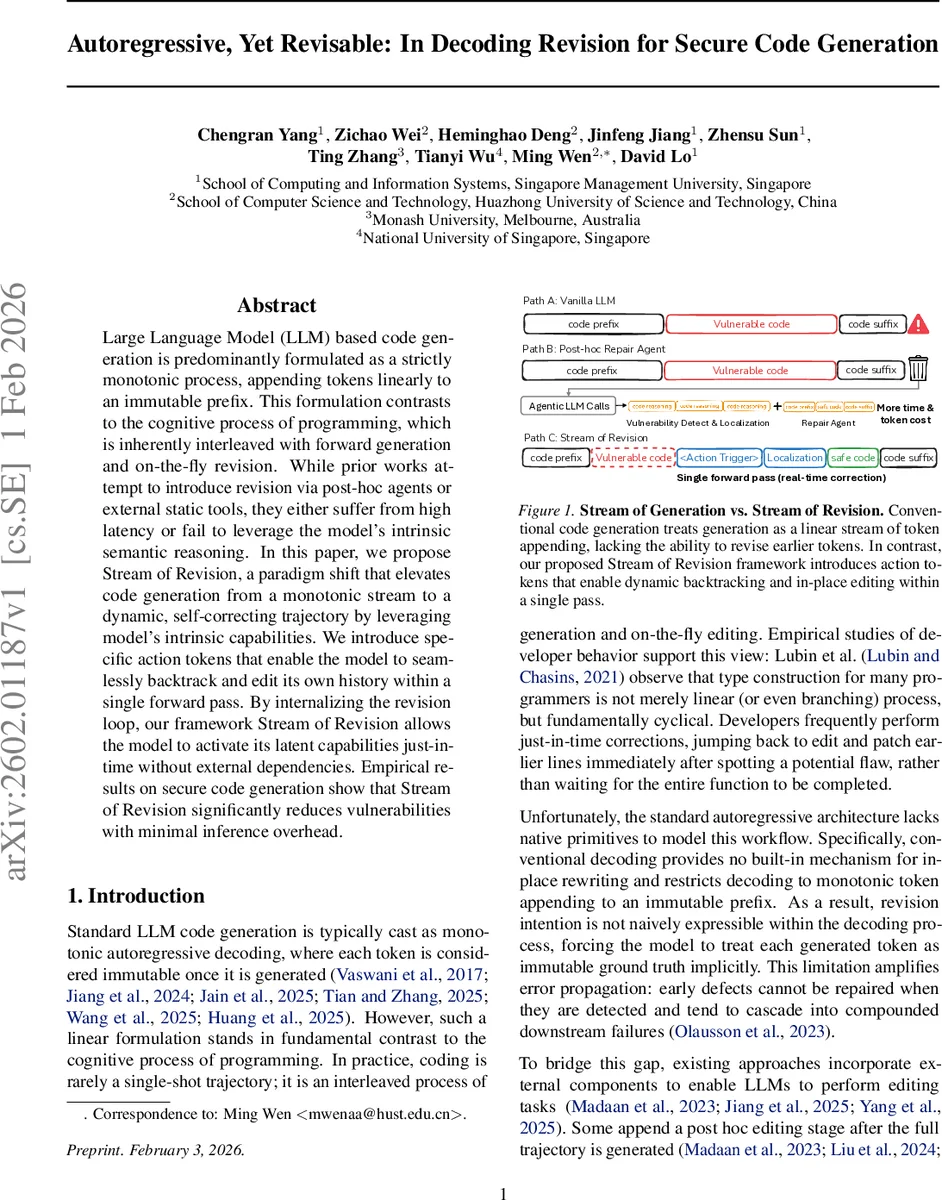

본 논문은 대형 언어 모델(LLM) 기반 코드 생성에서 기존의 단방향 토큰 추가 방식을 탈피해, 모델 자체가 실시간으로 코드를 뒤로 돌아가 수정할 수 있는 “Stream of Revision” 프레임워크를 제안한다. 특별히 설계된 액션 토큰(수정 트리거, 범위 지정, 패치 삽입)을 통해 하나의 전방 패스 안에서 취약점 탐지·위치 파악·수정이라는 세 단계의 보안 리비전을 수행한다. 결정적 렌더러가 토큰 스트림을 실행 가능한 프로그램으로 변환하며, 실험 결과 사이버 보안 평가 벤치마크(CyberSecEval 2)에서 취약점 감소와 추론 비용 최소화를 동시에 달성한다.

상세 분석

이 논문은 LLM 기반 코드 생성이 “단조적 자동회귀”라는 근본적 한계에 봉착한다는 점을 정확히 짚어낸다. 기존 모델은 한 번 생성된 토큰을 불변의 프리픽스로 고정시켜, 이후 토큰이 그 위에만 쌓이게 된다. 이 구조는 개발자가 코드를 작성하면서 즉시 오류를 수정하는 인간적 작업 흐름과 정면으로 충돌한다. 저자들은 이를 해결하기 위해 “Stream of Revision”이라는 새로운 디코딩 패러다임을 도입한다. 핵심 아이디어는 모델의 어휘에 몇 개의 특수 액션 토큰을 추가해, 토큰 스트림 자체가 “수정 에피소드”를 표현하도록 하는 것이다.

첫 번째 액션 토큰인 τ_trig(수정 트리거)는 모델이 현재까지 생성된 코드에 보안 취약점이 존재함을 감지했을 때 발동한다. 이 토큰이 출력되면 디코더는 “수정 모드”로 전환되고, 이어서

두 번째 단계는

전체 토큰 스트림은 여전히 선형적으로 모델에 의해 생성되지만, Deterministic Renderer(Φ)가 실행 단계에서 “가상 커서” 개념을 도입해 토큰 스트림을 실제 프로그램으로 변환한다. 렌더러는 일반 코드 토큰은 즉시 버퍼에 추가하고, 수정 트리거가 등장하면 내부적으로 범위와 패치를 버퍼에 적용한다. 적용은 “Atomic Commitment” 원칙에 따라 패치 종료 토큰()이 등장했을 때만 수행되며, 이는 사용자에게 중간 수정 과정을 숨긴다.

학습 측면에서는 새로 추가된 토큰들의 임베딩을 의미론적 설명(예: “trigger revision”)의 가중 평균으로 초기화해 콜드 스타트 문제를 완화한다. 이후 실제 CVE 기록에서 추출한 코드 차이(diff)를 기반으로 만든 “revision trajectory” 데이터를 사용해 감독 학습(SFT)을 진행한다. 저자는 1,000개의 양성 예시만으로도 모델이 자체 수정 행동을 충분히 학습할 수 있음을 실증한다.

효율성 분석에서는 기존 포스트-핵 수정 방식이 전체 컨텍스트를 재인코딩해야 하는 O(L) 비용에 비해, 제안 방식은 패치 길이에 비례하는 O(1) 비용만을 요구한다는 점을 강조한다. 실험 결과, CyberSecEval 2 벤치마크에서 취약점 탐지·수정 정확도가 기존 최첨단 모델을 능가하면서도 추론 지연이 5~10% 수준으로 미미하게 증가했다.

전체적으로 이 논문은 LLM이 내재하고 있는 “잠재적 자기 수정 능력”을 외부 도구 없이도 한 번의 디코딩 패스로 끌어내는 설계적 혁신을 제시한다. 액션 토큰 기반의 수정 흐름, 가상 커서와 결정적 렌더러, 그리고 데이터 효율적인 학습 전략이 조화를 이루어, 보안 코드 생성뿐 아니라 일반적인 프로그래밍 지원에도 확장 가능한 기반을 제공한다. 다만 현재는 보안 취약점에 초점을 맞추었으며, 복잡한 다중 파일 프로젝트나 비정형 코드 리팩터링 등 더 넓은 적용 범위에 대한 추가 연구가 필요하다.

댓글 및 학술 토론

Loading comments...

의견 남기기