이미지 감정 이해를 위한 통합 데이터셋과 다단계 프레임워크

초록

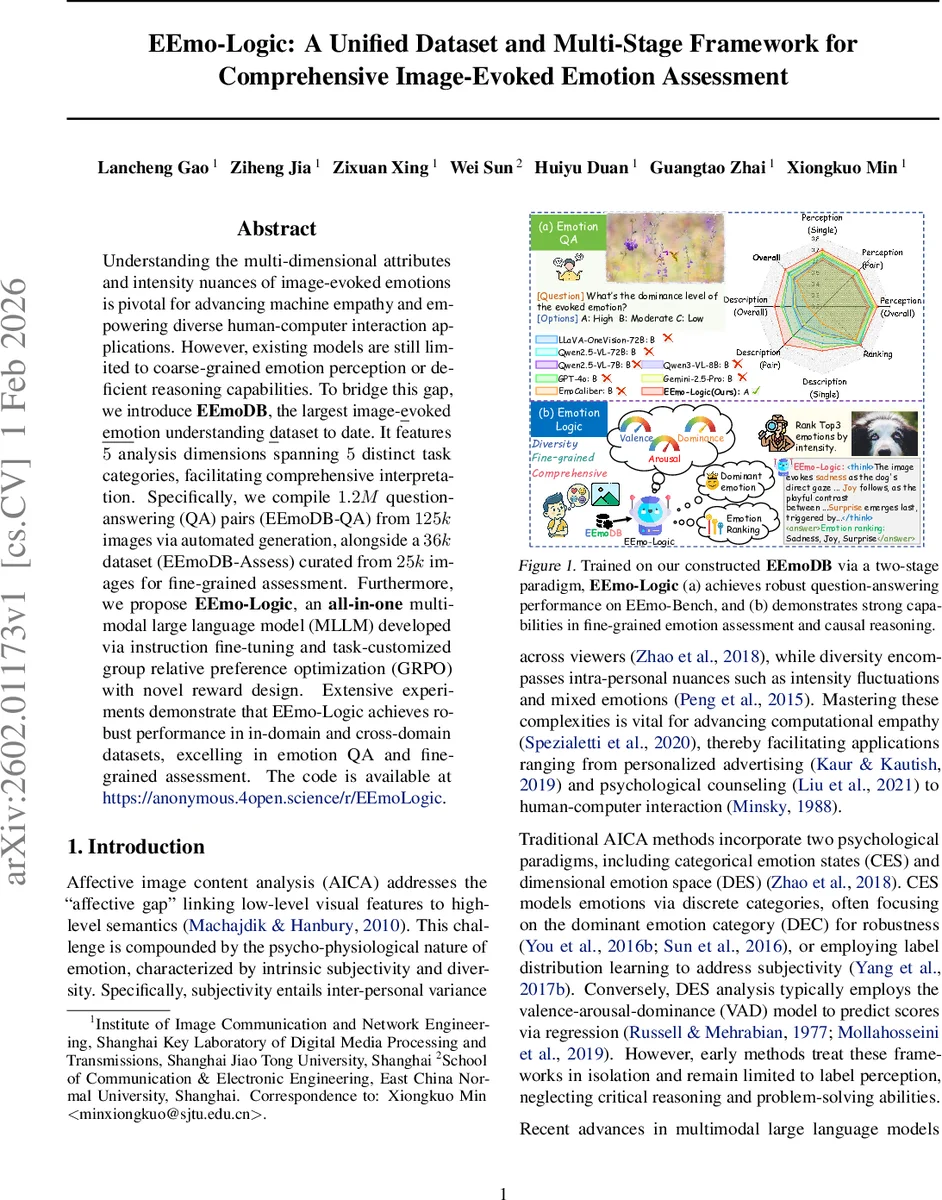

EEmo-Logic은 125만 개 QA쌍과 3만6천 개 정밀 평가 데이터를 포함한 대규모 이미지 감정 데이터셋(EEmoDB)을 기반으로, 감정의 범주(CES)와 차원(DES)을 동시에 다루는 멀티모달 대형 언어 모델을 제안한다. 두 단계 학습(LoRA 기반 SFT → GRPO 기반 미세조정)으로 감정 QA와 정밀한 VAD·지배도·감정 순위 예측 능력을 확보했으며, 인‑도메인·크로스‑도메인 벤치마크에서 최첨단 성능을 기록한다.

상세 분석

본 논문은 이미지 기반 감정 인식(Affective Image Content Analysis, AICA) 분야에서 기존 연구가 주로 감정 범주(CES) 혹은 정서 차원(DES) 중 하나에만 초점을 맞추는 한계를 지적한다. 이를 극복하기 위해 저자들은 5가지 분석 차원(Valence, Arousal, Dominance, Dominant Emotion, Emotion Ranking)을 모두 포괄하는 통합 데이터셋 EEmoDB를 구축하였다. 데이터셋은 7개의 공개 AICA 데이터(예: EMOTIC, GAPED, OASIS 등)를 원천으로 삼아 라벨 매핑, VAD 스코어 생성, 설명·추론 텍스트 자동 생성 파이프라인을 적용, 총 1.23 M 개의 멀티모달 명령어(Instruction)를 포함한다. 특히 감정 순위(Ranking)와 설명(Description) 태스크를 위해 DeepSeek과 Qwen2.5-VL 모델을 활용해 인간 전문가 주석에 기반한 합리적 추론을 강제함으로써, 자동 생성에 따른 허위 정보(hallucination)를 최소화하였다.

모델 설계 측면에서는 두 단계 학습 전략을 채택한다. 1단계에서는 LoRA 기반의 Supervised Fine‑Tuning(SFT)을 EEmoDB‑QA에 적용해 기본적인 감정 인식·질문‑답변 능력을 습득한다. 2단계에서는 새롭게 제안한 Group Relative Preference Optimization(GRPO)을 EEmoDB‑Assess에 적용, 감정 순위, VAD 점수, 지배도 등 정밀 평가 태스크에 특화된 계층형 보상 함수를 설계한다. 이 보상은 (i) 정답 일치도, (ii) 라벨 분포 균일성, (iii) 의미적 정렬을 동시에 고려해 모델이 미세한 강도 차이를 학습하도록 유도한다. 결과적으로 EEmo-Logic은 기존 MLLM(예: Qwen, LLaVA, GPT‑4o 등) 대비 감정 QA 정확도와 VAD 회귀 정확도에서 유의미한 향상을 보이며, 특히 감정 순위 추론에서 인간 수준에 근접한 성능을 기록한다.

강점으로는 (1) 데이터 규모와 차원 다양성, (2) 자동 생성 파이프라인에 인간 검증을 결합한 라벨 정제, (3) 두 단계 학습과 맞춤형 GRPO를 통한 정밀 감정 평가 능력 향상이 있다. 반면 한계점은 자동 라벨링 과정에서 발생할 수 있는 편향(bias)과 라벨 불확실성, 그리고 평가가 주로 공개 벤치마크에 국한돼 실제 사용자 환경에서의 일반화 가능성을 충분히 검증하지 못했다는 점이다. 또한 GRPO 보상의 설계가 복잡하여 재현성(reproducibility) 측면에서 추가적인 공개가 필요하다. 향후 연구에서는 인간‑컴퓨터 상호작용 시나리오에 대한 사용자 연구와, 감정 다중 라벨링을 위한 보다 정교한 불확실성 모델링이 요구된다.

댓글 및 학술 토론

Loading comments...

의견 남기기