다양한 촉각 센서를 위한 통합 잠재 힘 모델 UniForce

초록

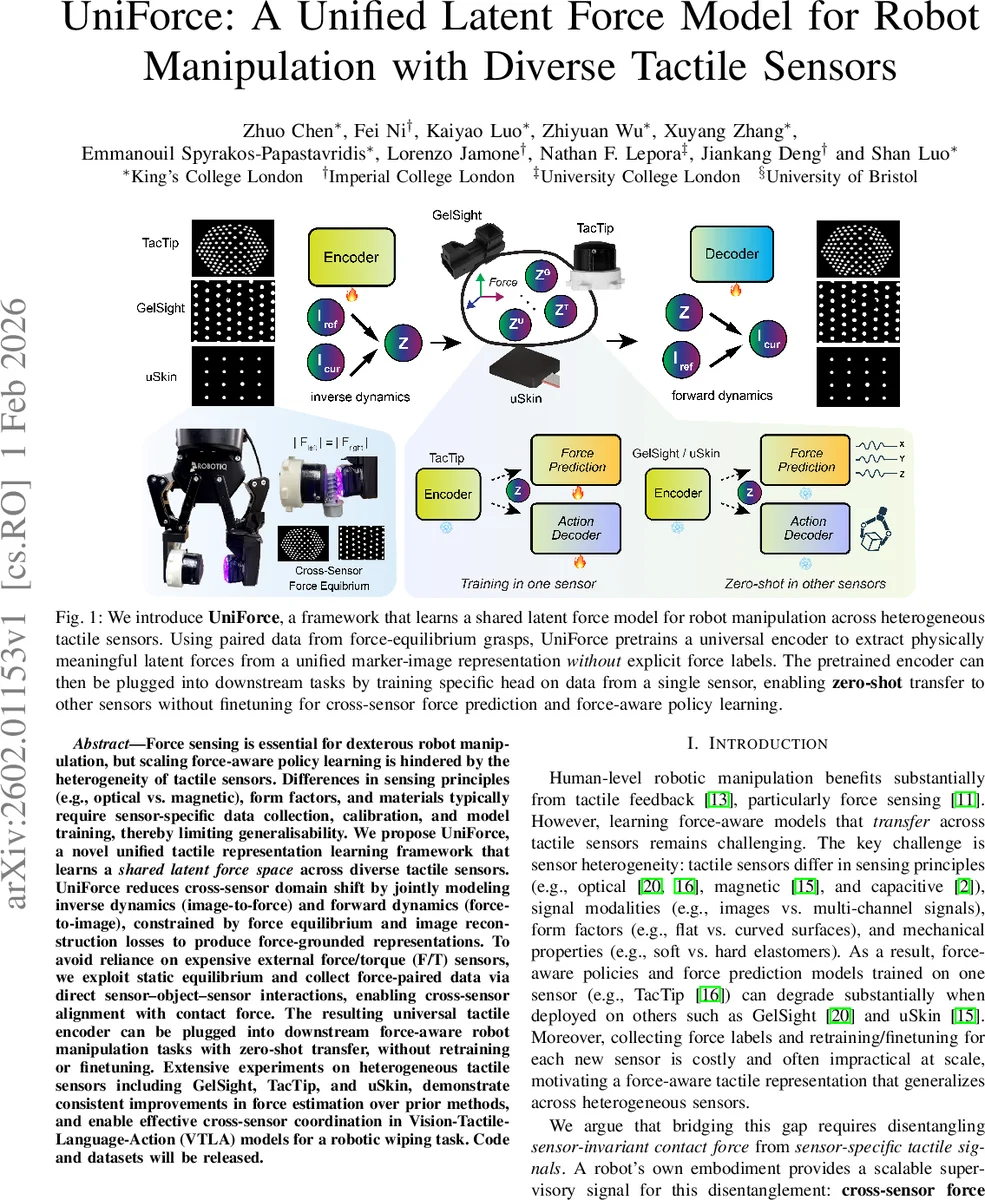

UniForce는 서로 다른 촉각 센서(GelSight, TacTip, uSkin) 간의 물리적 힘 평형을 이용해 라벨 없이 공통의 잠재 힘 공간을 학습한다. 인버스‑포워드 동역학을 결합한 CVAE 구조와 이미지‑재구성·KL·힘 평형 손실을 통해 센서 독립적인 힘 표현을 얻으며, 학습된 인코더는 별도 재학습 없이 다양한 로봇 조작 과제에 제로샷으로 적용할 수 있다.

상세 분석

본 논문은 촉각 센서의 이질성—광학, 자기, 전기 등 전이 원리와 형태·재질 차이—가 힘 기반 정책 학습을 저해한다는 문제를 제기한다. 이를 해결하기 위해 저자들은 ‘힘 평형’이라는 물리적 제약을 활용한다. 두 손가락이 quasi‑static 상태에서 물체를 잡을 때 발생하는 ‘동등하고 반대 방향의 접촉력’은 센서 종류와 무관하게 동일하므로, 이 정보를 암묵적인 라벨로 사용한다. UniForce는 이러한 라벨 없이도 서로 다른 센서에서 수집된 이미지 쌍을 이용해 공동 잠재 힘 공간을 학습한다.

아키텍처는 Conditional Variational Auto‑Encoder(CVAE) 형태이며, 인코더는 reference 이미지와 contact 이미지(시간 순서 0→T)를 patch‑wise 토큰화한 뒤 Causal Spatiotemporal Transformer를 통해 변형 특징을 추출한다. 출력은 각 패치별 6차원 힘 벡터(힘·토크)를 평균·분산 형태의 대각 가우시안으로 매핑한다. 디코더는 동일한 reference 이미지를 조건으로 사용해 latent force를 다시 이미지로 복원한다. 여기서 중요한 점은 ‘self‑reconstruction’과 ‘cross‑sensor reconstruction’ 두 경로를 동시에 학습함으로써 latent force가 센서 고유의 마커 패턴을 배제하고 순수한 물리량을 담도록 유도한다.

손실 함수는 세 부분으로 구성된다. ① 재구성 손실은 L1과 LPIPS를 결합해 마커 변형을 정밀히 복원한다. ② KL 손실은 VAE의 정규화를 담당한다. ③ 힘 평형 손실은 좌·우 손가락의 latent force 맵 z_L, z_R 사이의 L2 차이를 최소화해 물리적 힘 일치를 강제한다. 이러한 다중 목표 최적화는 센서 간 도메인 갭을 효과적으로 감소시킨다.

데이터 수집 단계에서는 외부 F/T 센서를 사용하지 않는다. 대신 TacTip을 기준 센서로 고정하고, 반대쪽 손가락에 GelSight 혹은 uSkin을 교체해 쌍을 만든다. 로봇은 임피던스 제어로 서서히 압입·전단을 가하면서 quasi‑static 상태를 유지하고, 각 센서의 reference·contact 이미지(또는 마커 이미지·다채널 신호)를 기록한다. 이 과정은 30분 이내에 8,000 프레임 정도를 확보한다.

실험에서는 힘 추정 정확도, 라벨 없는 cross‑sensor 전이, 그리고 Vision‑Tactile‑Language‑Action(VTLA) 모델에의 적용을 평가한다. UniForce는 기존 이미지‑투‑이미지 변환 기반 방법보다 평균 Pearson r이 0.85 이상으로 크게 향상되며, 제로샷 전이 시에도 10% 이하의 성능 저하만 보인다. 특히 VTLA 기반 로봇 닦기 작업에서, UniForce 인코더를 사용한 경우 물체 표면 커버리지가 92%에 달해, 센서 교체 후에도 안정적인 정책 수행이 가능함을 입증한다.

핵심 기여는 (1) 물리 기반 라벨 프리 힘 평형 데이터 수집 파이프라인, (2) 센서 독립적인 잠재 힘 공간을 학습하는 CVAE 프레임워크, (3) 제로샷 전이 능력을 갖춘 범용 촉각 인코더이다. 제한점으로는 quasi‑static 상황에 의존한다는 점과, 현재는 2‑손가락 대칭 그립에만 적용 가능하다는 점을 들 수 있다. 향후 동적 접촉, 다손가락 그립, 그리고 비대칭 물체에 대한 확장이 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기