RLVR 훈련 불안정성의 근본 원인, 목표‑레벨 해킹으로 밝히다

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

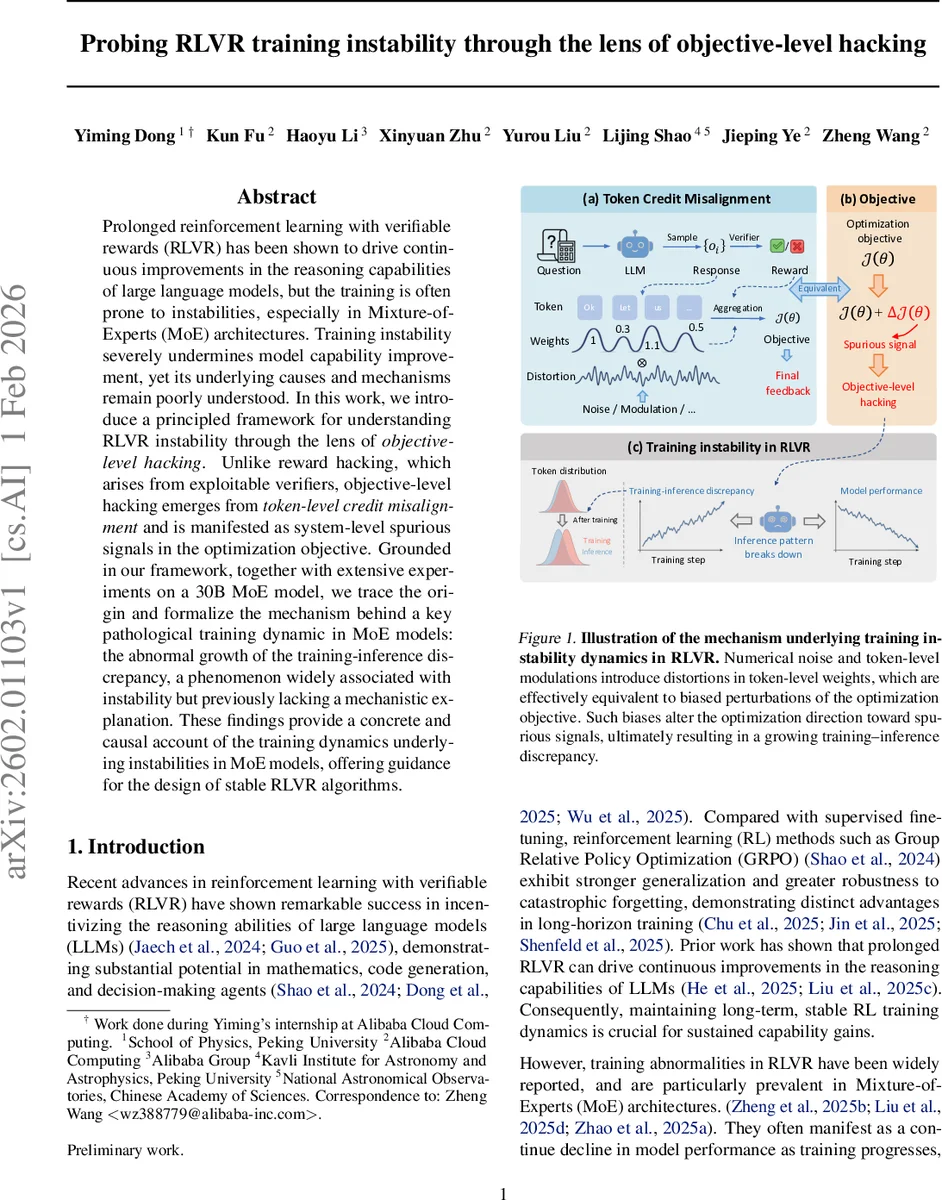

본 논문은 대규모 언어 모델의 강화학습(RLVR) 과정에서 발생하는 불안정성을 ‘목표‑레벨 해킹’이라는 새로운 관점으로 규명한다. 토큰 수준의 크레딧 불일치가 최적화 목표에 스퓨리어스 신호를 주입해 훈련‑추론 간 격차를 확대시키는 메커니즘을 수식화하고, 30B MoE 모델 실험을 통해 초기 불일치, 토큰 클리핑, 인위적 가중치 왜곡 등이 모두 이 현상을 가속한다는 사실을 입증한다.

상세 분석

본 연구는 RLVR(Verifiable Rewards 기반 강화학습)에서 관찰되는 훈련 불안정성을 ‘목표‑레벨 해킹(objective‑level hacking)’이라는 개념으로 재정의한다. 기존의 보상 해킹이 검증자(verifier)의 취약점에 의해 발생한다면, 목표‑레벨 해킹은 토큰‑레벨 크레딧 정렬이 깨져 최적화 목표 자체에 왜곡된 신호가 삽입되는 현상이다. 논문은 먼저 GRPO(그룹 상대 정책 최적화)의 수식적 정의를 제시하고, 훈련 단계와 추론 단계에서 사용되는 모델(π_train, π_infer)의 토큰 분포 차이가 중요도 가중치 ρ_i,t의 분산으로 나타나는 ‘훈련‑추론 불일치’를 초래함을 보인다.

핵심적인 수식 전개는 다음과 같다. 이상적인 목표 J(θ)는 훈련 토큰 분포에 대한 기대값이지만, 실제로는 추론 토큰 분포에 대한 기대값 J′(θ)로 변형된다. 이 변형은 ΔJ(θ) ≈ Cov_train

댓글 및 학술 토론

Loading comments...

의견 남기기