초월적 학습 속도: 슈퍼포지션이 만든 파워‑로우 통일

초록

본 논문은 교사‑학생 프레임워크를 이용해 특성 슈퍼포지션이 학습 손실의 파워‑로우 감소에 미치는 영향을 분석한다. 슈퍼포지션이 없을 때는 입력 데이터의 스펙트럼과 채널 중요도에 따라 지수 α = (a+2b‑1)/a가 결정된다. 반면 차원 압축(K ≤ N)으로 슈퍼포지션이 강제되면 학습 지수가 α≈1로 수렴하고, 이는 데이터·채널 통계와 무관하게 약 10배 빠른 수렴을 보인다. 이러한 결과는 대규모 언어 모델 등 슈퍼포지션을 활용하는 네트워크의 스케일링 법칙을 재해석하는 데 중요한 시사점을 제공한다.

상세 분석

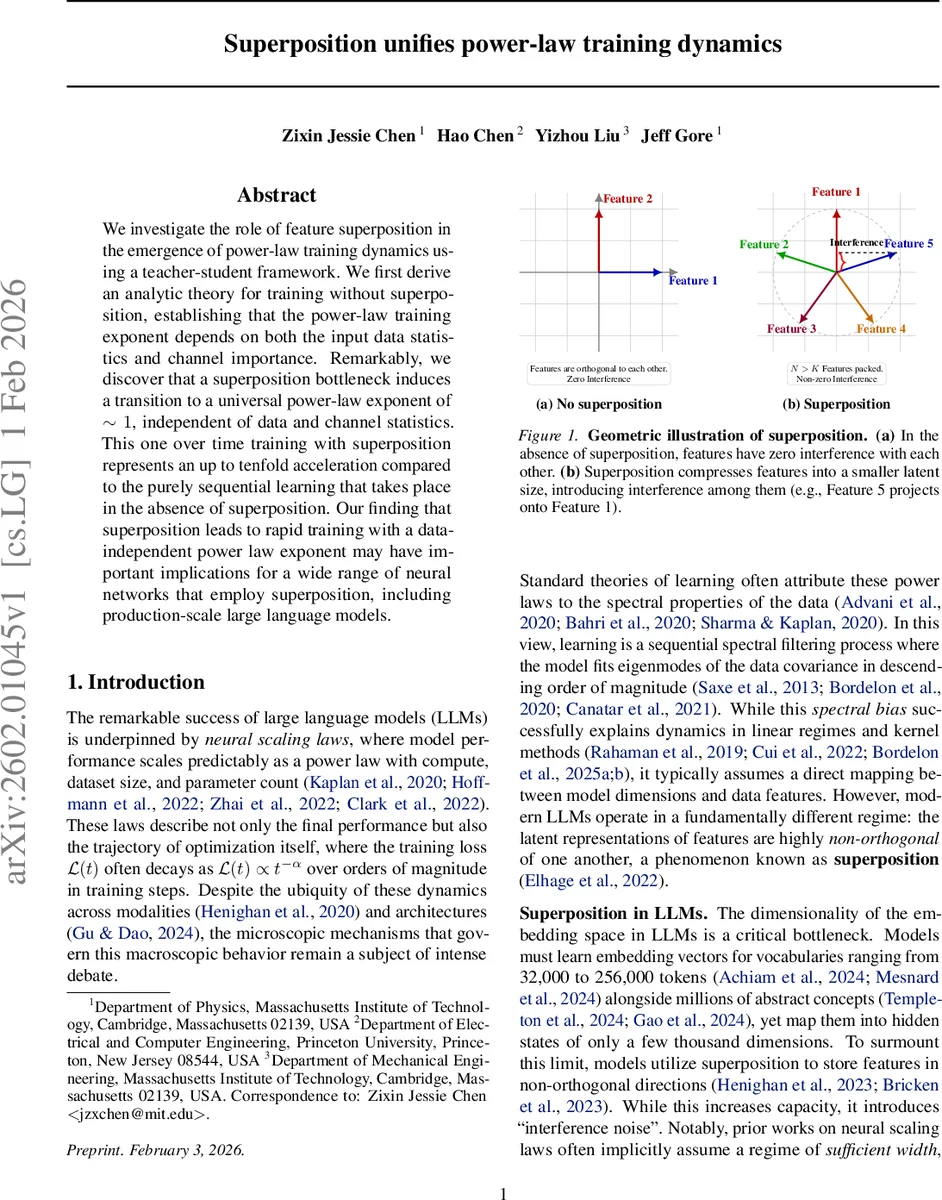

이 논문은 현대 대형 언어 모델(LLM)이 제한된 임베딩 차원에 수십만 개의 토큰과 수백만 개의 추상 개념을 압축 저장해야 하는 현실을 “슈퍼포지션”이라는 현상으로 모델링한다. 저자는 먼저 K = N인 완전 차원(슈퍼포지션 없음) 상황을 분석해, 입력 피처의 등장 빈도가 p_i ∝ i^‑a, 채널 중요도가 A_ii ∝ i^‑b 로 정의된 경우, 각 피처가 독립적으로 학습되는 선형 ODE ds_i/dt = η λ_i (a_i‑s_i) 를 도출한다. 여기서 λ_i는 데이터 공분산의 스펙트럼(∝ i^‑a)이고, a_i는 교사의 채널 가중치(∝ i^‑b)이다. 해를 대입하면 손실 L(t) ≈ ∑ i i^‑(a+2b) exp(‑2ηt i^‑a) 가 얻어지고, 대규모 N에서 적분 근사를 하면 L(t) ∝ t^‑α, α = (a+2b‑1)/a 라는 파워‑로우 지수가 도출된다. 즉, 데이터가 더 희소하거나 채널이 빠르게 감소할수록 학습이 가속화된다는 직관적 결과가 수식적으로 확인된다.

다음으로 K < N인 차원 압축 상황을 고려한다. 여기서는 입력을 무작위 정규화된 행렬 W∈ℝ^{K×N} 로 투사해 잠재 공간에 압축하고, B∈ℝ^{K×K} 로 처리한 뒤 W^T 로 복원한다. 압축으로 인해 피처들이 서로 겹쳐(비직교) 나타나 “간섭 노이즈”가 발생한다. 이를 억제하기 위해 편향 b와 ReLU 비선형을 도입했으며, 이는 음수 간섭을 차단하는 역할을 한다. 이 구조에서는 각 피처가 독립적으로 학습되지 않고, 무작위 투사에 의해 모든 채널에 고르게 섞이게 된다. 결과적으로 학습 속도는 개별 피처의 스펙트럼이나 채널 가중치에 의존하지 않고, 전체 시스템이 동일한 시간 스케일로 수렴한다. 실험적으로는 K/N 비율을 1/2, 1/4 등으로 변화시켜도 손실 감소 곡선이 t^‑1 형태의 파워‑로우를 보이며, α≈1이 데이터와 채널 파라미터 a, b에 무관하게 유지된다.

이러한 현상은 두 가지 중요한 의미를 가진다. 첫째, 슈퍼포지션이 “특성 혼합”을 통해 학습을 집단화함으로써 전통적인 스펙트럼 기반 학습 이론(NTK regime)과는 다른 새로운 동역학을 만든다. 둘째, LLM과 같이 차원 병목이 심한 시스템에서는 학습 효율이 데이터·모델 설계에 크게 좌우되지 않고, 오히려 압축 비율에 따라 10배 가량 가속될 수 있음을 시사한다. 이는 기존 스케일링 법칙이 가정하는 충분히 넓은 차원(무한 폭) 가정과는 근본적으로 다른 최적‑컴퓨팅 경로를 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기