청취자의 편견: 다언어 음성 모델의 민감도와 공정성 평가

초록

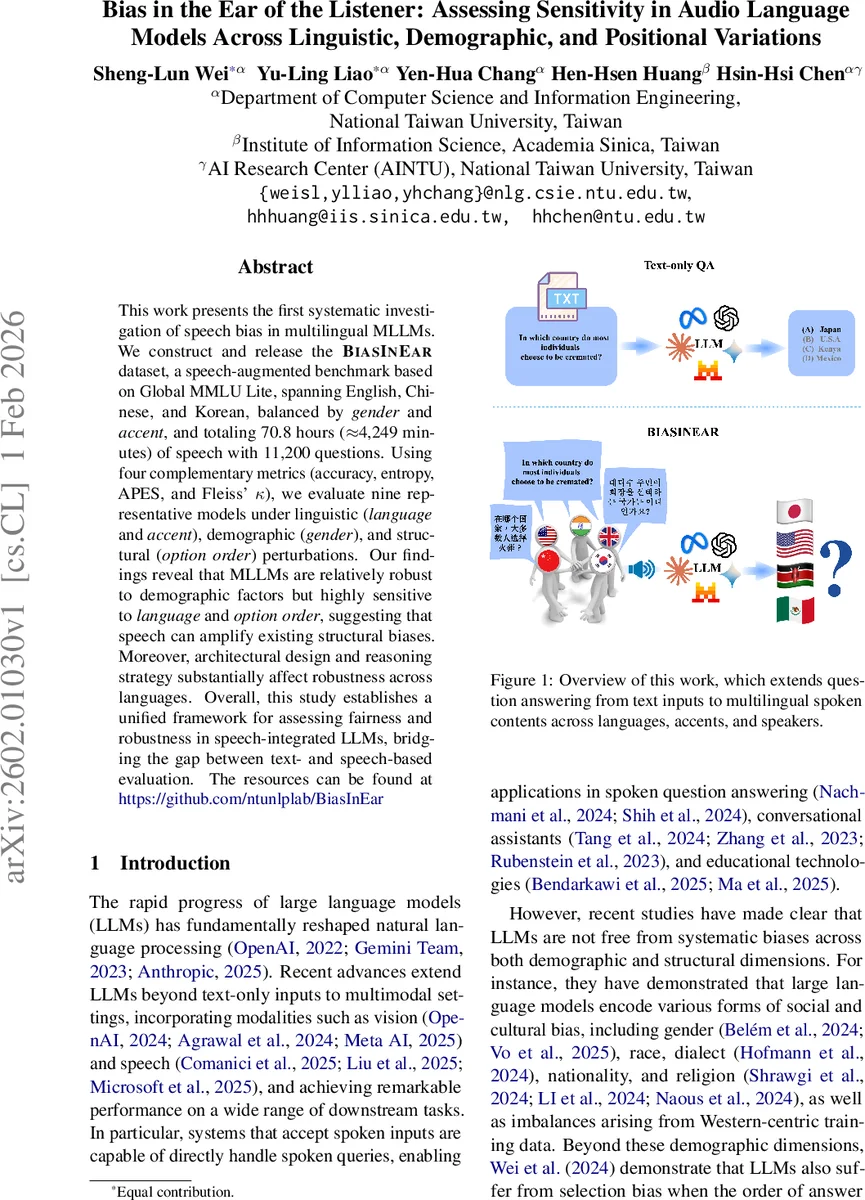

본 논문은 다국어 멀티모달 대형 언어 모델(MLLM)의 음성 입력에 대한 편향을 최초로 체계적으로 조사한다. 영어·중국어·한국어, 성별·악센트가 균형을 이루는 70.8시간, 11,200문항의 BiasInEar 데이터셋을 구축하고, 9개 모델을 언어·악센트·성별·옵션 순서 변형에 따라 정확도, 엔트로피, APES, Fleiss κ 등 네 가지 지표로 평가한다. 결과는 모델이 성별에는 비교적 견고하지만 언어와 옵션 순서에는 크게 민감함을 보여, 음성 입력이 기존 구조적 편향을 증폭시킬 수 있음을 시사한다.

상세 분석

본 연구는 기존 텍스트 기반 편향 연구를 음성 영역으로 확장함으로써 두 가지 주요 기술적 기여를 한다. 첫째, Global MMLU Lite를 기반으로 질문‑답변 형식의 다국어 음성 데이터를 자동 생성하고, GPT‑OSS 120B를 활용해 수학·기호가 포함된 질문을 인간이 읽기 쉬운 형태로 재작성한 뒤 Gemini 2.5 Flash Preview TTS로 고품질 음성을 합성하였다. 데이터 품질 검증은 Whisper Large v3와 Omnilingual ASR 두 모델을 이용한 자동 WER 측정과, 각 언어·WER 구간별 40개 샘플을 대상으로 한 인간 평가를 병행해 90% 이상 ‘Correct’ 등급을 확보함으로써 신뢰성을 확보했다.

둘째, 9개 MLLM(Gemini 2.5 Flash, Gemini 2.5 Flash Lite, Gemini 2.0 Flash, Gemini 2.0 Flash Lite, Gemma 3n E2B, Gemma 3n E4B, Voxtral Small, Voxtral Mini, Phi‑4)을 대상으로 네 가지 지표를 도입해 다차원 편향을 정량화했다. 엔트로피는 모델의 불확실성을, APES는 변수 수준 간 엔트로피 변동폭을, Fleiss κ는 동일 질문에 대한 다양한 음성 조건에서의 일관성을 측정한다. 실험 결과, Gemini·Gemma 계열은 전반적으로 높은 엔트로피와 낮은 κ 값을 보여 변동성이 크고 일관성이 떨어지는 반면, Voxtral 계열은 낮은 엔트로피와 비교적 높은 κ를 기록해 안정적인 예측을 보였다. 특히 옵션 순서를 뒤바꾼 경우 대부분의 모델에서 κ가 급격히 감소했으며, 이는 선택 편향(selection bias)이 음성 입력에서도 그대로 재현됨을 의미한다.

언어별 분석에서는 영어·중국어·한국어 모두에서 성별 변동에 따른 정확도 차이는 미미했지만, 언어 전환 시 엔트로피 상승과 κ 감소가 두드러졌다. 이는 음성 인식 단계에서 언어별 음성 특성(음소, 억양 등)이 오류를 유발하고, 이러한 오류가 downstream LLM의 추론에 전이되는 구조적 약점을 드러낸다. 또한, 악센트 변형(예: 미국식 vs. 영국식, 베이징 vs. 동북)에서도 비슷한 경향이 관찰됐으며, 특히 한국어의 전라와 서울 악센트 차이는 모델에 따라 편차가 크게 나타났다.

이러한 결과는 두 가지 시사점을 제공한다. 첫째, 현재 MLLM은 성별 같은 인구통계적 변수보다는 언어·악센트·옵션 순서와 같은 구조적·언어적 변수에 더 취약하므로, 데이터 수집·학습 단계에서 다언어·다악센트 음성 데이터를 균형 있게 포함시키는 것이 필요하다. 둘째, 모델 설계 측면에서 체인‑오브‑생각(CoT) 프롬프트나 대규모 파라미터를 활용한 아키텍처가 언어 간 편향 완화에 긍정적인 영향을 미칠 가능성이 있음을 암시한다. 향후 연구는 음성‑텍스트 변환 오류를 직접 모델에 통합하거나, 멀티태스크 학습을 통해 언어·악센트 적응성을 강화하는 방향으로 진행될 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기