오류 분류 기반 프롬프트 최적화

초록

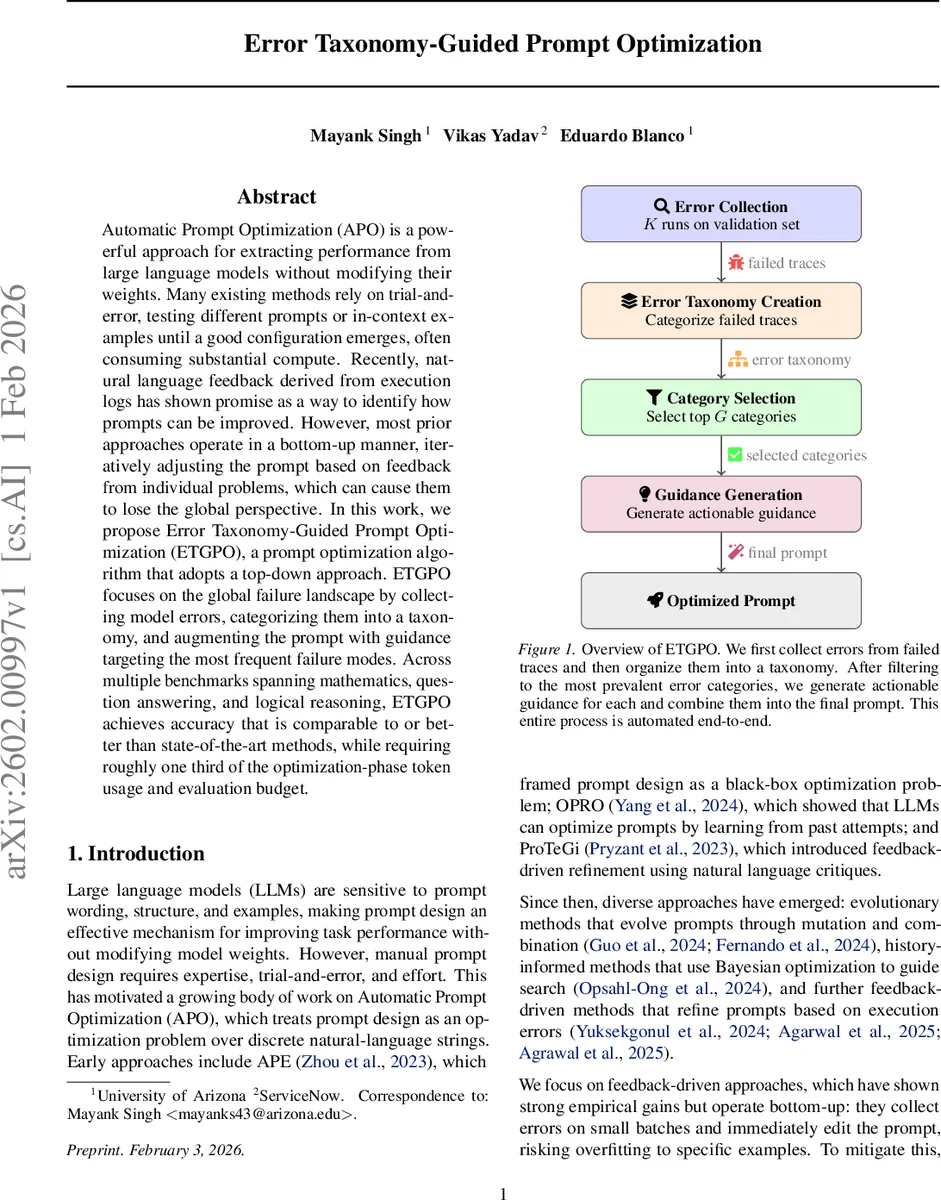

ETGPO는 모델이 전체 데이터셋에서 범하는 오류를 자동으로 수집·분류하고, 가장 빈번한 오류 유형에 대한 구체적인 가이드를 프롬프트에 추가함으로써 자동 프롬프트 최적화를 수행한다. 기존의 하향식(피드백‑드리븐) 방식과 달리 전역 오류 지형을 파악해 상위 G개의 오류 카테고리만을 대상으로 하여 토큰 사용량과 평가 비용을 약 ⅓ 수준으로 줄이면서도 수학·QA·논리 추론 등 여러 벤치마크에서 최첨단 성능을 달성한다.

상세 분석

ETGPO는 “오류‑분류‑가이드”라는 4단계 파이프라인을 제시한다. 첫 단계인 오류 수집에서는 검증 셋을 K번 반복 실행해 백본 LLM의 stochastic한 특성을 반영하고, 실패한 추론 트레이스를 모두 저장한다. 두 번째 단계인 오류 분류에서는 옵티마이저 LLM을 활용해 배치 단위(B)로 트레이스를 분석하고, “오류가 처음 발생한 위치”, “오류 유형”, “실패 원인” 등을 메타데이터와 함께 새로운 카테고리에 할당한다. 이때 카테고리는 자체 설명과 예시를 포함하도록 설계돼 인간이 이해하기 쉬운 형태를 유지한다.

세 번째 단계인 오류 카테고리 선택에서는 각 카테고리의 문제 수와 실패 횟수를 집계한다. 단일 문제에만 나타나는 희귀 카테고리는 필터링하고, 실패 횟수가 높은 상위 G개(논문에서는 기본값 10)를 선정한다. 이렇게 함으로써 “긴 꼬리” 오류에 과도히 집중하는 것을 방지하고, 전역적인 성능 향상에 기여할 가능성이 높은 오류에만 자원을 집중한다.

마지막 단계인 가이드 생성에서는 옵티마이저 LLM에게 선택된 카테고리별로 구체적인 행동 지침을 작성하도록 요청한다. 지침은 “오류 설명 → 올바른 접근법 → 잘못된 예시와 올바른 예시” 형태로 구성되며, 전체 프롬프트에 삽입될 서문(preamble)도 함께 생성한다. 이 과정은 한 번의 LLM 호출로 모든 카테고리의 가이드를 얻어 토큰 효율성을 극대화한다.

ETGPO의 핵심 혁신은 전역 오류 지형을 명시적으로 모델링한다는 점이다. 기존 피드백‑드리븐 방법들은 미니배치 수준에서 오류를 식별하고 즉시 프롬프트를 수정한다. 이는 특정 샘플에 과적합될 위험이 크고, 반복적인 검증 비용이 많이 든다. 반면 ETGPO는 전체 데이터셋을 한 번에 조망해 가장 흔한 실패 패턴을 추출하고, 그에 대한 고수준 가이드를 제공함으로써 “수술적” 개입을 가능하게 한다.

실험에서는 GPT‑4.1‑mini를 백본 모델, GPT‑4.1을 옵티마이저로 사용해 AIME, HMMT, MMLU‑Pro, Musique, AR‑LSA, FOLIO 등 7개의 베치마크에서 평가했다. 평균 정확도는 69.08%로, 기존 최첨단 방법(GEP A, MIPR Ov2)보다 높으며, 특히 논리 추론 영역에서 69.08%라는 최고 점수를 기록했다. 토큰 사용량 측면에서는 전체 최적화 단계에서 평균 10 K 토큰 이하를 사용해, 다른 방법에 비해 2.5~4.6배 적은 비용을 보였다.

한계점으로는 오류 분류 단계에서 옵티마이저 LLM의 품질에 크게 의존한다는 점과, 카테고리 수 G를 고정하면 매우 복잡한 도메인에서는 중요한 오류가 누락될 가능성이 있다는 점을 들 수 있다. 향후 연구에서는 자동 G 선택, 다중 옵티마이저 앙상블, 그리고 오류 카테고리와 가이드를 메타‑학습으로 축적해 새로운 도메인에 빠르게 전이하는 방법을 탐색할 여지가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기