의료 음성 질문응답을 위한 지식그래프 기반 ASR 오류 교정 프레임워크

초록

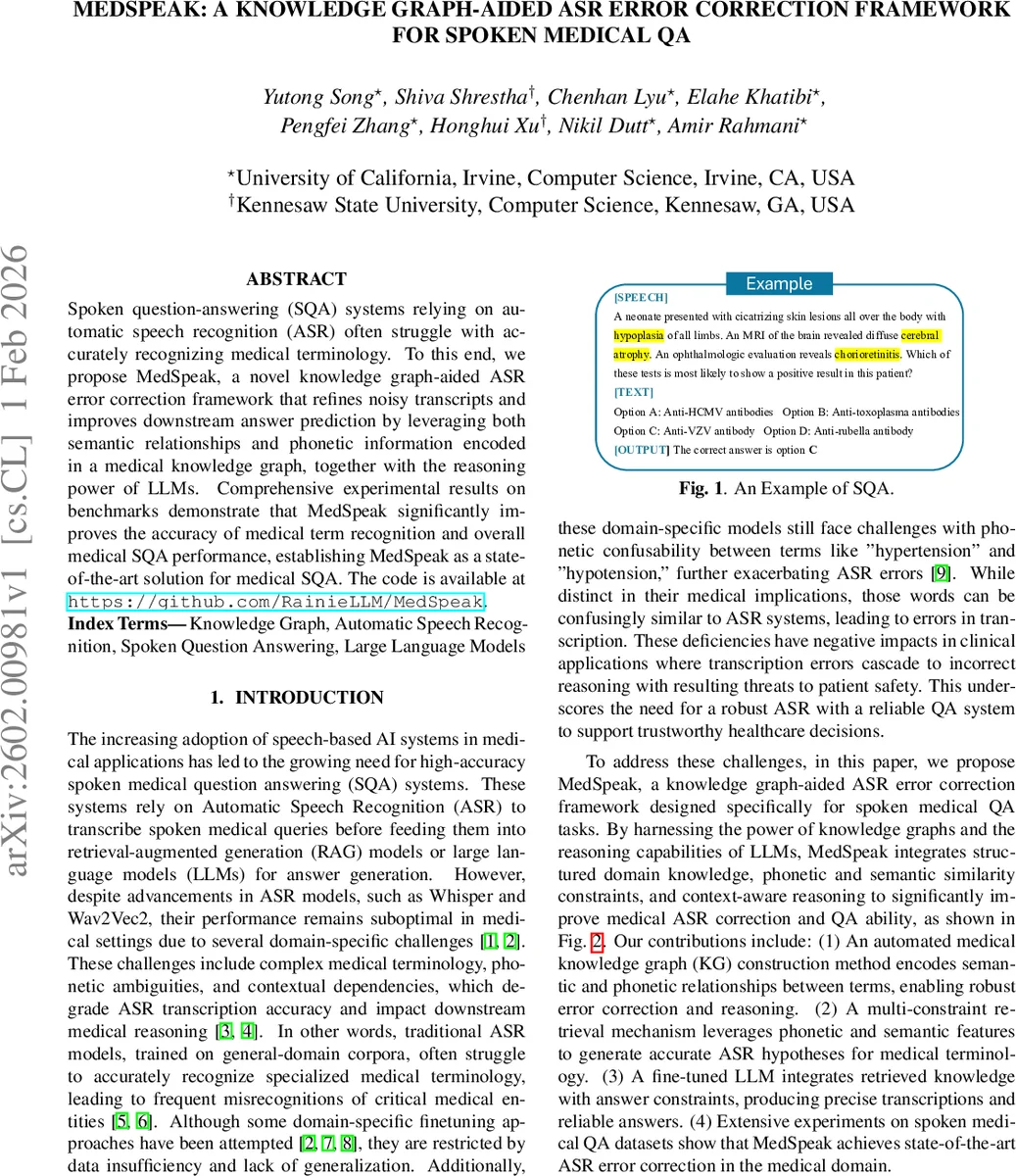

MedSpeak은 의료 분야 전용 지식그래프와 대형 언어모델(LLM)을 결합해 자동음성인식(ASR) 오류를 교정하고, 다중 선택형 의료 질문응답(SQA) 성능을 크게 향상시키는 시스템이다. 의료 용어의 의미적 관계와 음성적 유사성을 동시에 활용해 전처리된 전사본을 정제하고, 정답 선택까지 일관된 두 줄 출력 형식으로 학습한다. 실험 결과, 기존 베이스라인 대비 QA 정확도와 단어 오류율(WER) 모두 현저히 개선되었다.

상세 분석

본 논문은 의료 분야 특유의 복잡한 용어와 발음 유사성 문제를 해결하기 위해 지식그래프(KG)와 LLM을 통합한 새로운 ASR 오류 교정 프레임워크인 MedSpeak을 제안한다. KG는 UMLS의 MRREL 테이블을 기반으로 의미 관계(예: ‘classifies’, ‘constitutes’)와 CMU 발음 사전을 활용한 음성 유사성(Double Metaphone + Levenshtein) 정보를 동시에 포함한다. 이렇게 구축된 KG는 노드에 고유 식별자와 용어 문자열을, 엣지에 의미 및 ‘phonetic’ 태그를 부여해 LLM이 전사 오류를 추론할 때 구조화된 도메인 지식을 활용하도록 설계되었다.

학습 단계에서는 Whisper Small 모델이 생성한 노이즈 전사를 입력으로, 다중 선택형 옵션과 제한된 토큰 수(600 + 300) 내의 KG 컨텍스트를 함께 제공한다. 시스템 프롬프트는 두 줄 출력(‘Corrected Text: …’, ‘Correct Option: …’)을 강제하는 고정 규칙을 포함한다. LLM(Llama‑3.1‑8B‑Instruct)은 전체 대화 형태의 입력에 대해 인과적 언어 모델링 손실을 최소화하도록 미세조정된다. 이 과정에서 전사 교정(t*)과 정답 선택(o*)를 하나의 생성 작업으로 통합함으로써, 전사 오류와 질문‑답변 추론 사이의 상호 의존성을 자연스럽게 학습한다.

추론 시에도 동일한 포맷을 유지해 Whisper가 만든 노이즈 전사와 KG를 결합한 입력을 LLM에 전달하고, 모델은 정제된 전사와 정답 옵션을 동시에 출력한다. 실험에서는 MedMCQA, MedQA, MMLU‑Medical 등 세 가지 공개 의료 QA 데이터셋을 TTS로 음성화해 47시간 이상(≈6.79 M 토큰)의 학습 데이터를 구성하였다. 베이스라인으로는 Whisper만 사용한 Zero‑shot ASR, 전사 없이 LLM만 사용한 Zero‑shot GT, KG 없이 미세조정된 LLM+Whisper, 그리고 정답 전사만 사용한 FT‑LLM을 비교하였다.

결과는 두 가지 주요 지표에서 MedSpeak이 우수함을 보여준다. QA 정확도는 평균 93.4%로 FT‑LLM(92.5%)에 근접하면서도 Whisper 기반 노이즈 전사를 사용한다는 점에서 실용성이 높다. 특히 바이올로지와 MedQA 분야에서 4~5%p 이상의 정확도 향상이 관찰되었다. WER는 29.9%로 Zero‑shot ASR(77.2%)와 FT‑LLM+Whisper(35.8%)에 비해 크게 감소했으며, 이는 의미·음성 KG가 동음이의어와 유사 발음 오류를 효과적으로 구분했음을 의미한다.

전반적으로 MedSpeak은 (1) 의료 전용 KG 구축 방법, (2) 의미·음성 복합 검색 메커니즘, (3) 두 줄 출력 형식의 통합 학습 전략이라는 세 축을 통해 기존 ASR‑QA 파이프라인의 약점을 보완한다. 또한 KG와 LLM의 결합이 도메인 특화 오류 교정에 얼마나 강력한 시너지를 발휘할 수 있는지를 실증적으로 제시한다. 향후 실제 임상 환경에서 실시간 음성 입력을 처리하거나, 다른 전문 분야(예: 법률, 금융)로 확장하는 연구가 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기