단일 실세계 데모로 확장 가능한 양팔 조작 데이터 합성

초록

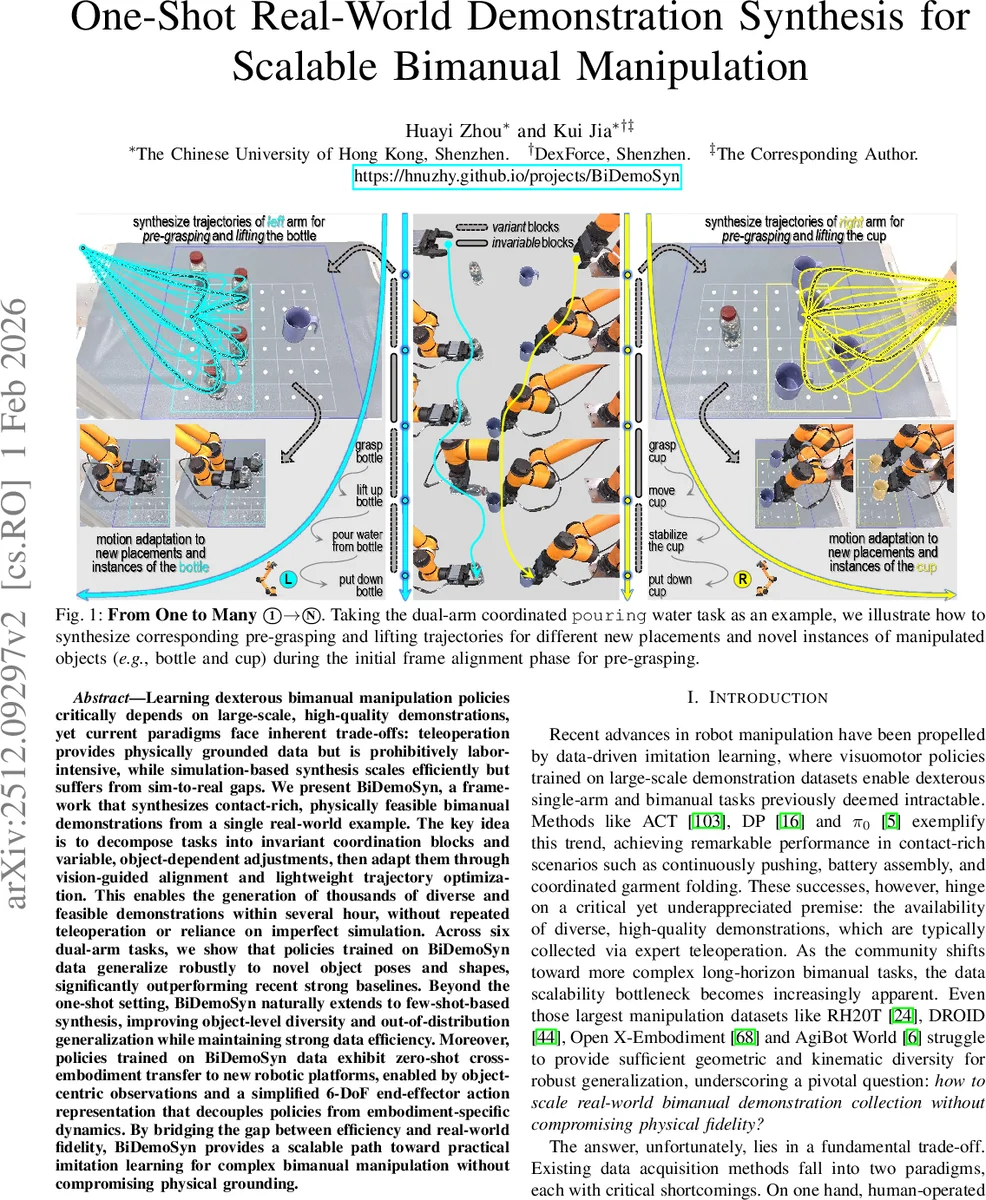

BiDemoSyn은 하나의 실제 데모만으로 수천 개의 다양한 양팔 조작 데모를 합성하는 프레임워크입니다. 작업을 불변 조정 블록과 가변 객체 의존 블록으로 분해한 후, 시각 기반 정렬과 가벼운 궤적 최적화를 통해 새로운 객체 위치와 형태에 적응시킵니다. 시뮬레이션에 의존하지 않고 실제 물리적 제약을 준수하는 데이터를 대량 생성함으로써, 정책의 강건한 일반화와 심지어 다른 로봇 플랫폼으로의 제로샷 전이를 가능하게 합니다.

상세 분석

본 논문이 제안하는 BiDemoSyn 프레임워크의 기술적 핵심은 ‘단일 데모의 계층적 분해 및 상황 적응적 재합성’에 있습니다. 기존 방법들이 가진 데이터 수집의 품질(실제 기반)과 규모(자동화) 간의 트레이드오프를 해결하기 위해, 실제 물리 세계에서 직접 데이터를 증강하는 방식을 채택했습니다.

핵심 메커니즘은 세 단계로 구성됩니다. 첫째, 작업 분해(Deconstruction) 단계에서는 주어진 하나의 데모 궤적을 ‘불변 블록’과 ‘가변 블록’으로 분류합니다. 불변 블록은 회전, 누르기 등 작업의 의미론적 핵심이 담긴 동작 프리미티브로, 다양한 상황에서 구조가 유지됩니다. 가변 블록은 객체의 위치나 형상에 따라 조정이 필요한 부분(예: 파지 접근 동작)으로 정의됩니다. 이를 보다 세분화된 ‘원자 실행 프리미티브(AEP)’ 단위로 정제하여 모듈화된 적응을 가능하게 합니다.

둘째, 시각 기반 초기 프레임 정렬(Alignment) 단계에서는 새로운 장면에서 가변 블록을 적응시키기 위해 객체 인식과 상태 추정을 수행합니다. 복잡한 CAD 기반 6D 자세 추정 대신 객체 마스크의 기하학적 모멘트와 PCA를 활용하여 강건하게 객체의 중심과 방향을 추정합니다. 이를 통해 원본 데모의 객체와 새로운 장면의 객체 간 강체 변환을 계산, 파지 포인트 등을 자동으로 정렬합니다.

셋째, 궤적 변조 및 최적화(Optimization) 단계에서는 정렬된 궤적이 실제 로봇의 운동학적, 동역학적 제약(충돌 회피, 양팔 협조)을 만족하도록 보정합니다. 이는 경량의 물리 인지 궤적 최적화를 통해 이루어지며, 시뮬레이션 엔진 없이도 물리적 타당성을 보장합니다.

이 방법론의 강점은 다음과 같습니다. 1) 실세계 충실도: 시뮬레이션의 비현실적인 물리나 렌더링 격차 없이, 실제 로봇 플랫폼에서 수집된 데이터의 물리적 정확성을 유지한 채 다양성을 증강합니다. 2) 정책 디커플링: 객체 중심 관측(예: 점군)과 단순화된 6-DoF 엔드 이펙터 액션 표현을 사용함으로써, 학습된 정책이 특정 로봇 역학(엠보디먼트)에 얽매이지 않아 제로샷 크로스-엠보디먼트 전이가 가능해집니다. 3) 확장성: 단일 샷에서 퓨샷(몇 개의 데모)으로 자연스럽게 확장되어 객체 수준의 다양성을 더욱 향상시키고 분포 외 일반화를 강화할 수 있습니다.

이는 단순한 궤적 편집을 넘어, 작업의 의미론적 구조를 이해하고 이를 새로운 기하학적 문맥에 맞춰 재구성하는 ‘알고리즘적 확산’을 구현했다는 점에서 의미가 깊습니다. 결과적으로, 적은 비용으로 생성된 데이터로 학습된 정책은 다양한 객체 포즈와 형상에 대해 높은 일반화 성능을 보였으며, 복잡한 접촉이 수반되는 양팔 조작 작업에 대한 실용적 모방 학습의 확장 가능한 경로를 제시합니다.

댓글 및 학술 토론

Loading comments...

의견 남기기