접속사로 배우는 언어 모델의 세계

초록

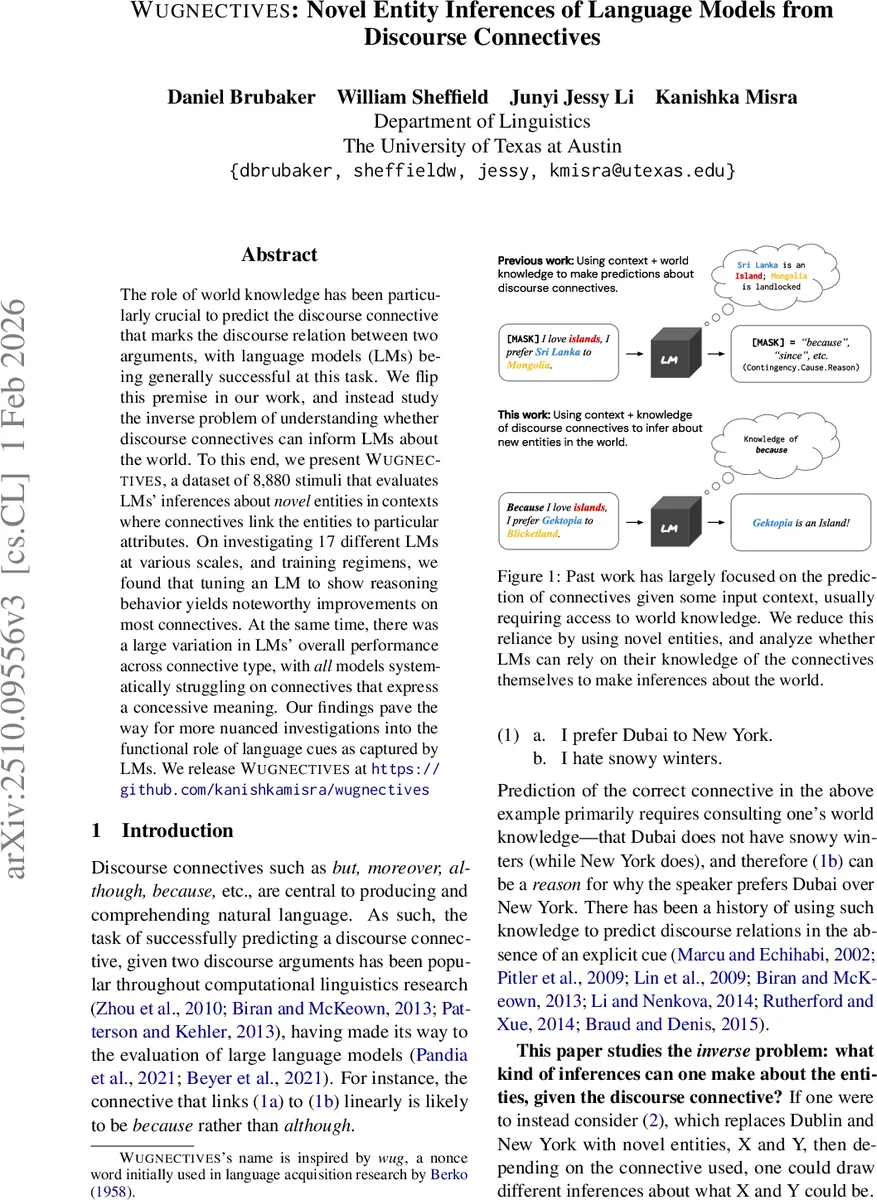

언어 모델이 담화 접속사(예: 하지만, 왜냐하면)를 통해 새로운 가상 개체에 대한 속성을 추론할 수 있는지 평가한 연구입니다. ‘WUGNECTIVES’라는 8,880개의 자극으로 구성된 데이터셋을 개발하고, 17개의 다양한 언어 모델을 테스트한 결과, 추론 능력을 강화한 모델이 대부분의 접속사 유형에서 성능이 향상되었지만, ‘비록’, ‘그럼에도 불구하고’와 같은 양보적 접속사에서는 모든 모델이 체계적으로 어려움을 겪었습니다.

상세 분석

본 연구는 언어 모델(LM)의 의미론적 이해를 평가하는 기존 패러다임을 전환한 점에서 중요한 기여를 합니다. 기존 연구가 세계 지식(World Knowledge)을 바탕으로 적절한 담화 접속사를 예측하는 데 초점을 맞췄다면, 이 연구는 그 반대 과정, 즉 주어진 접속사가 언어 모델로 하여금 새로운 엔터티(가상의 단어)에 대한 세계 지식을 어떻게 형성하게 하는지를 탐구합니다.

핵심 방법론은 ‘WUGNECTIVES’ 데이터셋 설계에 있습니다. 연구자들은 ‘wug’, ‘dax’와 같은 비단어(nonce word)를 사용하여 모델의 사전 지식 영향을 배제하고, 순수하게 접속사의 기능적 의미에 기반한 추론 능력만을 측정하고자 했습니다. 데이터셋은 크게 세 가지 유형(실체화, 선호도, 시간적 관계)의 추론을 테스트하며, PDTB(Penn Discourse Treebank) 체계를 참조하여 총 41개의 접속사 형태를 7개의 의미 관계에 걸쳐 체계적으로 포함했습니다.

주요 실험 결과에서 나타난 통찰은 다음과 같습니다. 첫째, 모델 규모(파라미터 수)나 지시 튜닝(Instruction Tuning)보다는 ‘추론 기반 튜닝’(Reasoning-based Tuning, Guo et al., 2025 방식)이 접속사 이해 전반에 걸쳐 가장 뚜렷한 성능 향상을 가져왔습니다. 이는 언어 모델의 담화 이해 능력을 높이기 위해서는 단순한 지식 주입보다 논리적 추론 구조를 명시적으로 가르치는 것이 중요할 수 있음을 시사합니다.

둘째, 가장 주목할 만한 발견은 모든 모델이 ‘Comparison.Concession’(예: although, even though, despite that) 관계를 표현하는 접속사에서 지속적으로 낮은 성능(거의 무작위 수준)을 보였다는 점입니다. 이는 양보 관계가 단순한 인과 관계 부정을 넘어서는 복잡한 화용론적 기대와 배경 지리적 추론을 포함하기 때문으로 해석됩니다. 흥미롭게도, 이러한 실패는 접속사의 코퍼스 출현 빈도와는 상관관계가 없었으며, 이는 모델이 언어 통계적 패턴 이상의 추상적 의미 관계를 포착하는 데 본질적인 한계가 있을 수 있음을 지적합니다.

마지막으로, 후속 실험에서 가상 개체를 실제 세계 개체(예: ‘두바이’, ‘뉴욕’)로 대체했을 때 모델 성능이 전반적으로 크게 향상되었지만, 양보 접속사 관련 성능 향상폭은 가장 작았습니다. 이는 모델이 양보 접속사의 의미를 이해하기 위해서는 단순한 사실 지식보다 더 추상적이고 관계적인 추론이 필요하며, 이는 현재 언어 모델의 취약점임을 재확인시켜 줍니다.

종합하면, 이 연구는 언어 모델 평가에 있어 ‘접속사’라는 구체적이고 기능적인 언어 단서에 주목함으로써, 모델의 내재적 의미 표현과 추론 메커니즘을 더욱 미세하게 진단할 수 있는 길을 열었다는 점에서 의의가 큽니다.

댓글 및 학술 토론

Loading comments...

의견 남기기