추론 연산을 교사로 활용한 무라벨 강화학습

초록

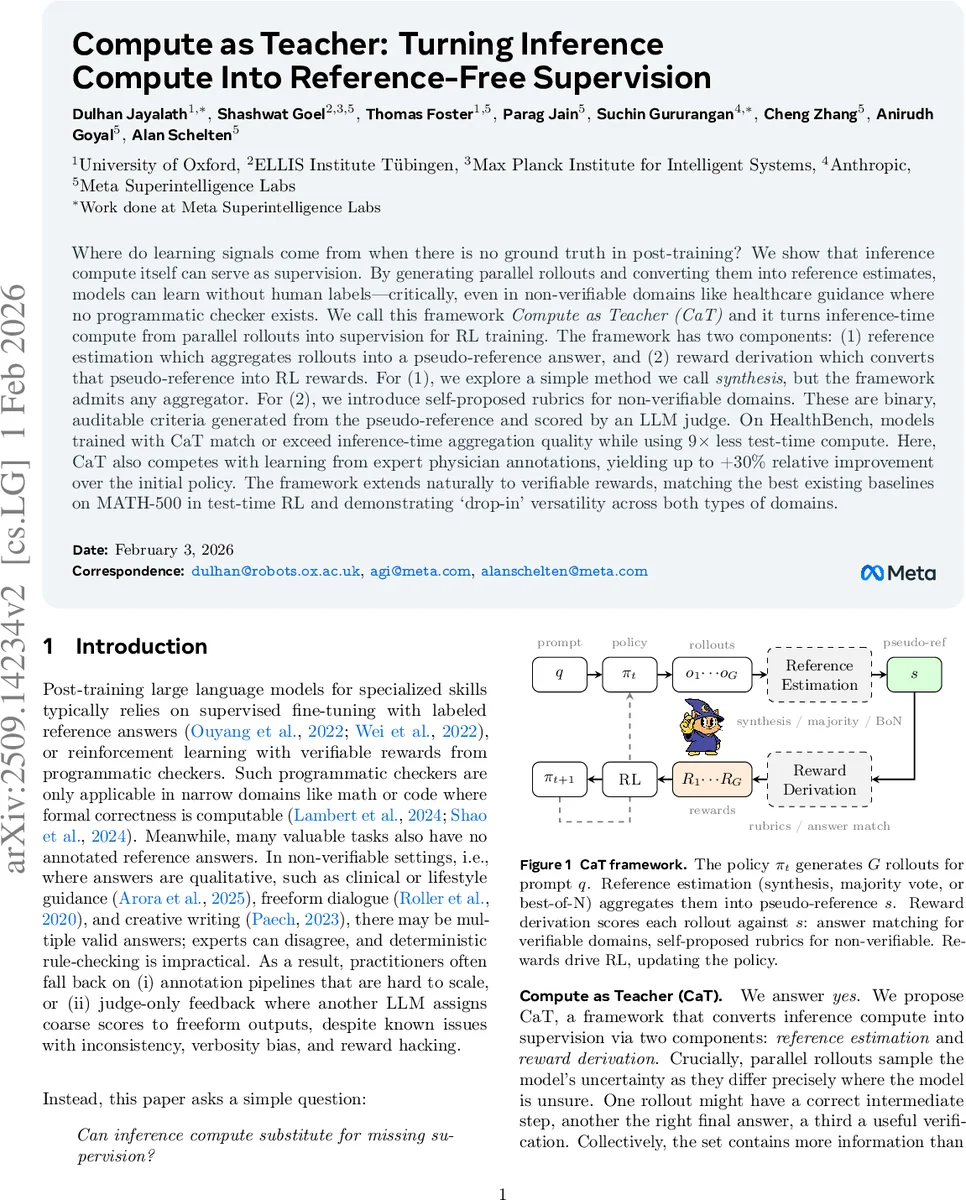

본 논문은 대규모 언어 모델이 사후 학습 단계에서 인간 라벨이 없을 때, 동일 프롬프트에 대해 여러 번 추론한 결과(롤아웃)를 집계해 가짜 레퍼런스를 만들고, 이를 기준으로 자체 생성 루브릭을 이용해 보상 신호를 생성함으로써 강화학습(RL)을 수행하는 프레임워크 “Compute as Teacher (CaT)”를 제안한다. 검증 가능한 수학·코드 도메인과 검증 불가능한 의료·생활 가이드 도메인 모두에서 기존 방법을 능가하거나 동등한 성능을 보이며, 테스트 시 연산 비용을 최대 9배 절감한다.

상세 분석

CaT는 “참조 추정(reference estimation)”과 “보상 도출(reward derivation)”이라는 두 핵심 모듈로 구성된다. 첫 번째 모듈에서는 현재 정책 πₜ가 동일 프롬프트 q에 대해 G개의 병렬 롤아웃 o₁:ᴳ을 생성한다. 이 롤아웃들은 모델의 불확실성을 반영하므로 서로 다른 정답 후보와 중간 단계 정보를 포함한다. 롤아웃 집계 방법은 크게 선택 기반(다수결, best‑of‑N)과 생성 기반(‘synthesis’)으로 나뉜다. 선택 기반은 기존의 테스트‑타임 스케일링 기법과 동일하지만, 최종 정책에 반영되지 않아 추론 비용이 지속된다. 반면 synthesis는 고정된 앵커 모델 π₀(초기 정책)를 프롬프트 p_syn에 따라 롤아웃 집합을 입력으로 받아 새로운 응답 s를 생성한다. 이 과정은 서로 다른 롤아웃의 유용한 조각을 결합해 인간이 직접 만든 레퍼런스보다 질적으로 우수한 ‘가짜 레퍼런스’를 만들 수 있다. 논문에서는 π₀를 현재 정책과 분리함으로써 탐색과 레퍼런스 추정이 상호 간섭하지 않도록 설계하였다.

두 번째 모듈인 보상 도출은 도메인에 따라 두 가지 경로를 가진다. 검증 가능한 수학·코드와 같이 정답이 프로그램적으로 확인 가능한 경우, 롤아웃 o와 가짜 레퍼런스 s의 정답 문자열을 직접 비교해 0/1 보상을 부여한다. 이는 보상 설계가 단순해 학습 안정성을 높인다. 반면 검증 불가능한 의료·생활 가이드와 같은 영역에서는 직접적인 정답 검증이 불가능하므로, ‘self‑proposed rubrics’를 도입한다. 앵커 π₀가 가짜 레퍼런스 s로부터 n≥5개의 이진 기준 r₁…rₙ을 생성하고, 독립적인 판단자 모델 π_J가 각 롤아웃 o가 해당 기준을 만족하는지를 평가한다. 최종 보상은 만족한 기준의 비율(∑ₙ 1

댓글 및 학술 토론

Loading comments...

의견 남기기