다중 홉 추론을 위한 대규모 시각 질문 답변 벤치마크 ReasonVQA

초록

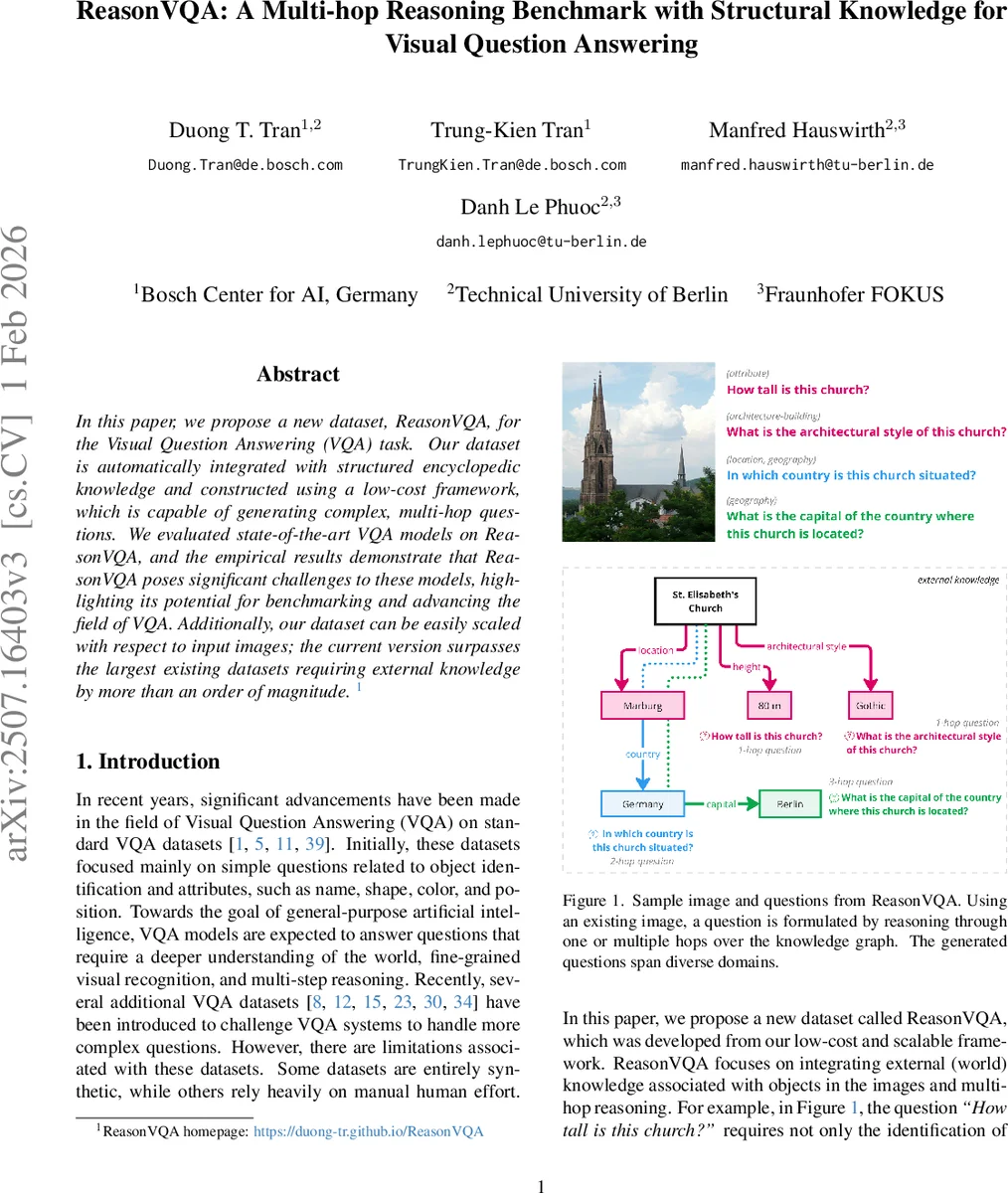

ReasonVQA는 이미지와 외부 구조화 지식을 결합해 1~3 홉의 복합 질문을 자동 생성하는 대규모 VQA 데이터셋이다. 4.2 백만 개 이상의 질문과 598 천 장 이상의 이미지를 포함하며, 기존 외부 지식 기반 VQA 데이터셋보다 10배 이상 규모가 크다. 베이스라인 모델들을 평가한 결과, 현재 최첨단 VQA 모델조차도 높은 정확도를 보이지 않아 데이터셋의 난이도가 충분히 높음을 확인했다.

상세 분석

본 논문은 VQA 분야에서 외부 지식 활용과 다중 홉 추론을 동시에 평가할 수 있는 벤치마크를 제시한다는 점에서 의미가 크다. 먼저 데이터 구축 파이프라인은 세 단계로 구성된다. (1) 외부 지식 통합 단계에서는 이미지에 존재하는 객체를 Visual Genome의 객체 라벨과 WordNet synset을 매핑한 뒤, Wikidata의 엔티티와 SPARQL 질의를 통해 구조화된 사실을 가져온다. 이때 Google Landmark Dataset v2를 추가로 활용해 랜드마크 이미지와 연계된 지식도 확보한다. (2) 질문 생성 단계는 템플릿 기반으로 설계되었으며, 1‑hop 질문은 “<속성>은 무엇인가?” 형태의 단일 템플릿으로 생성하고, 2‑hop·3‑hop 질문은 1‑hop 템플릿에 서브클라우즈(예: “<관계>의 <속성>은?”)를 중첩시켜 만든다. 템플릿은 수동으로 정의했지만, 속성·관계 종류에 따라 자동으로 변형되도록 설계돼 언어 다양성을 확보한다. (3) 데이터셋 구축 단계에서는 답변 분포를 균형 있게 만들기 위해 GQA에서 차용한 “head‑tail” 정규화 방식을 적용한다. 답변 빈도가 높은 항목을 의도적으로 제거하고, 이미지당 질문 수를 균등화함으로써 편향을 최소화한다.

데이터 규모는 598 K 이미지와 4.2 M 질문으로, 기존 OK‑VQA(14 K)나 KVQA(≈100 K)와 비교해 두 자릿수 이상 큰 규모다. 질문은 1‑hop(≈45 %), 2‑hop(≈35 %), 3‑hop(≈20 %) 비율로 구성돼 다중 홉 추론 능력을 정량화한다. 또한 20개의 도메인(인물, 건축, 역사 등)으로 라벨링해 분야별 성능 분석이 가능하도록 했다.

베이스라인 실험에서는 LXMERT, ViLT, Flamingo 등 최신 멀티모달 모델과 GPT‑4 기반 프롬프트 엔지니어링을 적용했지만, 최고 정확도조차 30 % 이하에 머물렀다. 특히 다중 홉 질문에서 성능 격차가 크게 나타났으며, 외부 지식 검색 단계와 이미지‑텍스트 정합성 판단이 병목임을 시사한다. 이는 현재 모델들이 “지식 인출”보다 “시각‑언어 결합”에 초점을 맞추고 있음을 반영한다.

이 논문의 주요 기여는 (1) 대규모·저비용 자동 생성 파이프라인을 제시해 향후 도메인 확장이 용이하도록 한 점, (2) 답변 편향을 체계적으로 완화한 데이터셋 설계, (3) 다중 홉 추론 능력을 정량화할 수 있는 평가 기준을 제공한 점이다. 향후 연구는 (a) 동적 지식 그래프 탐색을 모델에 통합해 추론 경로를 학습하도록 하는 방법, (b) 생성형 LLM과 비전 트랜스포머를 결합해 “검색‑생성” 파이프라인을 구축하는 방향이 유망하다.

댓글 및 학술 토론

Loading comments...

의견 남기기