GAN과 베이지안 신경망을 잇는 부분적 확률성

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

본 논문은 GAN을 파라미터가 결정적인 부분과 잠재 변수 z만이 확률적인 ‘부분적 확률성’ 베이지안 신경망으로 재해석한다. 이를 통해 GAN의 목표를 잠재 변수를 적분한 마진 우도(또는 KL 발산)의 샘플 기반 프록시로 표현하고, 정규화·플랫 최소점 탐색·베이지안 근사(드롭아웃) 등 세 가지 전략이 일반화와 성능을 크게 향상시킴을 실험적으로 입증한다.

상세 분석

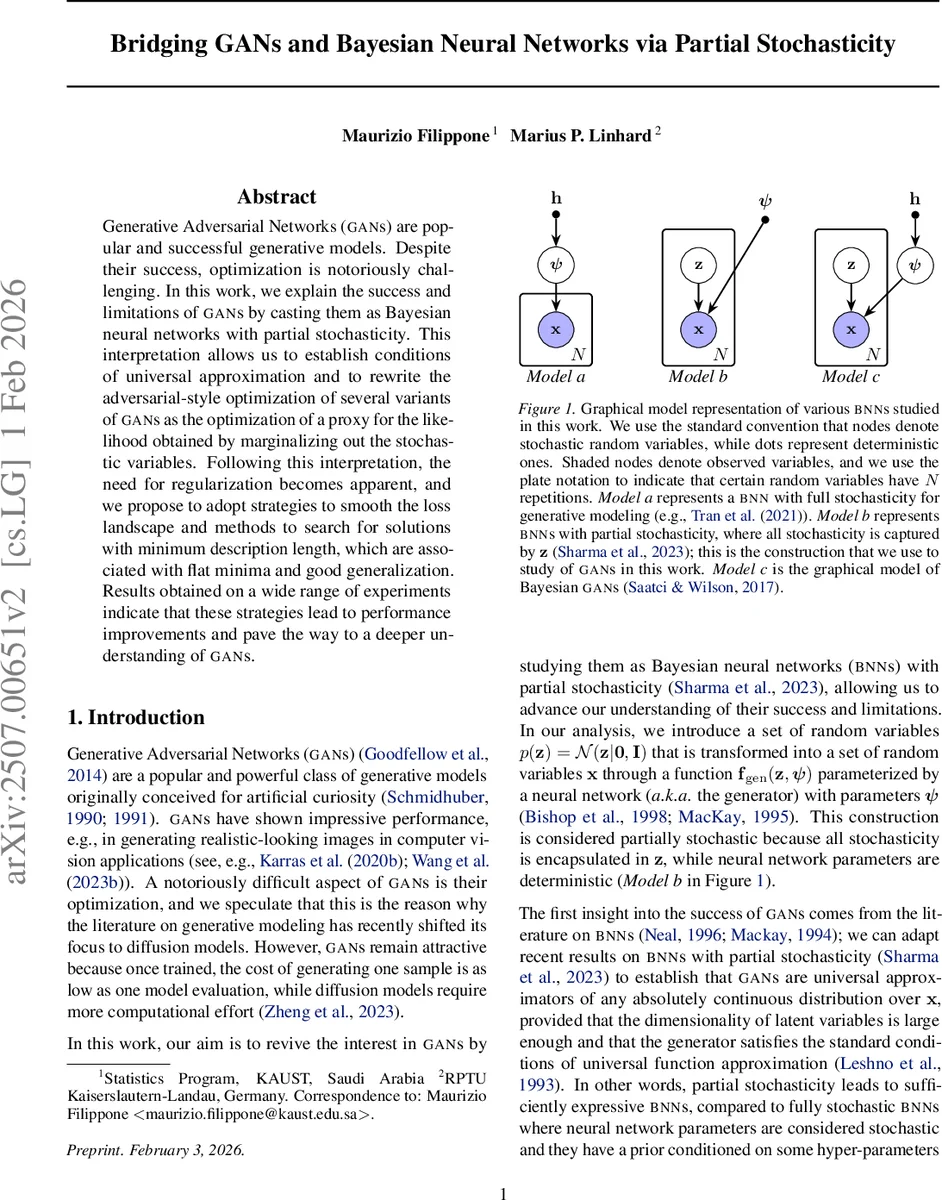

논문은 먼저 GAN의 생성기 f_gen(z,ψ)를 확률적 입력 z∈ℝ^P와 결정적 파라미터 ψ로 구성된 베이지안 신경망(BNN)으로 모델링한다. 이때 z만이 확률적이며, ψ는 최적화 대상이 되는 ‘부분적 확률성’ 구조(Model b)이다. 이러한 설정은 기존 완전 확률적 BNN(Model a)보다 파라미터 공간을 축소하면서도, 잠재 차원 P가 데이터 차원 D보다 크면 모든 절대 연속 분포를 근사할 수 있다는 보편 근사 정리를 그대로 적용한다(Neal, 1996; Leshno et al., 1993).

다음으로 마진 우도 p(X|ψ)=∫p(X|Z,ψ)p(Z)dZ를 직접 최적화하는 것이 불가능함을 지적하고, 이를 KL

댓글 및 학술 토론

Loading comments...

의견 남기기