텍스트 속 갈등: 데이터, 영향 및 해결 과제

초록

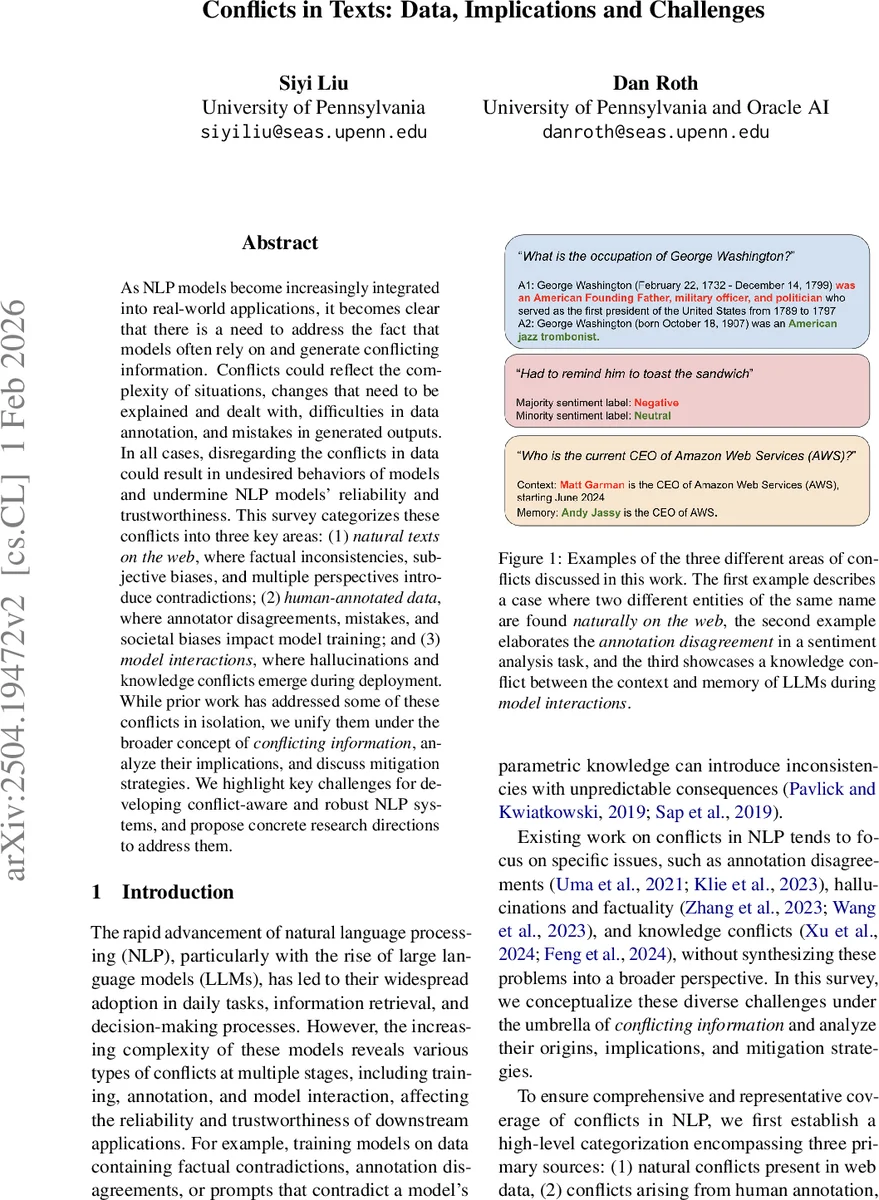

본 설문은 웹 텍스트, 인간 주석, 모델 상호작용에서 발생하는 갈등을 세 가지 범주로 정리하고, 각각의 발생 원인·영향·완화 방안을 종합적으로 분석한다. 갈등을 무시하면 모델 신뢰성이 저하되므로, 갈등 인식·조정 능력을 갖춘 NLP 시스템 구축이 필요함을 강조한다.

상세 분석

이 논문은 최근 대형 언어 모델(LLM)의 급격한 확산과 함께 나타나는 “갈등(conflict)” 현상을 체계적으로 조명한다. 먼저 갈등을 자연 웹 텍스트, 인간 주석, 모델 상호작용이라는 세 축으로 구분하고, 각 축마다 구체적인 서브카테고리를 제시한다. 웹 텍스트에서는 사실적 모순, 의견·시각 차이, 프레이밍 편향 등으로 나뉘며, 특히 시간·지역에 따라 달라지는 질문(예: 코로나 백신 승인 시점)이나 동일 이름 엔터티가 서로 다른 실체를 가리키는 경우가 대표적이다. 이러한 사실적 갈등은 AmbigQA, SituatedQA, WhoQA와 같은 데이터셋을 통해 정량화되고, 모델이 컨텍스트를 정확히 파악하지 못하면 정답률이 인간 수준 이하로 급락한다는 실험적 증거가 제시된다.

인간 주석 영역에서는 라벨 불일치와 사회적 편향이 핵심 갈등 요인이다. 감성 분석, 혐오 발언 탐지, 자연어 추론(NLI) 등에서 다수의 연구가 높은 어노테이터 불일치를 보고했으며, 다수결 라벨링이 모호하거나 논쟁적인 사례를 “노이즈”로 오인하게 만든다. 또한 인종·성별·지리적 편향이 데이터에 내재하면 학습된 모델이 특정 집단에 불리한 예측을 반복한다는 점을 강조한다.

모델 상호작용 단계에서는 파라메트릭 메모리와 외부 컨텍스트 간의 지식 충돌, 그리고 사실·맥락적 환각이 두드러진다. Longpre et al.이 제시한 “지식 충돌” 현상은 모델이 내부에 저장한 사실과 입력 문서가 상충할 때 발생하며, 이는 확인 편향(confirmation bias)으로 이어져 잘못된 정보를 강화한다. 환각 문제는 사실적 환각과 맥락적 환각으로 구분되며, 각각 지식 그래프 기반 검증, 검색 증강, 환각 탐지 모델 등으로 완화하려는 시도가 진행 중이다.

논문은 각 갈등 유형에 대한 완화 전략을 체계적으로 정리한다. 사실적 갈등에는 “불확실성 추정 → 선택적 포기(abstention)”, “시간 인식 모델”, “디스앰비규에이션 파이프라인” 등이 제안된다. 의견 갈등에서는 관점 클러스터링 기반 검색, 다중 관점 요약, 사용자 개인화 컨텍스트 활용이 주요 방법이다. 주석 갈등은 다중 라벨 학습, 라벨 불확실성 모델링, 공정성 보정 기법으로 대응한다. 모델 상호작용 갈등은 파라메트릭·컨텍스추얼 지식 분리, 환각 검출기, 외부 검증용 지식 그래프 통합 등으로 완화한다.

전체적으로 논문은 갈등을 단일 현상이 아니라 데이터·주석·모델 전 단계에 걸친 복합 현상으로 보고, 이를 통합적으로 다루는 “갈등 인식(conflict‑aware)” 프레임워크의 필요성을 역설한다. 향후 연구는 (1) 갈등 자동 탐지와 정량화, (2) 갈등 기반 학습 목표 설계, (3) 인간‑모델 협업을 통한 갈등 해결 메커니즘 구축에 초점을 맞춰야 한다고 제언한다.

댓글 및 학술 토론

Loading comments...

의견 남기기