계층적 테일러 전개 기반 연속 학습으로 작업 순서 민감도와 망각 최소화

초록

**

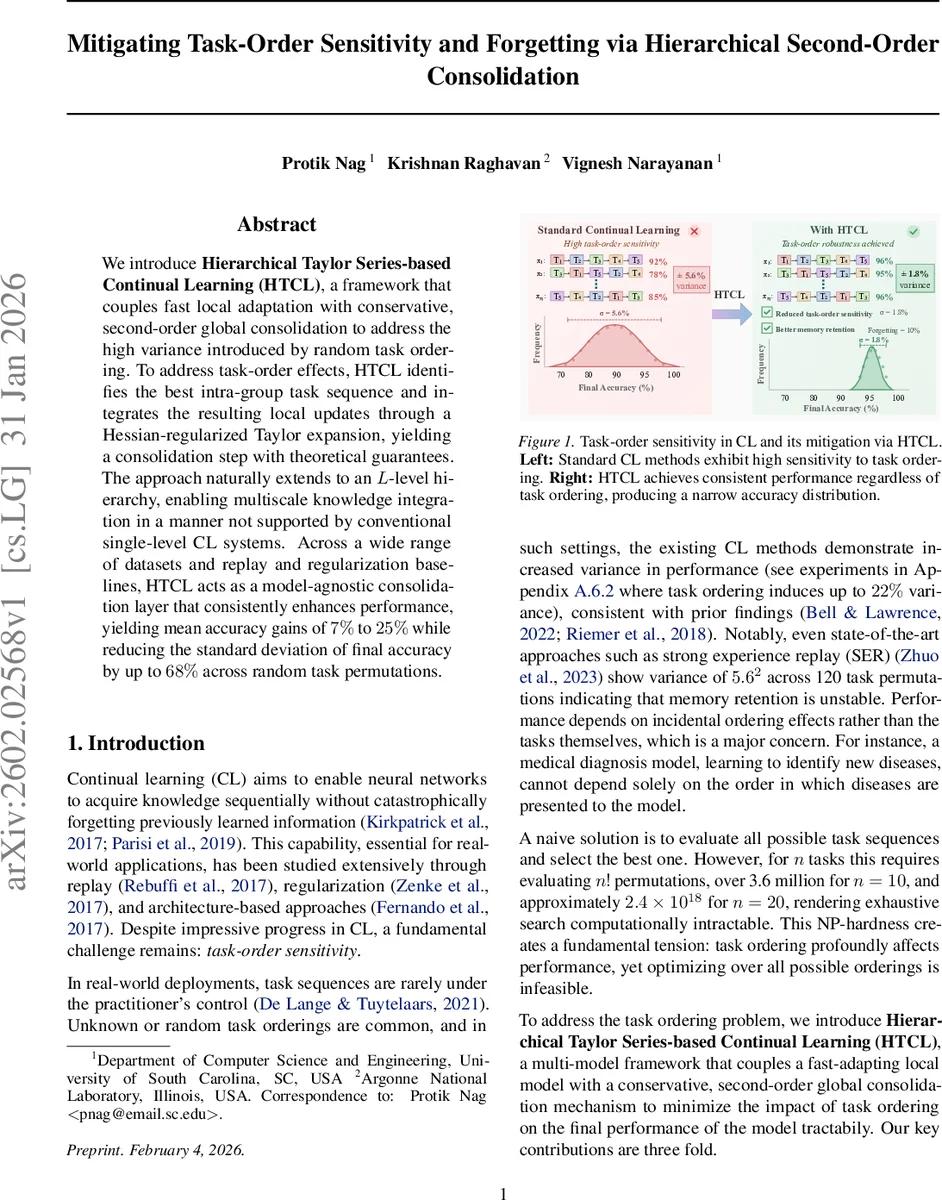

HTCL은 작업을 작은 그룹으로 나누고 각 그룹 내에서 최적의 순서를 탐색한 뒤, 헤시안‑정규화 테일러 전개를 이용해 전역 파라미터를 두 번째 차수로 통합한다. 다중 레벨 계층 구조를 통해 최근 작업은 빠르게 적응하고, 오래된 지식은 안정적으로 보존한다. 실험 결과, 기존 CL 방법 대비 평균 정확도가 7 %–25 % 상승하고, 무작위 순서에 따른 성능 편차가 최대 68 % 감소하였다.

**

상세 분석

**

본 논문은 연속 학습(Continual Learning, CL)에서 가장 심각한 문제 중 하나인 “작업 순서 민감도(task‑order sensitivity)”를 해결하기 위해 새로운 프레임워크인 HTCL(Hierarchical Taylor Series‑based Continual Learning)을 제안한다. 핵심 아이디어는 전체 작업을 크기 k인 여러 그룹으로 분할하고, 각 그룹 내에서 *k!*개의 가능한 순서를 모두 평가해 가장 좋은 순서를 선택함으로써 그룹 수준에서는 순서 불변성을 확보한다(정리 A.3). 이렇게 하면 전체 *t!*개의 순열을 탐색해야 하는 NP‑hard 문제를 m·k!(m은 그룹 수) 수준으로 축소할 수 있다.

그 후, 그룹별 로컬 모델 wₗ이 얻은 최적 파라미터를 전역(또는 상위 계층) 모델 w₁, w₂, …, w_L에 통합한다. 단순 평균이나 직접 교체와 달리, 저자는 헤시안‑정규화된 2차 테일러 전개를 이용해 손실 함수 *J(w)*의 1차·2차 정보를 활용한다. 구체적으로 현재 계층 모델의 그래디언트 g와 헤시안 H를 근사하고, 업데이트 Δw를

J(w₁⁻ + Δw) ≈ J(w₁⁻) + gᵀΔw + ½ΔwᵀHΔw

와 같은 2차 형식으로 최소화한다. 이때 Δw는 로컬 모델 wₗ와의 거리 제약을 포함해, 파라미터 공간에서 손실이 급격히 증가하는 민감한 방향을 억제하고, 손실이 완만한 방향에서는 자유롭게 이동하도록 설계된다. 실용성을 위해 저자는 저‑랭크 곱셈 근사(Fisher 정보 기반)와 같은 스케일러블 기법을 적용해 메모리·시간 복잡도를 거의 선형 수준으로 유지한다.

또한, HTCL은 단일 계층이 아니라 L‑레벨 계층 구조를 지원한다. 하위 레벨은 최신 작업에 대한 높은 플라스티시티를 제공하고, 상위 레벨은 점진적으로 더 큰 시간 스케일에서 지식을 통합한다. 이렇게 하면 장기적인 작업 흐름에서도 순서에 대한 민감도가 점차 감소한다.

실험에서는 SplitMNIST, CIFAR‑100, CORA(그래프), 20 Newsgroups(텍스트) 등 다양한 도메인에 기존 Replay(ER, DER, SER 등) 및 정규화( EWC, SI 등) 방법을 HTCL에 삽입해 비교하였다. 결과는 평균 정확도가 7 %–25 % 향상될 뿐 아니라, 무작위 순서에 따른 최종 정확도 표준편차가 33 %–68 % 감소함을 보여준다. 특히, 두 레벨 계층(HTCL‑L2)에서는 SER+HTCL‑L2가 67.86 %의 분산 감소를 기록했다. 이는 “작업 순서에 의존하지 않는 안정적인 학습”을 실현한다는 점에서 의미가 크다.

이론적 측면에서는 정리 A.3을 통해 그룹 내 최적 순서 선택이 전체 기대 손실의 하한을 보장한다는 점을 증명하고, 2차 테일러 전개 기반 업데이트가 기존 1차 정규화 방법보다 더 강력한 보존성을 제공함을 보인다. 또한, 저‑랭크 헤시안 근사는 대규모 신경망에도 적용 가능하도록 설계돼, 모델‑불변(consolidation layer)이라는 장점을 갖는다.

요약하면, HTCL은 (1) 작업 순서 최적화를 그룹 단위로 tractable하게 수행, (2) 2차 테일러 전개와 헤시안 정규화를 통한 정교한 파라미터 통합, (3) 다중 레벨 계층을 통한 플라스티시티와 안정성의 균형이라는 세 축을 결합해 기존 CL 방법의 근본적인 한계를 극복한다.

**

댓글 및 학술 토론

Loading comments...

의견 남기기