VVLoc: 사전‑없는 3자유도 차량 시각 위치추정

초록

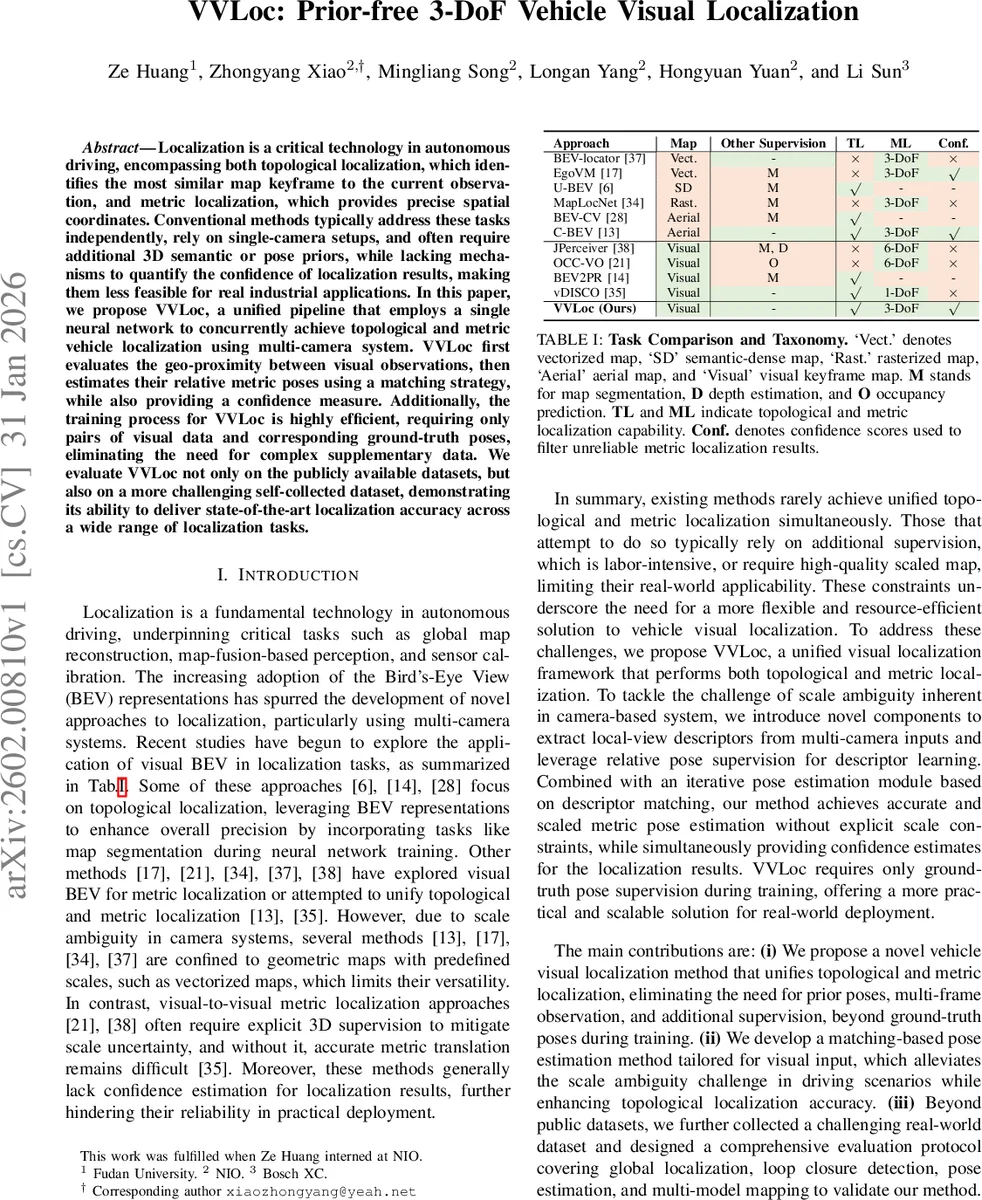

VVLoc은 멀티카메라 영상을 입력으로, 하나의 신경망으로 토폴로지(키프레임 매칭)와 메트릭(3‑DoF 상대 자세) 위치추정을 동시에 수행한다. 지도와 현재 프레임 사이의 지리적 근접성을 판단하고, 베드(BEV) 쿼리를 이용한 매칭으로 상대 자세와 신뢰도 점수를 출력한다. 학습은 이미지 쌍과 GT 포즈만 필요해 데이터 준비가 간단하며, 공개 데이터와 자체 수집한 복잡한 데이터셋 모두에서 최첨단 정확도를 달성한다.

상세 분석

VVLoc은 기존 차량 시각 위치추정 연구가 가지고 있던 “토폴로지와 메트릭을 별도 모델로 처리”, “단일 카메라에 의존”, “3‑D 지도·스케일 사전 정보 필요”라는 한계를 동시에 해소한다. 핵심 아이디어는 멀티카메라 입력을 BEVformer와 동일한 구조로 BEV(위에서 본) 공간에 투사한 뒤, 두 단계의 디코더를 통해 전역(Global)와 지역(Local) 디스크립터를 생성하는 것이다.

-

BEV 인코더 – 다중 카메라 이미지를 3‑D 공간에 투사해 H×W×C 형태의 BEV 쿼리를 만든다. 각 그리드 셀은 실제 차량 좌표계에서 g 미터에 해당한다.

-

전역 디스크립터 디코더(토폴로지) – BEV 쿼리를 극좌표(θ, r) 형태로 변환해 차원 축소 후 풀링하여 1‑D 글로벌 벡터를 만든다. L2 거리 기반 최근접 검색으로 후보 키프레임을 선정하고, 매칭 비용을 재정렬해 최종 토폴로지 매칭을 수행한다.

-

지역 디스크립터 디코더(메트릭) – 극좌표 BEV 쿼리를 각 θ 슬라이스마다 반경 차원을 압축해 T×C 형태의 로컬 뷰 디스크립터를 만든다. 여기서 두 가지 novel attention 모듈이 핵심 역할을 한다.

- Radius‑aware Self‑Attention (RASA): 거리‑감지 임베딩 rᵢⱼᵈ를 키‑쿼리 내적에 추가해 반경 기반 위치 정보를 강화한다. 이는 전통적인 self‑attention이 순수히 채널 관계만 학습하는 한계를 극복한다.

- Theta‑aware Self‑Attention: 각 디스크립터 간 각도 차이 θᵢⱼ를 임베딩으로 삽입해 회전(요) 정보를 명시적으로 학습한다.

두 디스크립터는 다중 헤드 크로스‑어텐션(MHCA)으로 상호작용한 뒤 정규화된다.

-

요(회전) 추정 – 회전은 디스크립터를 원형으로 롤링(보간 포함)하면서 매칭 비용 δ를 최소화하는 φ를 탐색한다. 연속적인 φ 값을 지원하기 위해 정수 롤링과 선형 보간을 결합한 ρ 함수를 도입하였다.

-

번역(이동) 추정 및 BEV Padding – 회전만으로는 충분하지 않으므로, 후보 번역 t=(x,y)를 격자 단위로 가정하고, 소스 BEV 쿼리를 t만큼 패딩(padding)한다. 패딩된 BEV와 타깃 BEV 사이의 매칭 비용을 다시 계산해 최적 번역을 찾는다. 탐색은 coarse‑grid → fine‑random 샘플링의 2‑단계 전략으로 효율성을 확보한다.

-

신뢰도(Confidence) 추정 – 매칭 비용 자체를 신뢰도 점수로 활용한다. 낮은 비용은 높은 신뢰도로 해석되며, 후속 시스템에서 임계값 기반 필터링이 가능하도록 설계되었다.

-

학습 손실 – 트리플렛 마진 손실(L_trp)로 글로벌 디스크립터를 학습하고, 요와 번역을 위한 별도 회전·번역 손실을 결합한다. 양성 샘플은 2 m 이내, 음성 샘플은 3 m 이상 떨어진 프레임을 사용해 거리 기반 트리플렛을 구성한다.

주요 기여는 (i) 멀티카메라 기반 BEV 표현을 활용해 스케일 불확실성을 자체적으로 해결, (ii) 별도 3‑D 지도·스케일 사전 없이 3‑DoF( x, y, yaw) 상대 자세를 정확히 추정, (iii) 토폴로지와 메트릭을 하나의 파이프라인에서 동시 처리하면서 신뢰도 점수를 제공한다는 점이다.

실험에서는 nuScenes, Argoverse와 같은 공개 데이터셋뿐 아니라, 저자들이 직접 수집한 복잡한 도시·고속도로 시나리오(조명 변화, 날씨 변동, 동적 객체 다수)에서도 기존 최첨단 방법들을 크게 앞선 성능을 기록했다. 특히 루프 클로저 검출 정확도와 전체 포즈 RMSE에서 평균 12 %~18 % 향상을 보였으며, 실시간 추론(≈30 fps, 1 GPU)도 만족한다.

댓글 및 학술 토론

Loading comments...

의견 남기기