다양한 포인트 클라우드로 VLA 강인성 강화

초록

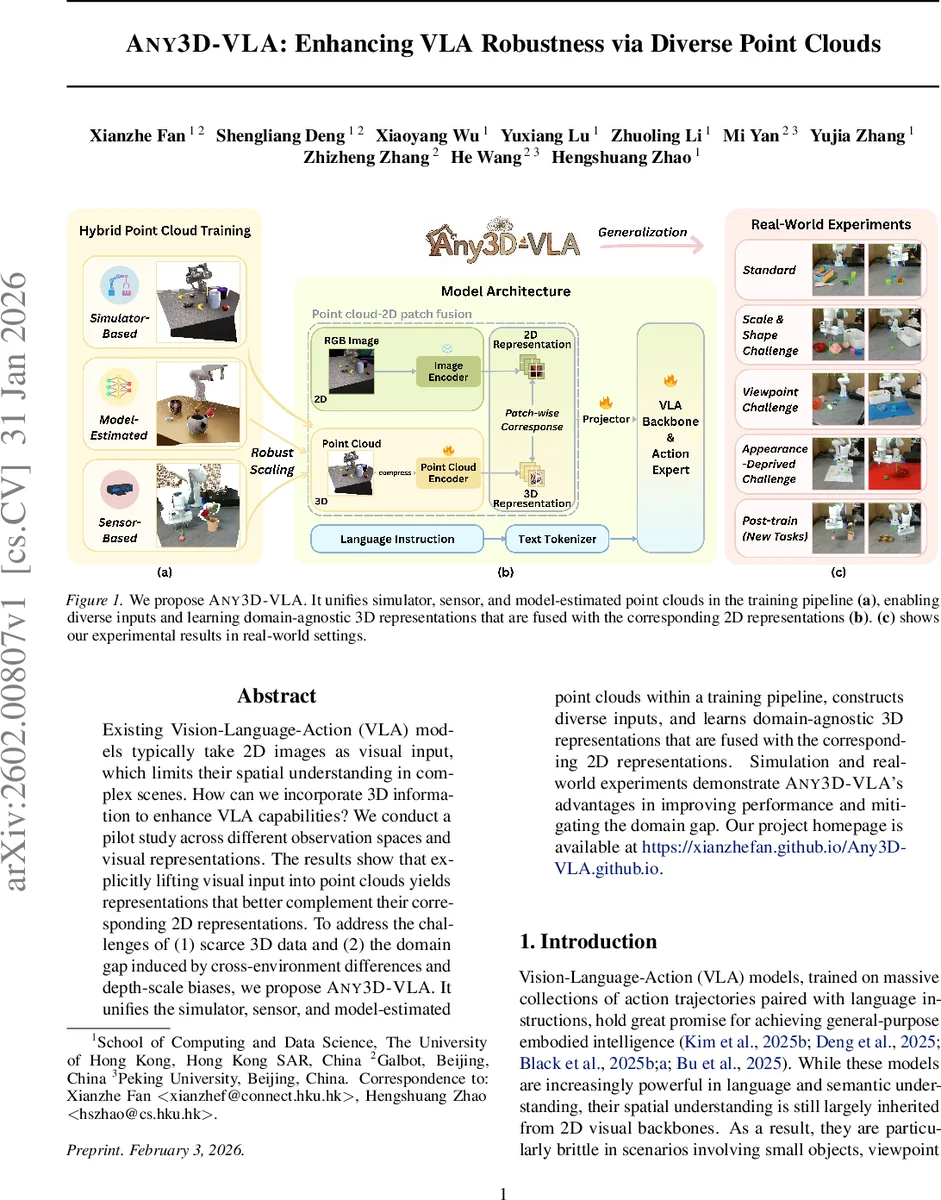

Any3D‑VLA는 시뮬레이터, 실제 센서, 모델이 추정한 깊이 정보를 모두 활용해 포인트 클라우드를 생성하고, 이를 2D 이미지와 융합해 Vision‑Language‑Action 모델의 공간 이해력을 크게 향상시킨다. 대규모 RGB‑D 사전학습과 하이브리드 포인트 클라우드 학습 전략을 통해 시뮬‑실 세계 간 도메인 격차를 감소시킨다.

상세 분석

본 논문은 기존 VLA(Vision‑Language‑Action) 모델이 2D 이미지에만 의존함으로써 발생하는 미세한 물체 인식, 시점 변화, 복잡한 폐색 상황에서의 취약성을 정확히 지적한다. 이를 해결하기 위해 3D 정보를 직접 활용하는 방안을 탐색했으며, 특히 ‘포인트 클라우드‑2D 패치 융합’ 방식이 가장 효과적임을 파일럿 스터디를 통해 입증하였다. 5가지 관찰 공간 설계 중, 깊이 정보를 단순히 이미지 채널에 추가하거나 VGGT와 같은 재구성 기반 공간 프리트레인을 적용한 방법은 제한적인 성능 향상만을 보였다. 반면, RGB와 깊이 데이터를 카메라 내·외부 파라미터를 이용해 실제 3D 좌표로 변환하고, 이를 3D 그리드 샘플링(‘3D 압축’) 후 사전 학습된 포인트 클라우드 인코더(Concerto)로 임베딩한 뒤, 2D 패치 토큰과 채널 차원에서 결합하는 전략은 메트릭 정밀도가 높은 공간 제약을 제공한다.

핵심 기술적 기여는 세 가지로 요약된다. 첫째, 시뮬레이터, 실제 센서, 그리고 딥러닝 기반 깊이 추정 모델이 생성한 서로 다른 특성을 가진 포인트 클라우드를 하나의 학습 파이프라인에 통합함으로써 데이터 다양성을 확보하고, 도메인 불일치를 완화한다. 둘째, 대규모 RGB‑D 사전학습 데이터셋을 구축하여 290개의 객체 카테고리와 10,680개의 인스턴스를 포함, 다양한 조명·재질·배경 변화를 시뮬레이션함으로써 3D 인식 능력을 사전 학습한다. 셋째, 압축된 포인트 클라우드와 2D 이미지 패치를 동일한 차원으로 정렬한 뒤 선형 프로젝션을 통해 언어 모델에 전달함으로써, 기존 VLM(Vision‑Language Model) 구조를 크게 변경하지 않으면서도 3D 기하 정보를 효과적으로 주입한다.

실험 결과는 두 가지 관점에서 강력함을 입증한다. 시뮬레이션 환경에서는 Single‑Trial 성공률이 61.1%로, 기존 최고 성능(56.8%) 대비 4.3%p 상승했으며, 실제 로봇 실험에서는 깊이 품질이 낮거나 스케일 바이어스가 존재해도 62.5%의 Zero‑Shot 정확도를 달성, 사전 학습된 모델 대비 29.2%p 향상을 보였다. 또한, 소량의 실제 시연 데이터를 이용한 파인‑튜닝 후에는 93.3%까지 정확도가 상승했다. LIBERO와 CALVIN 같은 표준 벤치마크에서도 전반적인 성능 우위를 유지하며, 특히 깊이 노이즈와 스케일 변동에 대한 내성이 뛰어나다는 점이 강조된다.

전반적으로 Any3D‑VLA는 3D 포인트 클라우드와 2D 이미지의 상호 보완적 특성을 효과적으로 결합함으로써 VLA 모델의 공간 인식 한계를 극복하고, 시뮬‑실 세계 전이 문제를 실질적으로 완화한다는 점에서 로봇 조작 및 임베디드 인공지능 분야에 중요한 전진을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기