공유 백본을 위한 단계별 다중학습 기반 검색 구성요소 최적화

초록

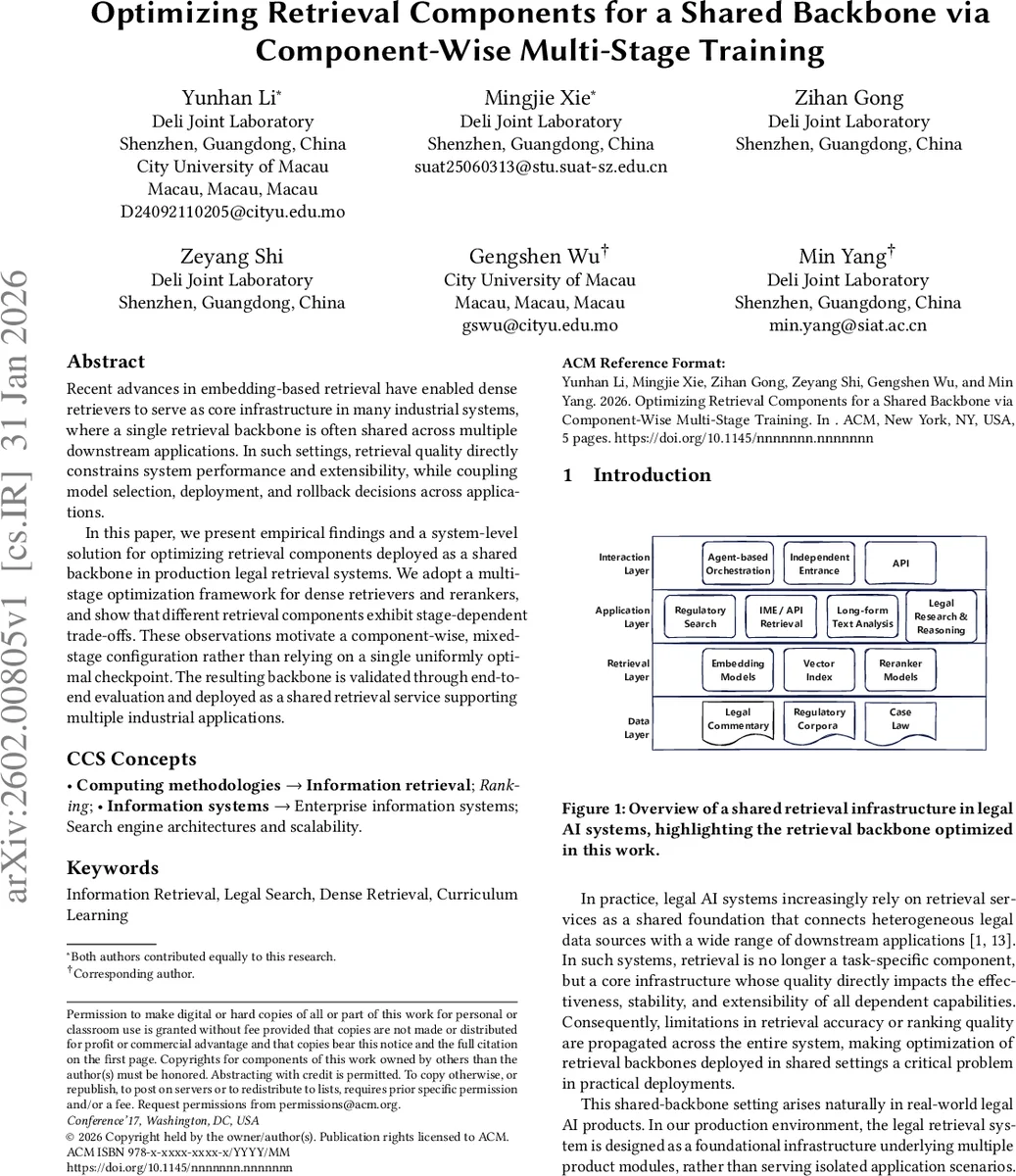

법률 검색 서비스에서 여러 애플리케이션이 하나의 밀집 검색 백본을 공유할 때, 단계별 커리큘럼 학습을 적용해 임베딩 모델과 재랭크 모델을 순차적으로 정제하였다. 후속 단계가 임베딩의 후보 커버리지를 크게 향상시키는 반면, 재랭크 단계에서는 정확도와 견고성 사이에 명확한 트레이드오프가 나타났다. 최종적으로 임베딩은 3단계 모델을, 재랭크는 2단계 모델을 결합한 혼합 구성을 선택해 전체 시스템 성능을 개선하고, 실제 서비스 A/B 테스트에서도 54.6%의 선호도를 얻었다.

상세 분석

이 논문은 대규모 법률 AI 시스템에서 단일 검색 백본을 여러 서비스가 공유하는 현실적인 제약을 전제로 한다. 기존 연구들은 단일 목표(예: 전반적인 Recall) 혹은 특정 도메인에 특화된 파인튜닝에 집중했지만, 저자는 “커리큘럼 학습”이라는 개념을 도입해 점진적으로 난이도가 높은 학습 신호를 제공하는 3단계 파이프라인을 설계하였다.

1단계에서는 다양한 출처(법령, 판례, 합성 질의)를 이용해 약한 감독 하에 대규모 데이터로 전반적인 의미 정렬을 학습한다. 이 단계는 임베딩 공간의 커버리지를 넓히는 데 초점을 맞추어 Recall@K를 크게 끌어올린다.

2단계에서는 모델이 기존에 놓쳤던 “hard negative” 샘플을 자동 추출해 재학습한다. 이 과정은 미세한 의미 차이를 구분하도록 모델을 강화하며, 특히 재랭크 단계에서 MRR과 nDCG 같은 정밀도 지표를 향상시킨다.

3단계는 동적으로 생성되는 어려운 네거티브와 고품질 질의 집합을 사용해 견고성을 보정한다. 여기서는 전체 Recall이 추가로 상승하지만, 재랭크 정확도는 약간 감소할 수 있다(특히 과도한 일반화로 인한 미세 차이 구분력 저하).

실험 결과는 임베딩 모델이 3단계에서 가장 높은 Recall을 달성하고, 재랭크 모델은 2단계에서 최고 MRR/nDCG를 기록함을 보여준다. 이는 “모든 구성요소가 동일한 단계에서 최적화될 필요는 없다”는 핵심 인사이트를 제공한다.

시스템 차원에서는 Recall–Budget 곡선을 통해 후속 재랭크 비용을 절감하면서도 목표 Recall을 유지할 수 있음을 입증한다. 예를 들어, 3단계 임베딩은 동일한 Recall을 30% 적은 후보 수(K)로 달성해 레이턴시와 연산 비용을 크게 낮춘다.

마지막으로 실제 서비스에 적용한 A/B 테스트에서는 새로운 백본이 54.6%의 선호도를 얻었으며, 평균 응답 시간은 0.10초(6.7%)만 증가했다. 이는 성능 향상이 실사용 환경에서도 충분히 실현 가능함을 의미한다. 전체적으로, 단계별 다중학습과 구성요소별 최적 checkpoint 선택이 공유 백본 환경에서 효율적이며, 배포 복잡성을 최소화하면서도 성능을 극대화할 수 있음을 증명한다.

댓글 및 학술 토론

Loading comments...

의견 남기기