시각‑언어‑행동 모델 가속을 위한 적응형 시각 토큰 캐싱 학습

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

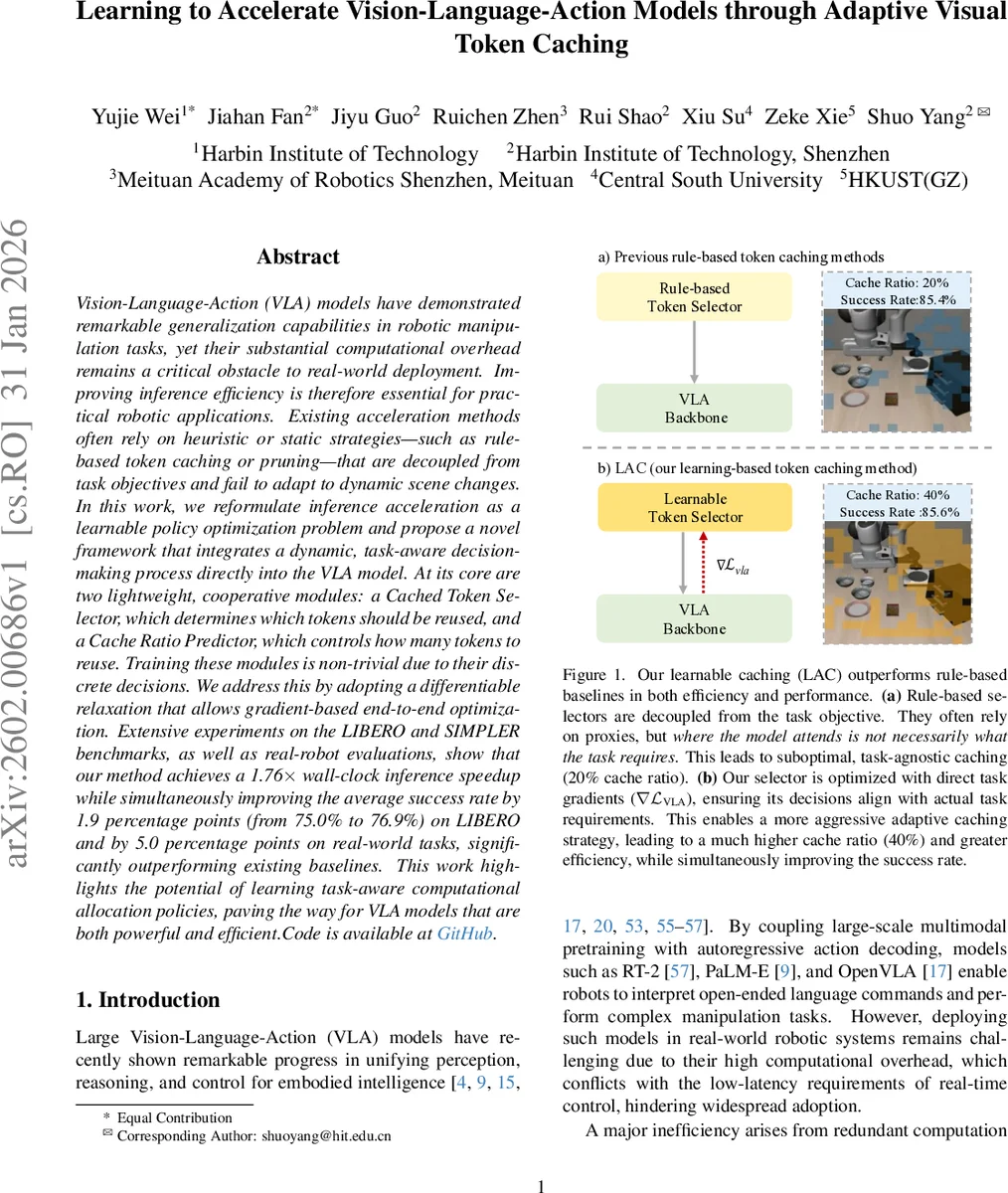

본 논문은 로봇 조작에 사용되는 대형 Vision‑Language‑Action(VLA) 모델의 추론 지연을 줄이기 위해, 작업 목표에 직접 연동되는 학습 가능한 토큰 캐싱 정책을 제안한다. 경량의 토큰 선택기와 캐시 비율 예측기를 도입하고, Gumbel‑Softmax 기반의 미분 가능한 이산 선택을 통해 엔드‑투‑엔드로 최적화한다. LIBERO·SIMPLER 벤치마크와 실제 로봇 실험에서 평균 1.76배 속도 향상과 성공률 1.9~5.0%p 상승을 달성하였다.

상세 분석

이 연구는 VLA 모델이 매 타임스텝마다 전체 비주얼 프레임을 재인코딩함으로써 발생하는 중복 연산을, 장면의 움직임과 작업 요구에 기반한 동적 토큰 재사용으로 최소화한다는 핵심 아이디어를 갖는다. 두 핵심 모듈은 (1) Cached Token Selector와 (2) Cache Ratio Predictor이다. Selector는 광학 흐름(RAFT‑small)과 현재 프레임을 결합한 입력 Vₜ를 받아 토큰별 중요도 점수 Sₜ∈

댓글 및 학술 토론

Loading comments...

의견 남기기