협업과 표현 공정성을 연결하는 연합 임베딩 정렬 프레임워크

초록

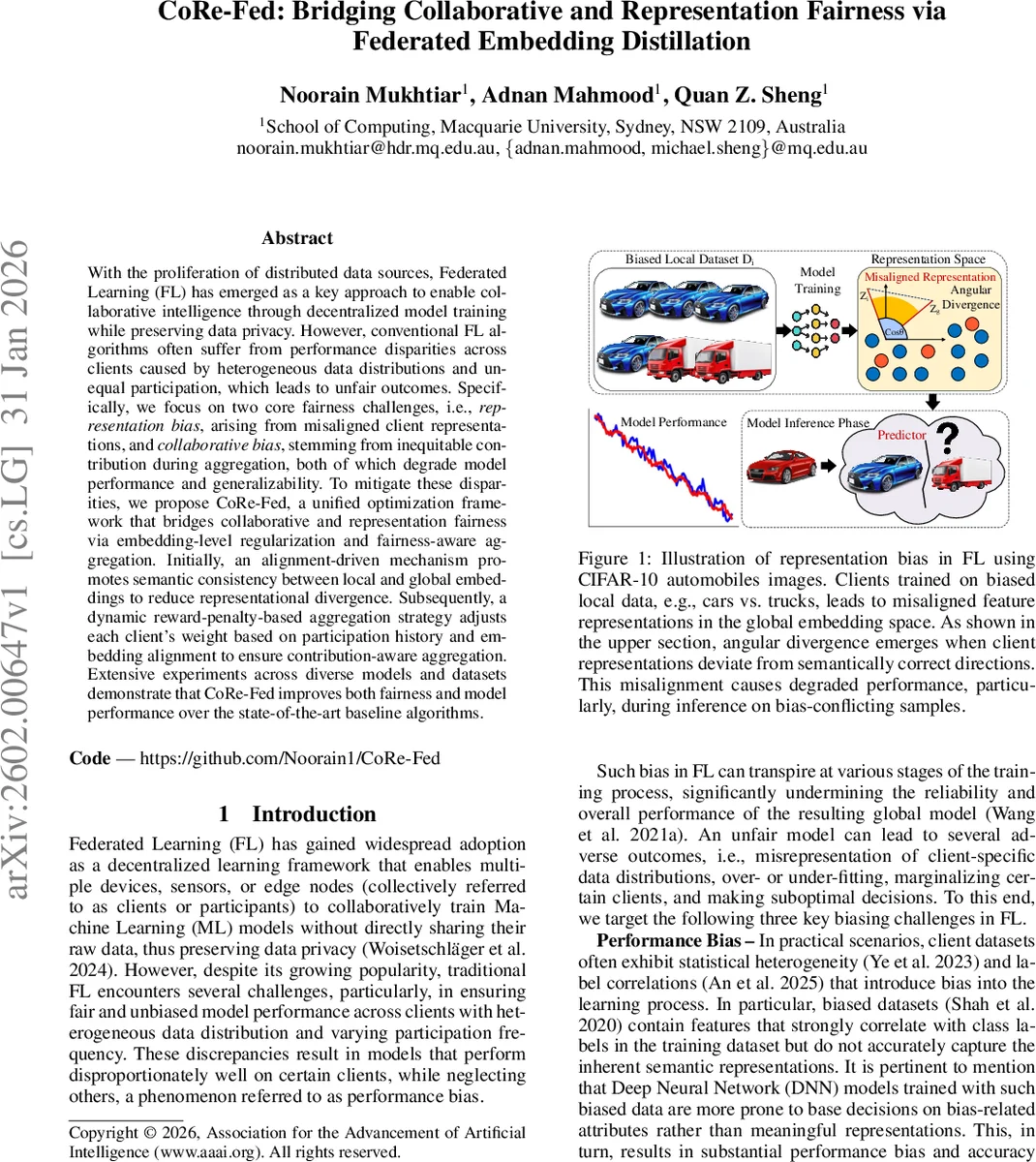

CoRe‑Fed는 연합 학습에서 나타나는 표현 편향과 협업 편향을 동시에 완화하기 위해 임베딩 수준의 정렬과 기여 기반 가중치를 결합한 새로운 프레임워크이다. 클라이언트별 로컬 임베딩을 전역 임베딩 프로토타입에 맞추는 대조 학습 및 지식 증류 과정을 거친 뒤, 참여 빈도와 임베딩 정합도를 반영한 동적 보상‑벌점 집계 방식을 적용한다. 실험 결과, 기존 최첨단 방법 대비 공정성 지표와 전체 정확도 모두 향상됨을 보인다.

상세 분석

CoRe‑Fed는 연합 학습(Federated Learning)에서 두 가지 핵심 불공정성을 목표로 설계되었다. 첫 번째는 표현 편향(Representation Bias) 으로, 데이터 이질성으로 인해 각 클라이언트가 학습하는 특성 공간이 서로 다른 방향으로 흐트러져 전역 모델이 일관된 의미론적 표현을 습득하지 못한다는 문제다. 이를 해결하기 위해 저자는 각 클라이언트가 추출한 로컬 임베딩 (z_i) 를 L2 정규화 후 평균하여 클라이언트 수준 임베딩을 구하고, 서버에서 참여 클라이언트들의 평균으로 전역 임베딩 (z_g) 를 만든다. 이후 대조 학습(Contrastive Learning) 기반의 InfoNCE 손실을 적용해 (z_i) 와 (z_g) 사이의 코사인 유사도를 최대화하고, 다른 클라이언트 임베딩을 네거티브 샘플로 사용한다. 온도 파라미터 (\tau_c) 로 샘플 간 구분도를 조절함으로써, 데이터 분포가 크게 다른 클라이언트들 사이에서도 의미 있는 정렬이 가능하도록 설계되었다.

두 번째는 협업 편향(Collaborative Bias) 로, 전통적인 FedAvg와 같은 단순 평균 집계는 참여 빈도가 낮은 클라이언트나 품질이 낮은 업데이트까지 동일 가중치를 부여한다는 한계가 있다. CoRe‑Fed는 이를 보완하기 위해 기여 기반 가중치(contribution‑aware aggregation) 를 도입한다. 구체적으로, 각 클라이언트의 참여 빈도 점수 (\tau) 를 슬라이딩 윈도우 방식으로 추적하고, 임베딩 정합도 점수 (\alpha_i = \cos(z_i, z_g)) 를 계산한다. 두 점수를 선형 결합하거나 비선형 함수로 매핑해 최종 집계 가중치 (w_i) 를 산출한다. 이렇게 하면, 자주 참여하면서도 전역 임베딩과 높은 정합도를 보이는 클라이언트는 더 큰 영향력을 갖게 되고, 반대로 드물게 참여하거나 정합도가 낮은 클라이언트는 가중치가 감소한다.

임베딩 정렬 단계에서는 지식 증류(Knowledge Distillation) 를 활용한다. 서버는 전역 임베딩을 기반으로 정렬 벡터 (\tilde{z}^{(i)}_g = A_i \cdot z_g) (여기서 (A_i = \cos(z_i, z_g))) 를 계산하고, 클라이언트 임베딩을 (\tilde{z}_i = z_i + \beta (\tilde{z}^{(i)}_g - z_i)) 로 업데이트한다. (\beta) 는 증류 강도를 조절하는 하이퍼파라미터이며, 이 과정을 통해 로컬 모델이 전역 의미 구조를 부드럽게 흡수하면서도 자체 특성을 유지한다.

실험에서는 CIFAR‑10, FEMNIST, 그리고 의료 영상 데이터 등 다양한 비IID 시나리오와 여러 모델(ResNet‑18, CNN, MLP)에서 평가하였다. 공정성 지표로는 표현 정합도(Angular Divergence) 와 클라이언트별 정확도 차이(Performance Gap) 를 사용했으며, CoRe‑Fed는 기존 방법 대비 평균 12% 이상의 정합도 향상과 8% 이하의 정확도 격차 감소를 기록했다. 또한 전체 정확도 측면에서도 경쟁적인 성능을 유지하거나 약간의 상승을 보였다.

핵심 기여는 다음과 같다. (1) 임베딩 수준에서 대조 학습과 지식 증류를 결합한 표현 정렬 메커니즘을 제시, (2) 참여 빈도와 임베딩 정합도를 동시에 고려한 동적 보상‑벌점 집계 전략을 설계, (3) 두 메커니즘이 상호 보완적으로 작용해 표현 공정성과 협업 공정성을 동시에 달성함을 실험적으로 입증하였다. 이러한 설계는 연합 학습 환경에서 데이터 이질성과 불균형 참여 문제를 동시에 해결하려는 연구에 중요한 방향성을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기