대규모 오디오 언어 모델을 활용한 XACLE 정렬 시스템

초록

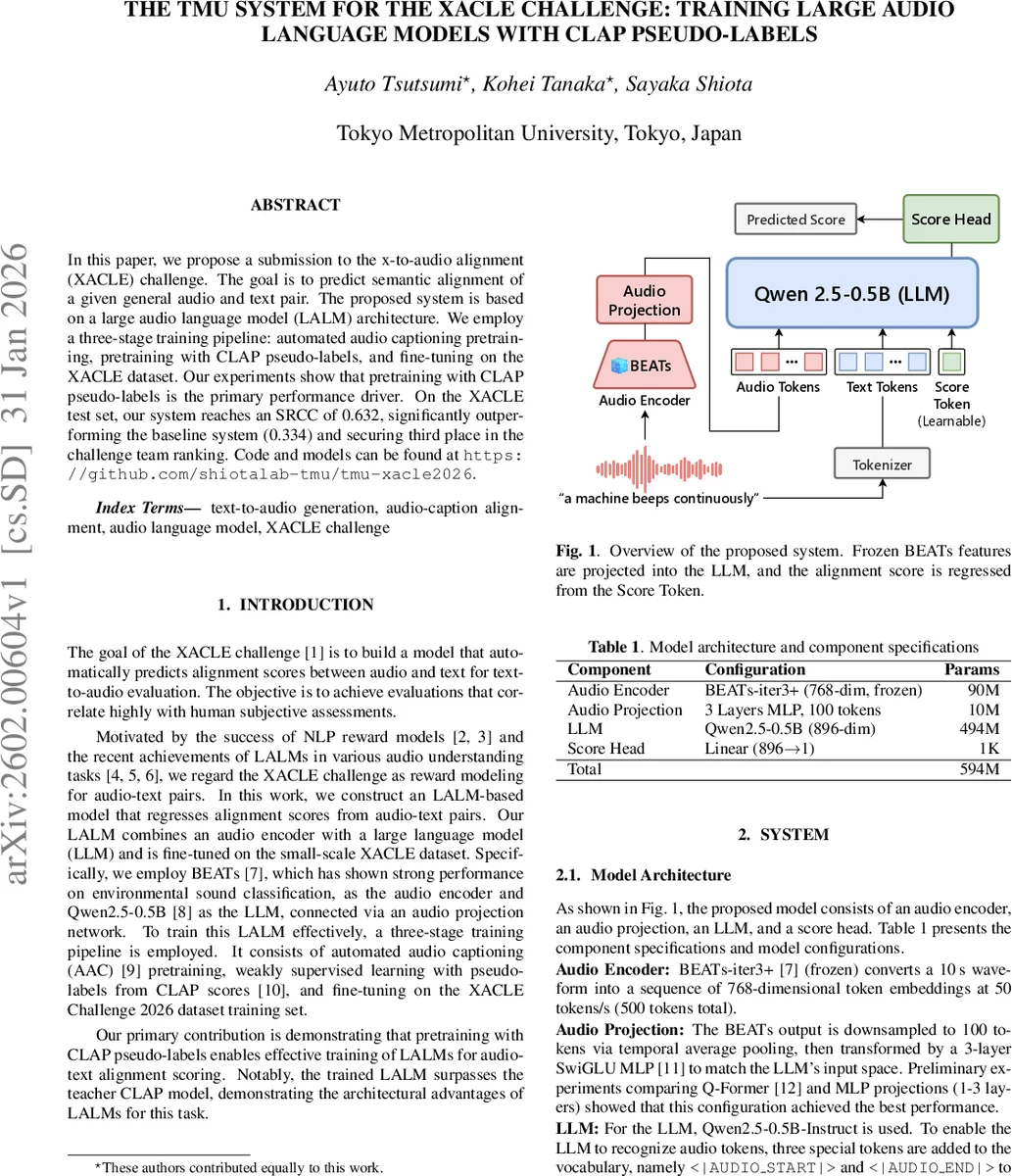

본 논문은 XACLE 챌린지를 위해 대규모 오디오 언어 모델(LALM)을 기반으로 한 정렬 점수 예측 시스템을 제안한다. BEATs‑iter3+ 오디오 인코더와 Qwen2.5‑0.5B LLM을 결합하고, 자동 오디오 캡션(AAC) 사전학습, CLAP 의사라벨 사전학습, XACLE 데이터 파인튜닝의 3단계 파이프라인을 적용한다. 실험 결과 CLAP 의사라벨 사전학습이 성능 향상의 핵심 요인임을 확인했으며, 테스트 셋에서 SRCC 0.632를 달성해 베이스라인(0.334) 대비 크게 앞섰고 3위에 올랐다.

상세 분석

이 연구는 오디오‑텍스트 정렬 점수 예측이라는 비교적 새로운 과제에 LALM(Large Audio Language Model) 구조를 적용한 점이 눈에 띈다. 먼저 오디오 인코더로 BEATs‑iter3+를 선택했는데, 이는 768‑차원의 토큰 시퀀스를 50 Hz로 추출해 고해상도 음향 정보를 보존한다. 인코더를 고정(frozen)하고, 3‑layer SwiGLU MLP를 통해 100개의 오디오 토큰을 LLM 입력 차원(896)으로 매핑함으로써, 대규모 언어 모델이 오디오 토큰을 자연스럽게 처리하도록 설계했다.

LLM으로 Qwen2.5‑0.5B‑Instruct를 사용했으며, <|AUDIO START|>, <|AUDIO END|>, <|SCORE|>와 같은 특수 토큰을 vocab에 추가해 오디오 시퀀스와 점수 예측 위치를 명시한다. 특히 <|SCORE|> 토큰을 시퀀스 끝에 배치하고, 해당 위치의 hidden state를 선형 레이어에 통과시켜 점수를 회귀하는 방식은 BERT의 CLS 토큰과 유사하지만, causal attention 구조에 맞게 설계된 점이 실용적이다.

학습 파이프라인은 세 단계로 구성된다. 1단계 AAC 사전학습에서는 AudioCaps와 AudioSetCaps( VGGSound 기반) 273 K 샘플을 이용해 모델이 오디오와 텍스트 간의 기본 연관성을 학습한다. 2단계에서는 CLAP 모델(HumanCLAP‑M2D)으로부터 얻은 의사라벨 점수를 목표로 약한 지도 학습을 수행한다. 여기서 저점수 샘플을 생성하기 위해 음성 혹은 텍스트를 다른 샘플과 교체하는 negative sampling을 적용, 전체 학습 규모를 1.064 M으로 확대했다. 순위 기반 손실인 ListNet을 채택해 SRCC와 직접적인 정렬 관계를 최적화한다는 점이 핵심이다. 3단계 파인튜닝에서는 실제 XACLE 훈련 데이터(7.5 K)만을 사용해 최종 정렬 점수를 미세조정하고, SpecAugment(주파수·시간 마스킹)으로 일반화 능력을 강화한다.

실험 결과는 단계별 SRCC 향상을 명확히 보여준다. AAC 사전학습만으로는 0.352(검증) 수준에 머물렀지만, CLAP 의사라벨 사전학습을 추가하면 0.598으로 급상승한다. 최종 파인튜닝을 거치면 검증 SRCC 0.674, 테스트 SRCC 0.625를 기록한다. 특히 CLAP 교사 모델(HumanCLAP‑M2D)의 0.602와 거의 동등한 성능을 달성했으며, 이는 LALM이 CLAP보다 구조적으로 우수함을 시사한다. 또, AAC 사전학습을 생략한 모델과 전체 파이프라인을 앙상블하면 테스트 SRCC 0.632라는 최고 점수를 얻어, AAC가 정렬 점수 예측에는 크게 기여하지 않지만, 다른 태스크와의 보완 효과가 있음을 확인한다.

이 논문은 (1) 대규모 언어 모델에 오디오 토큰을 효과적으로 삽입하는 방법, (2) CLAP 기반 의사라벨을 활용한 약한 지도 학습이 정렬 점수 예측에 결정적임을 입증, (3) 순위 기반 손실(ListNet)이 SRCC 최적화에 적합함을 실증적으로 보여준다. 향후 연구에서는 더 다양한 오디오 인코더와 멀티모달 프리트레인 데이터를 결합하거나, 교차 도메인 전이 학습을 통해 정렬 점수 외의 멀티모달 평가 지표에도 적용할 가능성을 탐색할 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기