컴포지션 환각 방지를 위한 비디오 멀티모달 LLM 디코딩 전략

초록

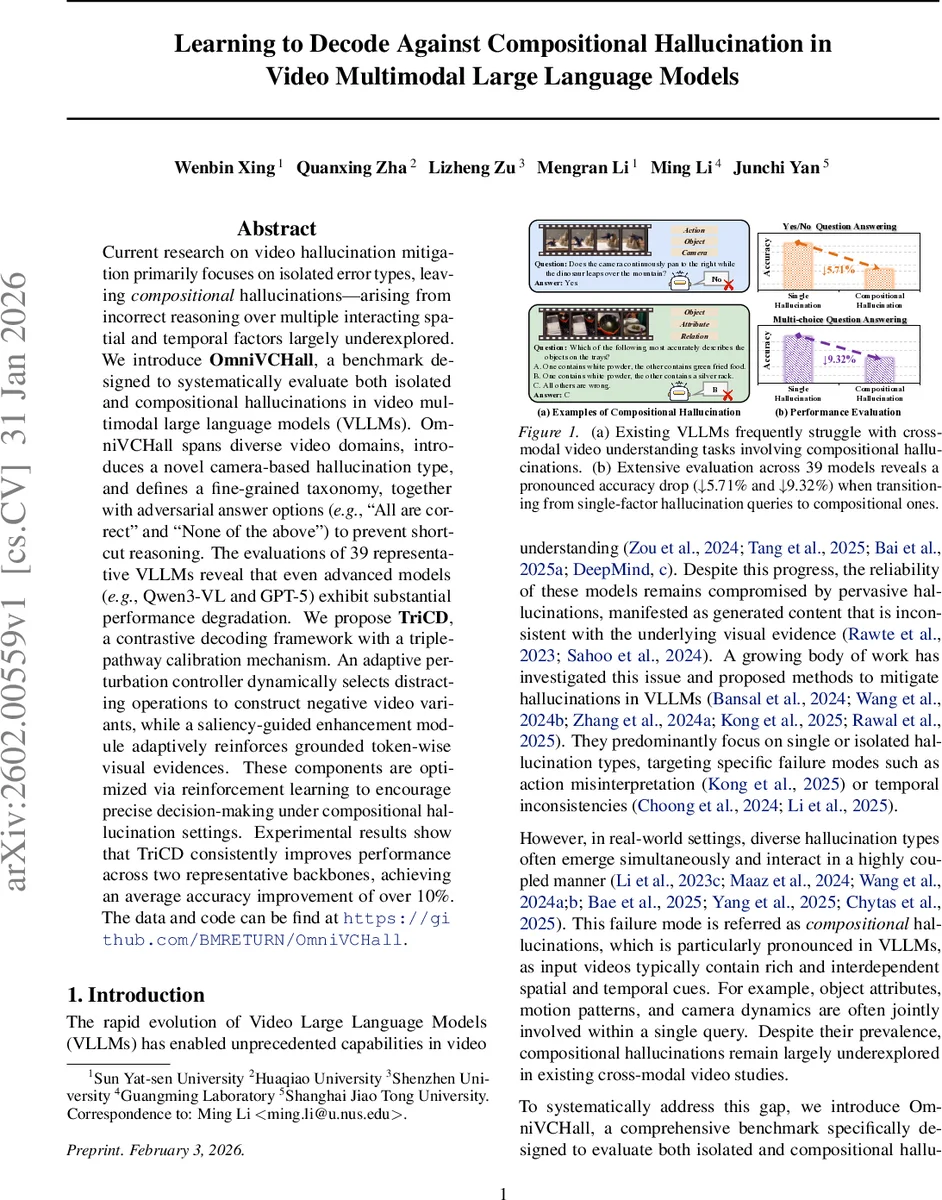

본 논문은 비디오 멀티모달 대형 언어 모델(VLLM)에서 다중 공간·시간 요인이 얽힌 ‘컴포지션 환각’ 문제를 체계적으로 평가하기 위해 OmniVCHall 벤치마크를 제안한다. 823개의 고품질 비디오와 9,027개의 VQA 쿼리를 포함하며, 8가지 세분화된 환각 유형과 카메라 동작 기반 새로운 유형을 정의한다. 39개 모델을 평가한 결과, 최신 모델조차도 컴포지션 환각 상황에서 정확도가 크게 떨어짐을 확인한다. 이를 극복하기 위해 제안된 TriCD는 적응형 교란 생성기와 시각적 주의 강화 모듈을 결합한 삼중 경로 대비 디코딩 프레임워크이며, 강화학습으로 최적화한다. 실험 결과 두 백본 모델 모두 평균 10% 이상 정확도 향상을 달성하였다.

상세 분석

OmniVCHall은 기존 비디오 환각 데이터셋이 단일 오류 유형에 국한된 점을 보완하기 위해 설계되었다. 먼저 8가지 세부 환각 유형(객체, 장면, 사건, 행동, 관계, 속성, 시간, 카메라)을 정의하고, 각각을 단일(S)와 복합(C) 질문 형태로 구분한다. 특히 ‘카메라’ 유형은 카메라 움직임을 물체 움직임으로 오해하는 오류를 포착하며, 이는 기존 연구에서 간과된 부분이다. 데이터는 실제 촬영 영상과 AI‑생성 영상을 1:1 비율로 섞어 다양성을 확보했으며, 각 비디오에 대해 인간이 검증한 캡션을 기반으로 Gemini‑2.5‑Pro가 초기 질문을 생성하고, 전문가가 최종 검수한다. 또한 ‘All are correct’·‘None of the above’와 같은 적대적 선택지를 삽입해 언어‑편향이나 단순 배제 전략을 차단한다.

평가에서는 39개의 최신 VLLM(예: Qwen3‑VL, GPT‑5, VideoLLaMA 등)을 OmniVCHall에 적용했으며, 단일 환각 질문 대비 복합 환각 질문에서 평균 정확도가 각각 5.71%·9.32% 감소함을 보고한다. 이는 모델이 개별 시각·시간 단서를 잘 파악하더라도, 여러 단서가 동시에 요구되는 상황에서는 근본적인 추론 능력이 약화된다는 것을 의미한다.

TriCD는 이러한 한계를 극복하기 위해 세 가지 경로를 동시에 활용한다. ① Adaptive Perturbation Controller(APC)는 현재 비디오‑질문 컨텍스트를 분석해 가장 혼동을 일으킬 가능성이 높은 교란 연산(프레임 삭제, 색상 변형, 카메라 시점 변환 등)을 동적으로 선택하고, 이를 통해 ‘음성 샘플’(negative video variant)을 생성한다. ② Saliency‑Guided Enhancement(SGE) 모듈은 DINOv3 기반의 공간 특징과 Farneback 옵티컬 플로우 기반의 시간 흐름을 융합해 토큰 수준의 시각적 주의 맵을 만든다. 이 맵은 중요한 영역에 가중치를 부여해 디코더가 근거 없는 토큰을 억제하도록 돕는다. ③ Reinforcement Learning(RL) 단계에서는 원본 로그잇과 교란 로그잇 사이의 차이를 보상으로 사용해 APC와 SGE를 공동 최적화한다. 정책 네트워크는 ‘정답 확률 증대’와 ‘음성 샘플 억제’를 동시에 목표로 하며, PPO 기반 업데이트를 적용한다.

실험 결과, TriCD를 Qwen3‑VL‑Instruct‑8B와 VideoLLaMA3‑7B에 적용했을 때 각각 9.61%·12.03%의 정확도 향상을 기록했다. 특히 복합 질문(C‑YNQA, C‑MCQA)에서의 개선 폭이 단일 질문 대비 두 배에 육박했으며, ‘All are correct’·‘None of the above’ 옵션이 포함된 경우에도 성능 저하가 최소화되었다. 이는 TriCD가 모델 파라미터를 변경하지 않고도 디코딩 단계에서 동적 교란과 시각적 근거 강화라는 두 축을 동시에 작동시켜, 복합 환각에 대한 내성을 크게 높인다는 것을 입증한다.

한계점으로는 현재 APC가 사전 정의된 교란 연산 집합에 의존한다는 점과, SGE가 DINOv3와 Farneback에 기반해 비교적 간단한 특징을 사용한다는 점이 있다. 향후 연구에서는 교란 연산을 메타러닝으로 자동 생성하거나, 더 정교한 비디오 트랜스포머 기반 시각적 주의 모델을 도입해 성능을 한층 끌어올릴 여지가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기