인간 동영상에서 로봇 조작을 위한 대비적 잠재 행동 학습

초록

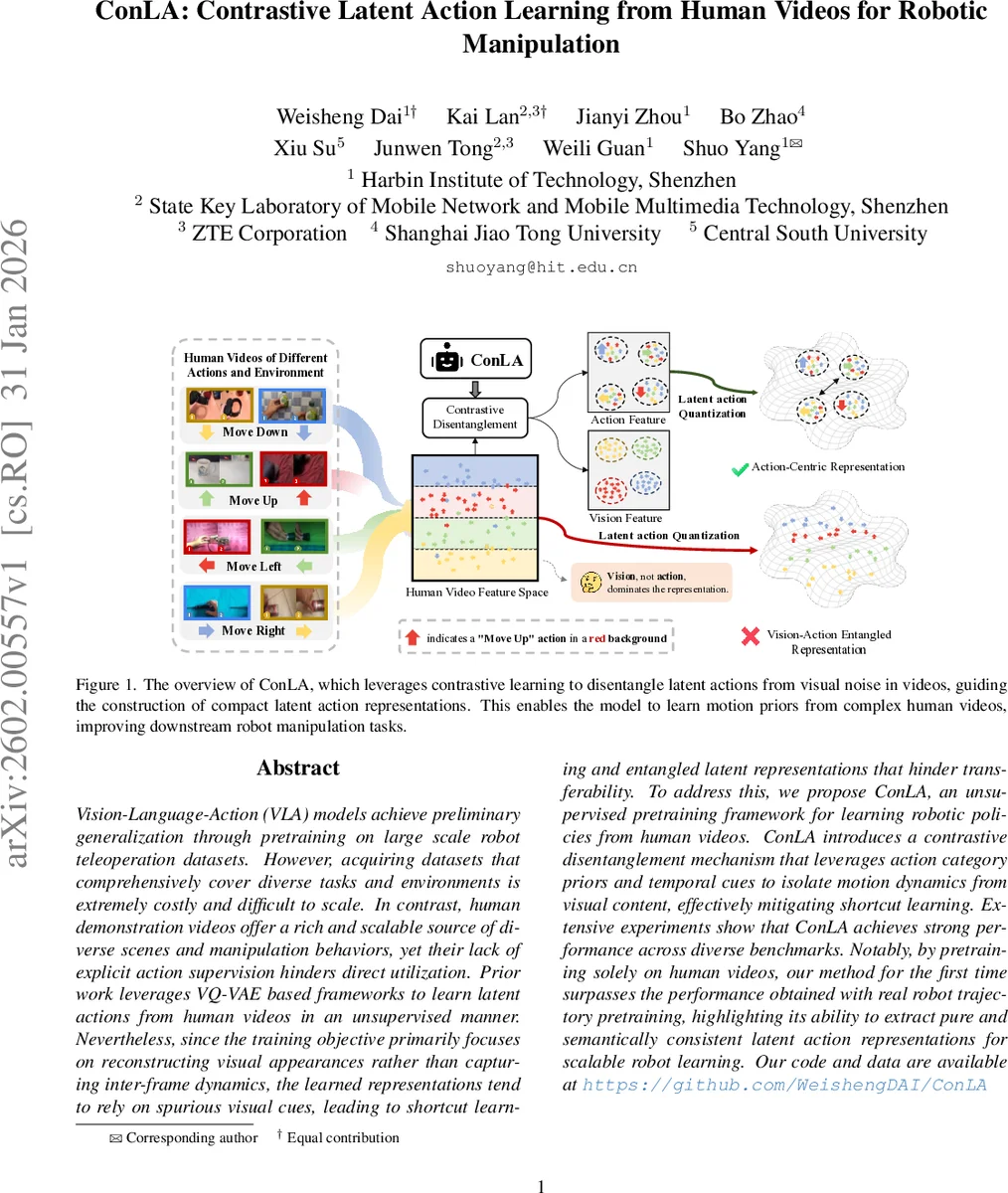

ConLA는 인간 시연 동영상만을 이용해 로봇 조작 정책을 사전학습하는 프레임워크이다. VQ‑VAE 기반의 기존 방법이 시각 재구성에만 초점을 맞춰 동작 정보를 놓치는 문제를, 행동 카테고리와 시간 순서를 활용한 대비 학습으로 해결한다. 행동‑중심·시각‑중심 대비 손실을 동시에 적용해 동작 표현을 시각 잡음으로부터 분리하고, 이렇게 얻은 이산 잠재 행동 토큰을 Vision‑Language‑Action 모델에 입력해 로봇 정책을 학습한다. 실험 결과, 인간 동영상만으로 사전학습했을 때도 로봇 텔레오퍼레이션 데이터로 사전학습한 기존 방법보다 성능이 높으며, 실제 로봇 실험에서도 1 % 이상 향상된 성공률을 기록한다.

상세 분석

ConLA는 인간 동영상에서 “진정한” 동작 정보를 추출하기 위해 두 가지 핵심 아이디어를 결합한다. 첫 번째는 행동 카테고리 사전이다. 인간 조작 영상에는 ‘집기’, ‘이동’, ‘놓기’ 등 반복되는 행동 원시가 존재한다는 점을 이용해, 각 프레임 쌍에 약한 라벨(액션 클래스)을 부여한다. 이 라벨은 대비 학습에서 액션‑중심 대비 손실(supervised contrastive loss)로 사용되어, 동일 클래스의 잠재 행동 임베딩을 서로 가깝게, 다른 클래스는 멀게 만든다. 이렇게 하면 시각적 배경이나 조명 변화와 같은 잡음이 임베딩에 섞이는 것을 방지하고, 행동 의미가 군집화된다.

두 번째는 시간적 역전 증강이다. 현재 프레임 Oₜ와 미래 프레임 Oₜ₊ₖ을 입력으로 하는 역동역 모델(Inverse Dynamics Model)과, 이를 역순(

댓글 및 학술 토론

Loading comments...

의견 남기기