RGBX‑R1 시각 모달리티 체인오브생각 강화 학습

초록

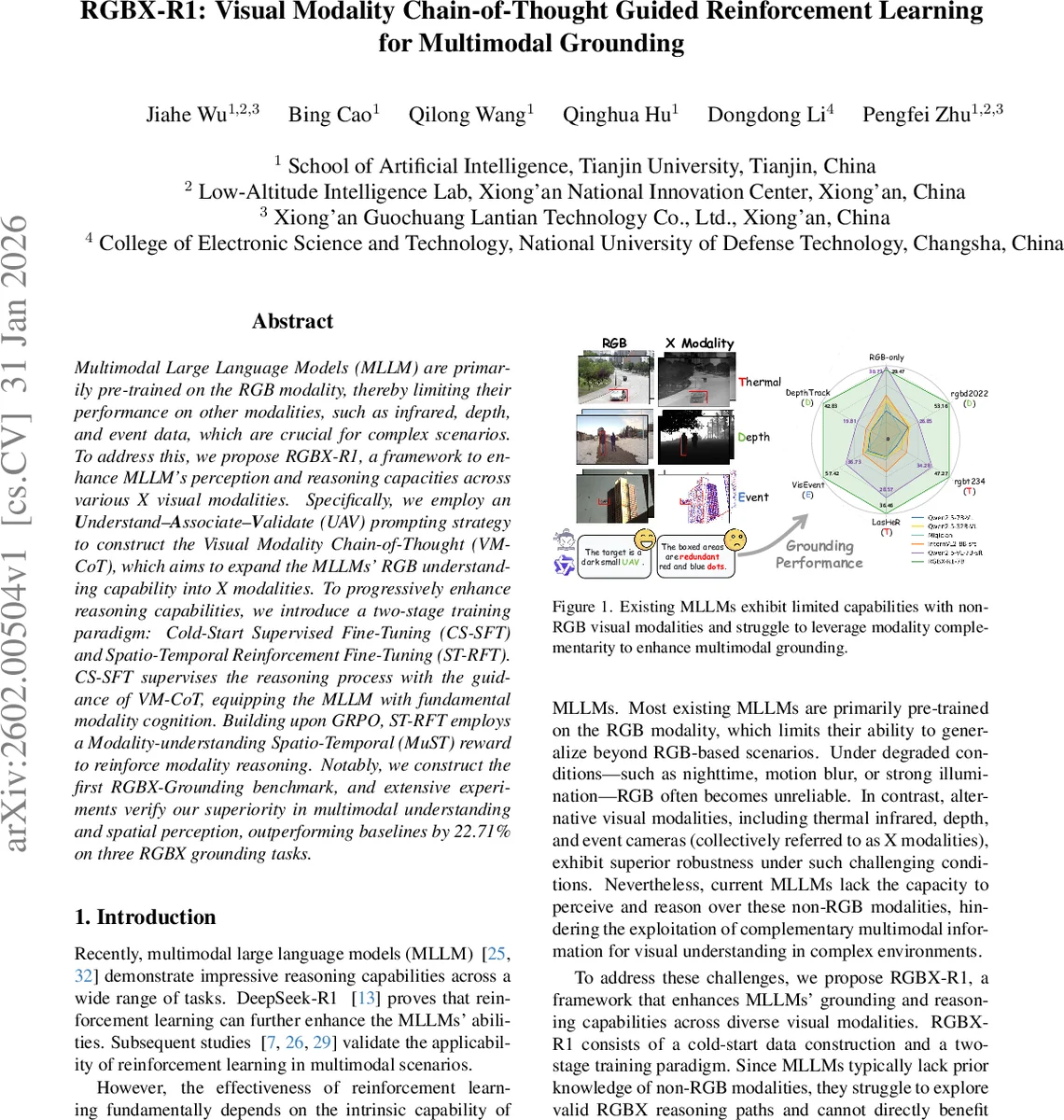

RGBX‑R1은 RGB 외의 적외선·깊이·이벤트 등 X‑모달리티를 이해하도록 MLLM을 훈련시키는 프레임워크이다. 이해‑연결‑검증(UAV) 프롬프트로 Visual Modality Chain‑of‑Thought(VM‑CoT)를 생성하고, 차가운 시작 감독 미세조정(CS‑SFT)과 시공간 강화 미세조정(ST‑RFT) 두 단계 학습을 적용한다. 새로 만든 RGBX‑Grounding 벤치마크에서 기존 모델 대비 22.71% 향상된 성능을 보인다.

상세 분석

본 논문은 멀티모달 대형 언어 모델(MLLM)이 RGB 데이터에만 사전학습된 한계를 극복하고, 적외선, 깊이, 이벤트와 같은 비‑RGB 시각 모달리티를 효과적으로 활용하도록 설계된 RGBX‑R1 프레임워크를 제안한다. 핵심 아이디어는 세 단계의 UAV 프롬프트(Understand‑Associate‑Validate)를 통해 시각 모달리티 체인오브생각(VM‑CoT)을 자동 생성하고, 이를 고품질 감독 신호로 활용하는 것이다.

-

데이터 구축: 기존 RGBX 트래킹 데이터셋 5개를 MIG(다중 이미지 그라운딩) 형식으로 변환해 7 k 샘플의 RGBX‑Grounding 데이터셋을 만든다. 각 샘플은 RGB 템플릿, X‑모달리티 템플릿, 6개의 검색 이미지, 그리고 정답 바운딩 박스를 포함한다.

-

VM‑CoT 생성: Qwen2.5‑VL‑32B를 이용해 ‘이해’ 단계에서 RGB 템플릿만으로 목표 객체와 장면을 파악하고, ‘연결’ 단계에서 공간 대응 관계와 X‑모달리티의 촬영 원리를 설명한다. ‘검증’ 단계에서는 연속 프레임에서 각 모달리티의 정보 손실 여부를 판단해 최종 목표 위치를 확정한다. 자동 생성 후 자체 plausibility 검증과 인간 검수를 거쳐 5 000개 이상의 고품질 CoT를 확보한다.

-

Cold‑Start Supervised Fine‑Tuning (CS‑SFT): VM‑CoT를 정답 시퀀스로 사용해 Qwen2.5‑VL을 단계별 추론을 학습한다. 여기서 도입된 Modality‑specific Token Weighting(MTW) 메커니즘은 각 토큰의 모달리티별 출현 빈도 차이를 KL‑다이버전스로 측정해, 토큰‑레벨 손실에 가중치를 부여한다. 이는 “object”, “image”와 같은 일반 토큰보다 모달리티 특화 토큰이 학습에 더 큰 영향을 미치게 한다.

-

Spatio‑Temporal Reinforcement Fine‑Tuning (ST‑RFT): 1단계 모델(Qwen‑cs)을 정책 모델로 삼아 GRPO(Group Relative Policy Optimization)를 적용한다. 보상은 세 부분으로 구성된 MuST( Modality‑understanding Spatio‑Temporal) 보상이다.

- 시공간 보상: 프레임 간 IoU에 로그‑가중치를 곱해 후반 프레임의 정확성을 강조하고, 초기 프레임의 관성적 숫자 추정을 억제한다.

- 모달리티 이해 보상: 일부 샘플에 대해 모달리티 분류를 요구하고, 정답이면 CoT 내부 토큰 정확도에 비례해 보상을 부여한다.

- 포맷 보상: 응답이

… 구문과 바운딩 박스 리스트 형식을 정확히 따르는지를 점검한다.

-

실험 및 결과: RGBX‑Grounding 벤치마크(열·깊이·이벤트 3가지 트래킹 시나리오)에서 기존 MLLM(DeepSeek‑R1, LLaVA‑1.5 등) 대비 평균 22.71%의 mAP 향상을 기록한다. 특히 적은 샘플(수백 개)만으로도 “모달 지식 급증(Modal Knowledge Emergent)” 현상이 관찰돼, RGB 이해를 X‑모달리티에 빠르게 전이시킬 수 있음을 보인다.

주요 기여

- 최초의 RGBX‑Grounding 데이터셋과 UAV 기반 VM‑CoT 생성 파이프라인 제공.

- 토큰‑레벨 가중치를 통한 모달리티 특화 감독 학습(MTW) 제안.

- 시공간·모달리티·포맷을 통합한 MuST 보상으로 강화 학습을 적용, 기존 RL‑based MLLM이 겪던 모달리티 부족 문제를 해결.

한계 및 향후 과제

- 현재는 3가지 X‑모달리티에 국한되며, 라이다·레이더 등 고차원 센서에 대한 확장은 필요하다.

- VM‑CoT 자동 생성 과정에서 일부 논리 오류가 존재하므로, 더 정교한 검증 메커니즘이 요구된다.

- 강화 학습 단계에서 보상 설계가 복잡해 학습 안정성이 떨어질 수 있어, 보상 함수의 자동 튜닝 방법이 연구될 여지가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기