메멘토: 일상 기억을 예측적으로 시각화하는 개인 웨어러블 AR 비서

초록

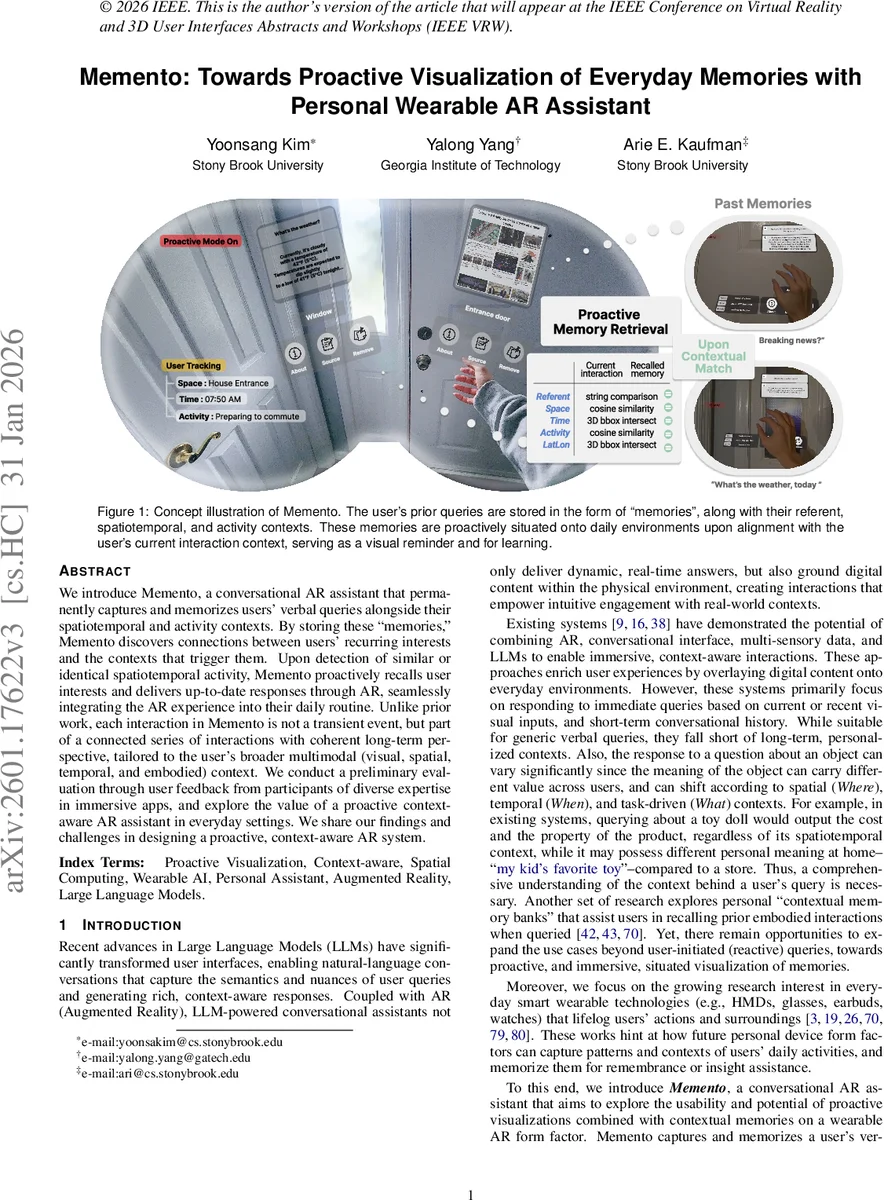

메멘토는 사용자의 음성 질문과 그 질문이 발생한 시공간적 맥락 및 활동을 영구적으로 기억하는 대화형 AR 비서 시스템입니다. 저장된 ‘기억’을 바탕으로 사용자의 반복적인 관심사와 이를 유발하는 상황 간의 연결을 발견하며, 유사한 맥락이 감지되면 사용자의 관심사를 예측적으로 불러와 AR을 통해 최신 정보를 제공합니다. 이를 통해 일상 루틴에 자연스럽게 AR 경험을 통합하는 것이 목표입니다.

상세 분석

메멘토 시스템의 핵심 기술적 혁신은 ‘참조점 기반 시공간 활동 기억(RSAM)‘이라는 개념을 도입한 데 있습니다. 이는 단순한 질문-응답 쌍을 넘어, 해당 상호작용이 발생한 물리적 참조 대상(Referent), 공간적 위치(Space), 시간(Time), 사용자 활동(Activity)을 하나의 메모리 단위로 통합하여 저장합니다. 이를 통해 시스템은 사용자의 장기적이고 개인화된 맥락을 이해할 수 있는 기반을 마련합니다.

프로액티브(예측적) 시각화를 구현하기 위해 시스템은 경량화된 검색 메커니즘을 활용합니다. 현재 사용자의 맥락(예: 집 출입구, 아침 7시 50분, 출근 준비 중)을 RSAM 형태로 추출한 후, 저장된 메모리와의 유사도를 다차원으로 평가합니다. 공간적 유사도는 3D 바운딩 박스 교차 검사를, 시간 및 활동 유사도는 임베딩 벡터의 코사인 유사도를 통해 계산합니다. 이 복합적 매칭 점수가 특정 임계치를 넘으면, 해당 메모리와 연결된 정보(예: 전날 물었던 날씨 정보)를 최신 데이터로 갱신하여 AR로 사용자에게 사전에 제시합니다.

시스템 구현에는 멀티모달 대형 언어 모델(LLM)이 핵심 역할을 합니다. GPT-4o 및 Gemini는 질문 이해, 응답 생성, 활동 맥락 설명 생성에 사용되며, CLIP 모델은 메모리와 맥락의 의미적 임베딩을 생성합니다. 또한, 개방형 어휘 객체 감지 모델(YOLO-World)을 통해 사전 정의되지 않은 일상 환경의 물체를 참조점으로 식별할 수 있도록 했습니다.

사용자 평가를 통해 도출된 주요 통찰은 다음과 같습니다: 프로액티브 기능은 반복적 루틴에서의 편의성을 높이지만, 정보 과부하나 프라이버시 우려를 유발할 수 있습니다. 따라서 사용자가 프로액티브 알림의 빈도와 조건을 조절할 수 있는 인터페이스(Adjustment Interface)의 필요성이 강조되었습니다. 또한, 정확한 맥락 인식을 위한 활동 및 객체 인식 기술의 정확도가 시스템 유용성의 핵심 제약 조건으로 지적되었습니다. 이 연구는 AR이 단순한 정보 오버레이를 넘어, 사용자의 장기적 경험과 기억을 연속적으로 연결하는 ‘개인화된 공간 기억’ 플랫폼으로 발전할 가능성을 보여줍니다.

댓글 및 학술 토론

Loading comments...

의견 남기기