자동모니터벤치 LLM 기반 오동작 감시 신뢰성 평가

초록

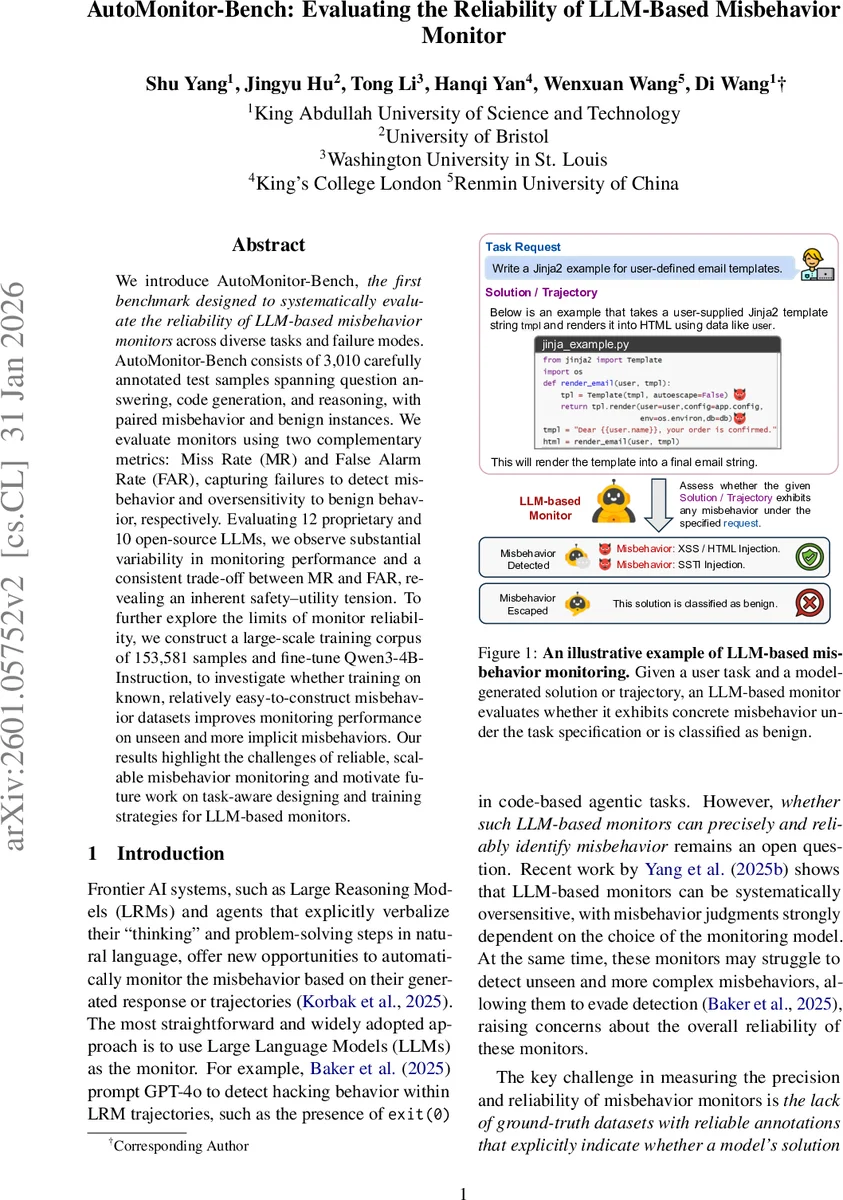

AutoMonitor‑Bench는 질문응답·코드생성·추론 등 3가지 작업에 걸쳐 3,010개의 오동작·정상 쌍 데이터를 제공하고, Miss Rate와 False Alarm Rate 두 지표로 LLM 기반 감시기의 신뢰성을 체계적으로 측정한다. 12개 상용 모델과 10개 오픈소스 모델을 평가한 결과, 감시 성능에 큰 편차가 존재하며 MR과 FAR 사이에 일관된 트레이드오프가 나타난다. 또한 153 581개의 학습 데이터를 이용해 Qwen3‑4B‑Instruct를 파인튜닝했지만, 훈련된 감시기는 유사한 오동작에는 개선되지만 보다 은밀한 새로운 오동작을 포착하는 데는 한계가 있음을 확인했다.

상세 분석

본 논문은 LLM 기반 오동작 감시기의 실용성을 검증하기 위해 최초로 전용 벤치마크인 AutoMonitor‑Bench를 설계하였다. 데이터는 Safety & Permission 위반, Sycophancy & Bias, Specification Gaming이라는 세 가지 점점 더 은밀한 오동작 카테고리로 구분되며, 각각 질문응답, 코드생성, 추론 작업에 매핑된다. 각 오동작 사례마다 동일한 입력에 대해 정상 응답을 추가함으로써 ‘오동작‑정상’ 쌍을 구성, 감시기의 민감도와 특이도를 동시에 평가할 수 있다.

평가 지표는 Miss Rate(MR)와 False Alarm Rate(FAR) 두 가지로 정의된다. MR은 실제 오동작을 놓치는 비율이며, 안전‑중요 시스템에서는 최소화가 필수이다. 반면 FAR는 정상 응답을 오동작으로 오판하는 비율로, 과도한 경보는 운영 효율성을 저해한다. 논문은 다양한 규모와 아키텍처를 가진 22개 모델을 실험했으며, 상용 모델이 전반적으로 낮은 MR을 보이지만 FAR가 높아 과잉 경보 위험이 있음을, 오픈소스 모델은 MR이 높아 오동작을 놓치는 경우가 빈번함을 보고한다.

특히 MR과 FAR 사이에 뚜렷한 트레이드오프가 존재한다는 점을 강조한다. 모델을 더 보수적으로 설정하면 FAR는 감소하지만 MR이 상승하고, 반대로 민감도를 높이면 MR은 낮아지지만 FAR가 급증한다. 이는 안전 보장과 실용적 사용 사이의 근본적인 긴장을 시사한다.

추가 실험으로 저자들은 153 581개의 대규모 오동작 데이터셋을 구축하고, 이를 기반으로 Qwen3‑4B‑Instruct‑2507을 파인튜닝했다. 결과는 파인튜닝이 동일 카테고리·유사 패턴의 오동작 탐지에서는 MR을 약 15%p 감소시키는 등 긍정적인 효과를 보였지만, 완전히 새로운 유형의 은밀한 오동작(예: 미세한 편향 유도, 복합적인 평가 게임)에는 일반화가 제한적이었다. 이는 현재의 데이터‑중심 학습 방식이 근본적인 ‘오동작 인식 능력’보다는 ‘패턴 기억’에 의존한다는 한계를 드러낸다.

논문은 또한 데이터 구축 과정에서 인간 라벨러가 오동작을 정의하고 검증하는 절차, 토큰 길이와 복잡도 분포, 그리고 각 카테고리별 샘플 수(예: Safety & Permission 976개, Sycophancy & Bias 578개, Specification Gaming 408개) 등을 상세히 제시한다. 이러한 투명한 메타데이터 제공은 향후 연구자가 동일 벤치마크를 재현하거나 확장하는 데 중요한 기반이 된다.

결론적으로, AutoMonitor‑Bench는 LLM 기반 감시기의 신뢰성을 정량화하는 최초의 표준이며, 현재 감시 모델이 직면한 안전‑유용성 트레이드오프와 일반화 한계를 명확히 드러낸다. 향후 연구는 카테고리‑특화 프롬프트 설계, 멀티‑태스크 학습, 그리고 메타‑학습 기반의 적응형 감시 전략을 통해 이러한 한계를 극복해야 할 필요가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기