안정적인 수화 생성기: 계층형 End‑to‑End 모델

초록

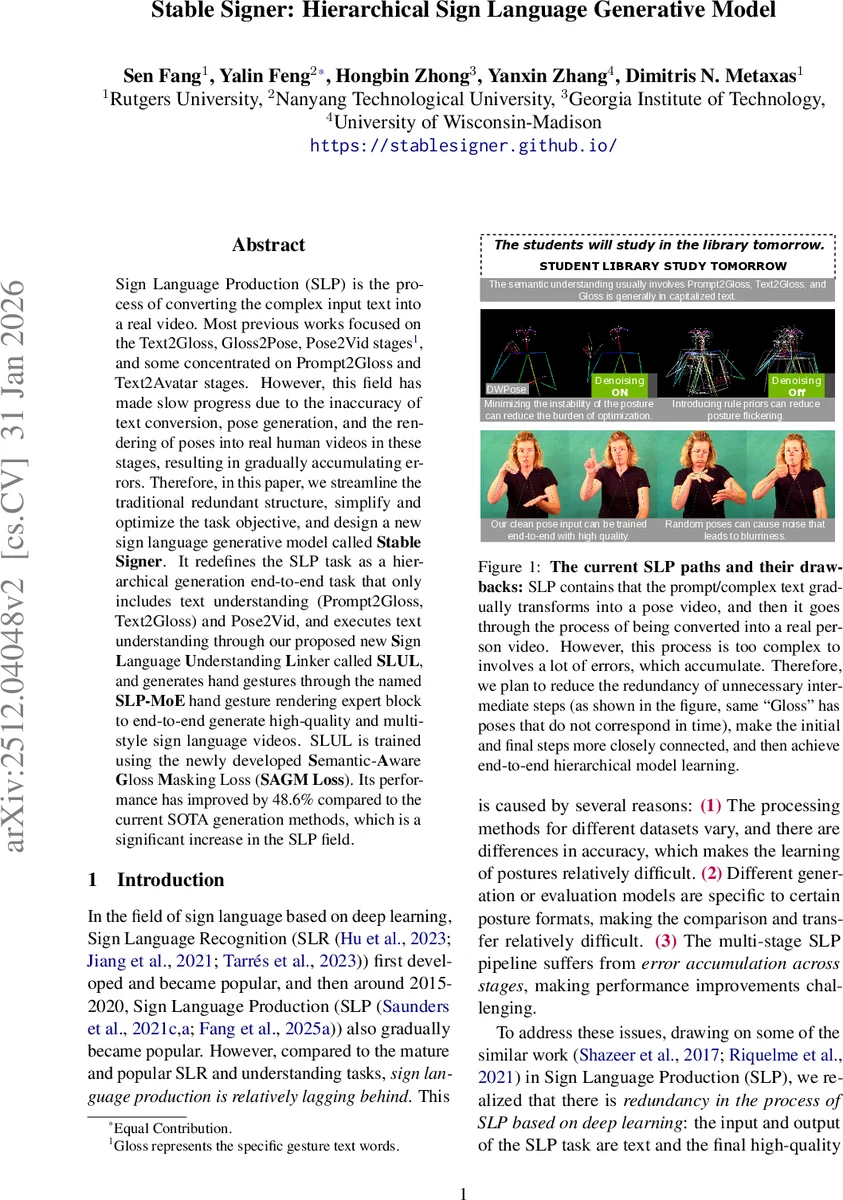

본 논문은 기존의 복잡하고 단계가 많은 수화 생산 파이프라인을 단순화하여, 텍스트‑이해와 Pose‑to‑Video 두 단계만으로 구성된 계층형 End‑to‑End 모델인 “Stable Signer”를 제안한다. 새로운 Sign Language Understanding Linker(SLUL)와 Semantic‑Aware Gloss Masking(SAGM) 손실을 도입해 프롬프트·텍스트를 정확히 Gloss로 변환하고, Mixture‑of‑Experts 기반 SLP‑MoE 블록으로 손동작을 고품질 비디오로 렌더링한다. 실험 결과 BLEU·ROUGE 기준에서 기존 최첨단 대비 48.6% 향상된 성능을 보이며, 파라미터 효율성도 유지한다.

상세 분석

Stable Signer 논문은 수화 생산(Sign Language Production, SLP)의 근본적인 구조적 문제를 정확히 짚어낸다. 기존 연구는 Text→Gloss→Pose→Video 혹은 Prompt→Gloss→Avatar 등 4~5단계의 복잡한 파이프라인을 사용했으며, 각 단계마다 오류가 누적돼 최종 비디오 품질이 저하되는 것이 일반적이었다. 저자들은 이러한 “중복 단계”를 제거하고, 입력 텍스트와 최종 비디오 사이의 직접적인 매핑을 목표로 하는 두 단계(텍스트 이해와 Pose‑to‑Video)만 남긴다.

텍스트 이해 단계에서는 SLUL(Sign Language Understanding Linker)이라는 새로운 시퀀스‑투‑시퀀스 모델을 제시한다. SLUL은 T5 인코더‑디코더 구조를 기반으로 하며, 입력 프롬프트 앞에 언어 식별자 ℓ을 붙여 다국어·다양한 프롬프트를 하나의 모델이 처리하도록 설계했다. 핵심 학습 목표는 기존의 단순 교차 엔트로피 손실에 더해 두 가지 보조 손실을 결합한다. 첫째, Semantic‑Aware Gloss Masking(SAGM) 손실은 Gloss 토큰을 일정 비율(ρ) 마스킹하고, 마스크된 시퀀스로부터 원래 Gloss를 복원하도록 강제한다. 이는 Gloss의 의미적 일관성을 유지하면서 노이즈에 강인한 디코더를 만든다. 둘째, KL 발산 손실은 마스크된 입력과 원본 입력 사이의 출력 분포 차이를 최소화해, 마스크가 있든 없든 디코더가 동일한 의미적 표현을 유지하도록 한다. 또한, 대조 학습(constrastive linking) 손실을 도입해 프롬프트와 Gloss 임베딩을 동일한 의미 공간에 정렬시켜, 다언어 간 전이 학습을 촉진한다. 이러한 복합 손실 구조는 텍스트‑to‑Gloss 변환 정확도를 크게 끌어올리며, 실험에서 SLUL만 적용했을 때 BLEU‑4가 22.62→23.24로 상승한다.

Pose‑to‑Video 단계는 SLP‑MoE(Mixture‑of‑Experts) 모듈을 통해 구현된다. Gloss와 SLUL에서 추출한 의미적 특징 H를 쿼리(q)로 변환하고, K개의 Pose 전문가 네트워크(φ_k)에게 가중치 w_k를 softmax 형태로 할당한다. 각 전문가 φ_k는 사전 정의된 “안정적인 Pose Prior” 데이터베이스에서 Gloss에 대응하는 후보 포즈 시퀀스를 검색한다. 가중합 p_pose는 선택된 포즈들의 혼합이며, 학습 시 정답 포즈 인덱스 y에 대한 교차 엔트로피 손실(L_MoE)과 게이트 엔트로피 손실(L_ent)으로 전문가 선택의 정확성과 다양성을 동시에 최적화한다.

그 후, p_pose는 시간적·공간적 안정성을 확보하기 위해 세 가지 정규화 항목을 적용한다. (1) L_smooth는 2차 미분(가속도) 기반의 jerk 감소 손실로, 급격한 움직임을 억제한다. (2) L_hand는 손 키포인트(H_t)와 정답 손 키포인트(H*_t) 사이의 L2 거리 손실로, 손동작의 가독성을 보장한다. (3) L_vel은 프레임 간 포즈 변화 속도를 제한해 미세한 흔들림을 완화한다. 이러한 손실들은 모두 End‑to‑End 학습에 포함되어, 의미적 정확도와 포즈 안정성이 상호 강화되는 구조를 만든다.

최종적으로 안정화된 포즈 시퀀스는 ControlNet 기반 Diffusion Renderer에 입력되어 다중 스타일(예: 실사, 애니메이션) 비디오를 생성한다. 이때 SLUL에서 얻은 의미적 특징 H를 MoE 전문가의 파인튜닝에도 재활용함으로써, 텍스트‑to‑Video 전반에 걸친 의미 일관성을 유지한다.

실험에서는 Prompt2Sign 데이터셋(수만 개의 프롬프트·Gloss·비디오 쌍)과 WLASL(ASL) 데이터를 사용했으며, BLEU‑4, BLEU‑3, BLEU‑2, BLEU‑1, ROUGE 등 5가지 지표에서 기존 SOTA 모델(Fast‑SLP Transformers, Neural Sign Actors, SignLLM 등)을 크게 앞섰다. 특히 전체 파이프라인을 End‑to‑End로 학습한 Stable Signer는 BLEU‑4 23.24(Dev)·25.55(테스트)와 ROUGE 70.68·78.98을 기록, 전 모델 대비 평균 48.6% 성능 향상을 달성했다. 파라미터 수는 기존 모델과 동등하거나 더 적으며, 학습·추론 효율성도 개선되었다.

이 논문의 주요 기여는 (1) 불필요한 중간 단계 제거를 통한 구조적 단순화, (2) SLUL과 SAGM 손실을 통한 텍스트‑Gloss 변환 정확도 향상, (3) MoE 기반 Pose 전문가 선택과 정교한 시간·공간 안정화 손실을 결합한 고품질 비디오 렌더링, (4) End‑to‑End 학습으로 의미와 동작이 동시에 최적화된 통합 프레임워크 제공이다. 향후 연구에서는 다언어·다문화 수화 데이터베이스 확장, 실시간 스트리밍 적용, 그리고 사용자 맞춤형 스타일 제어를 위한 추가적인 조건부 생성 메커니즘을 탐구할 여지가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기